Pytanie 1

Co się stanie, jeśli w systemie operacyjnym komputera zainstalowany zostanie program określany jako Trojan?

Wynik: 37/40 punktów (92,5%)

Wymagane minimum: 20 punktów (50%)

Co się stanie, jeśli w systemie operacyjnym komputera zainstalowany zostanie program określany jako Trojan?

W celu ochrony lokalnej sieci komputerowej przed atakami typu Smurf pochodzącymi z Internetu, należy zainstalować oraz właściwie skonfigurować

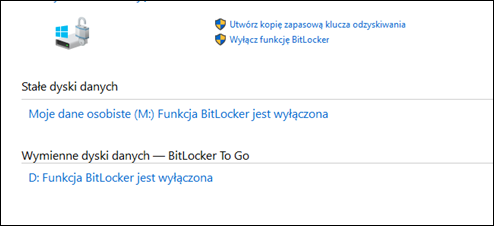

Przedstawione wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate służy do

Który z protokołów umożliwia bezpieczne połączenie klienta z zachowaniem anonimowości z witryną internetową banku?

Jakie miejsce nie powinno być wykorzystywane do przechowywania kopii zapasowych danych z dysku twardego komputera?

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Narzędzie chroniące przed nieautoryzowanym dostępem do lokalnej sieci, to

Narzędzie w systemie Windows umożliwiające monitorowanie prób logowania do systemu to dziennik

Trzech użytkowników komputera z systemem operacyjnym Windows XP Pro posiada swoje foldery z dokumentami w głównym katalogu dysku C:. Na dysku znajduje się system plików NTFS. Użytkownicy mają utworzone konta z ograniczonymi uprawnieniami. Jak można zabezpieczyć folder każdego z użytkowników, aby inni nie mieli możliwości modyfikacji jego zawartości?

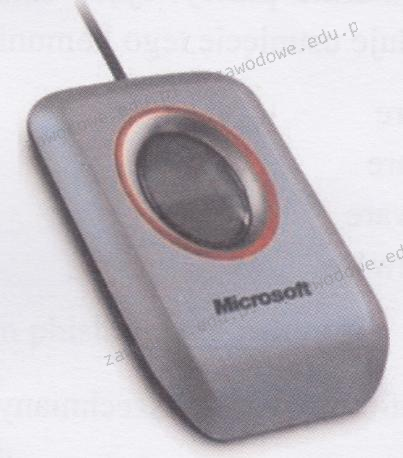

Urządzeniem peryferyjnym pokazanym na ilustracji jest skaner biometryczny, który wykorzystuje do identyfikacji

Aby zapewnić użytkownikom Active Directory możliwość logowania i korzystania z zasobów tej usługi w sytuacji awarii kontrolera domeny, trzeba

Który protokół jest wykorzystywany do konwersji między adresami IP publicznymi a prywatnymi?

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

Usługa umożliwiająca przechowywanie danych na zewnętrznym serwerze, do którego dostęp możliwy jest przez Internet to

Główny sposób zabezpieczania danych w sieciach komputerowych przed dostępem nieautoryzowanym to

Komputer lokalny dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego komputera, która rozpoznaje adresy w sieci, uzyskano informację, że adres komputera to 195.182.130.24. To oznacza, że

Aby zapobiec uszkodzeniu sprzętu w trakcie modernizacji laptopa polegającej na wymianie modułów pamięci RAM, należy

Aby uzyskać więcej wolnego miejsca na dysku bez tracenia danych, co należy zrobić?

W systemie Windows ochrona polegająca na ostrzeganiu przed uruchomieniem nierozpoznanych aplikacji i plików pobranych z Internetu jest realizowana przez

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Do wykonania kopii danych na dysk USB w systemie Linux stosuje się polecenie

Do kategorii oprogramowania określanego jako malware (z ang. malicious software) nie zalicza się oprogramowanie typu:

Urządzeniem, które chroni przed różnorodnymi atakami sieciowymi oraz może wykonywać dodatkowe zadania, takie jak szyfrowanie przesyłanych informacji lub automatyczne informowanie administratora o próbie włamania, jest

Jakie jest główne zadanie systemu DNS w sieci komputerowej?

Którego programu nie można użyć do przywrócenia danych w systemie Windows na podstawie wcześniej wykonanej kopii?

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Jaką rolę odgrywa ISA Server w systemie operacyjnym Windows?

Oznaczenie CE świadczy o tym, że

Do zrealizowania macierzy RAID 1 wymagane jest co najmniej

Proces, który uniemożliwia całkowicie odzyskanie danych z dysku twardego, to

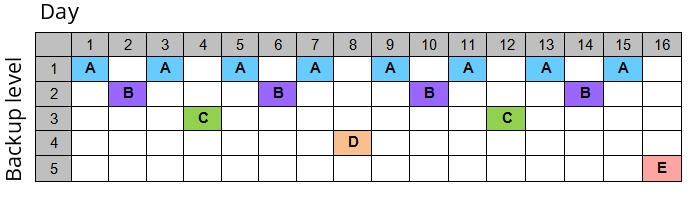

Która kopia w procesie archiwizacji plików pozostawia oznaczenie archiwizacji?

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny jedynie za archiwizację danych zgromadzonych na dysku serwera?

W systemie Windows 7, aby skopiować katalog c:\est wraz ze wszystkimi podkatalogami na zewnętrzny dysk, należy zastosować polecenie

Co oznacza skrót RAID w kontekście pamięci masowej?

Strategia przedstawiona w diagramie dla tworzenia kopii zapasowych na nośnikach jest znana jako

Aby zabezpieczyć system przed atakami z sieci nazywanymi phishingiem, nie powinno się

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie otrzymał zadanie podziału aktualnej lokalnej sieci komputerowej na 16 podsieci. Obecna sieć posiada adres IP 192.168.20.0 i maskę 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Jakie miejsce nie jest zalecane do przechowywania kopii zapasowej danych z dysku twardego komputera?