Pytanie 1

W systemie Linux komenda ps wyświetli

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux komenda ps wyświetli

Ile par przewodów miedzianej skrętki kategorii 5e jest używanych do transmisji danych w standardzie sieci Ethernet 100Base-TX?

Wykonanie polecenia fsck w systemie Linux będzie skutkować

W dokumentacji płyty głównej podano informację "wsparcie dla S/PDIF Out". Co to oznacza w kontekście tej płyty głównej?

Metoda zwana rytownictwem dotyczy zasady działania plotera

W sytuacji, gdy brakuje odpowiedniej ilości pamięci RAM do przeprowadzenia operacji, takiej jak uruchomienie aplikacji, system Windows pozwala na przeniesienie nieużywanych danych z pamięci RAM do pliku

Aby zrealizować alternatywę logiczną z negacją, konieczne jest zastosowanie funktora

Ile wynosi pojemność jednowarstwowej płyty Blu-ray?

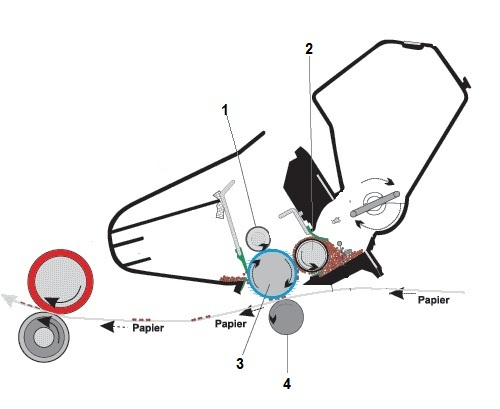

Na przedstawionym schemacie drukarki laserowej wałek światłoczuły oznaczono numerem

Główny sposób zabezpieczania danych w sieciach komputerowych przed dostępem nieautoryzowanym to

Jakie jest kluczowe zadanie protokołu ICMP?

Aby poprawić organizację plików na dysku i przyspieszyć działanie systemu, co należy zrobić?

Rzeczywistą kalibrację sprzętową monitora można wykonać

Jakie urządzenie aktywne pozwoli na podłączenie do sieci lokalnej za pomocą kabla UTP 15 komputerów, drukarki sieciowej oraz rutera?

W specyfikacji procesora można znaleźć informację: "Procesor 32bitowy". Co to oznacza?

Narzędzie pokazane na ilustracji jest używane do weryfikacji

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

Najkrótszy czas dostępu charakteryzuje się

Jaką wartość ma liczba 5638 zapisana w systemie szesnastkowym?

Wskaż nieprawidłowy sposób podziału dysków MBR na partycje?

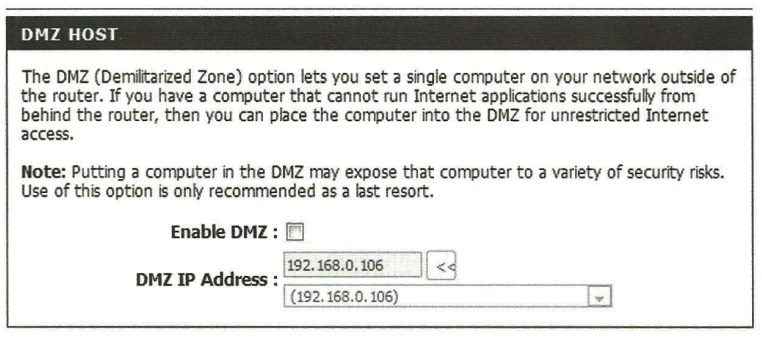

Na ilustracji zaprezentowano zrzut ekranu z ustawień DMZ na routerze. Aktywacja opcji "Enable DMZ" spowoduje, że komputer o adresie IP 192.168.0.106

Zgodnie z podanym cennikiem, przeciętny koszt zakupu wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Korzystając z polecenia systemowego ipconfig, można skonfigurować

Domyślnie w programie Eksplorator Windows przy użyciu klawisza F5 uruchamiana jest funkcja

Narzędzie chroniące przed nieautoryzowanym dostępem do lokalnej sieci, to

Aby podnieść wydajność komputera w grach, karta graficzna Sapphire Radeon R9 FURY OC, 4GB HBM (4096 Bit), HDMI, DVI, 3xDP została wzbogacona o technologię

Który z wymienionych adresów należy do klasy C?

Instalacja serwera stron www w rodzinie systemów Windows Server jest możliwa dzięki roli

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to

Switch sieciowy w standardzie Fast Ethernet pozwala na przesył danych z maksymalną prędkością

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Jakim wynikiem jest suma liczb binarnych 1001101 oraz 11001?

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji elektrycznej oświetlenia powinna wynosić

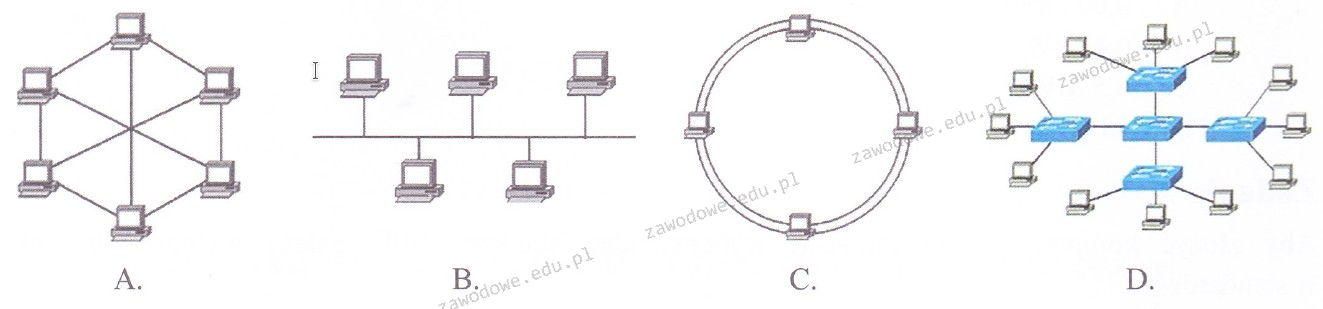

Topologia fizyczna, w której każdy węzeł łączy się z wszystkimi innymi węzłami, to topologia

Na którym z przedstawionych rysunków ukazano topologię sieci typu magistrala?

Jakie oprogramowanie jest używane do archiwizacji danych w systemie Linux?

Jaką licencję musi mieć oprogramowanie, aby użytkownik mógł wprowadzać w nim zmiany?

W tabeli zaprezentowano parametry trzech dysków twardych w standardzie Ultra320 SCSI. Te dyski są w stanie osiągnąć maksymalny transfer wewnętrzny

| Rotational Speed | 10,025 rpm | ||

| Capacity (Formatted) | 73.5GB | 147GB | 300GB |

| Number of Heads | 2 | 5 | 8 |

| Number of Disks | 1 | 3 | 4 |

| Internal Transfer Rate | Up to 132 MB/s | ||

| Interface Transfer Rate | NP/NC = 320MB/s, FC = 200MB/s | ||

| Buffer Size | |||

| Average Seek (Read/Write) | 4.5/5.0 ms | ||

| Track-to-Track Seek/Read/Write | 0.2ms/0.4ms | ||

| Maximum Seek (Read/Write) | 10/11 ms | ||

| Average Latency | 2.99 ms | ||

| Power Consumption (Idle) | NP/NC = 9.5W, FC = 10.5W | ||

| Acoustic Noise | 3.4 bels | ||

| Shock - Operating/Non-Operating | 65G/225G 2ms | ||