Pytanie 1

Rodzaje ataków mających na celu zakłócenie funkcjonowania aplikacji oraz procesów w urządzeniach sieciowych to ataki klasy

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Rodzaje ataków mających na celu zakłócenie funkcjonowania aplikacji oraz procesów w urządzeniach sieciowych to ataki klasy

Jaki instrument służy do określania długości oraz tłumienności kabli miedzianych?

Który protokół odpowiada za bezpieczne przesyłanie danych w sieciach komputerowych?

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

W sytuacji, gdy brakuje odpowiedniej ilości pamięci RAM do przeprowadzenia operacji, takiej jak uruchomienie aplikacji, system Windows pozwala na przeniesienie nieużywanych danych z pamięci RAM do pliku

Ile podsieci obejmują komputery z adresami: 192.168.5.12/25, 192.168.5.200/25 oraz 192.158.5.250/25?

Wprowadzając w wierszu poleceń systemu Windows Server komendę convert, można wykonać

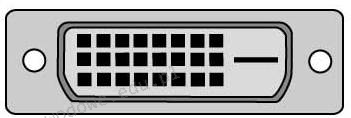

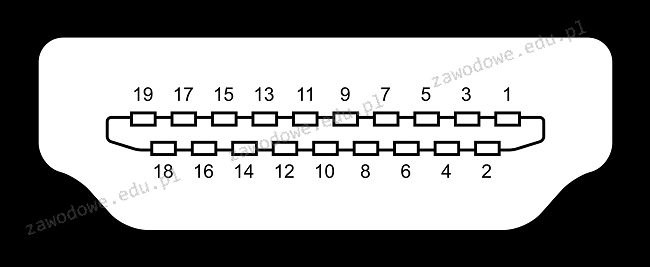

Jak brzmi nazwa portu umieszczonego na tylnym panelu komputera, który znajduje się na przedstawionym rysunku?

Jakie oprogramowanie chroni komputer przed niechcianym softwarem pochodzącym z sieci?

W celu zabezpieczenia komputerów w sieci lokalnej przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Jaka jest podstawowa funkcja protokołu SMTP?

Który typ drukarki stosuje metodę, w której stały barwnik jest przenoszony z taśmy na papier odporny na wysoką temperaturę?

Jaki protokół służy do przesyłania plików bez konieczności tworzenia połączenia?

Jaki rezultat uzyskamy po wykonaniu odejmowania dwóch liczb heksadecymalnych 60A (h) - 3BF (h)?

Jakie polecenie w systemie operacyjnym Windows służy do wyświetlenia konfiguracji interfejsów sieciowych?

Do monitorowania aktywnych połączeń sieciowych w systemie Windows służy polecenie

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

Podczas tworzenia sieci kablowej o maksymalnej prędkości przesyłu danych wynoszącej 1 Gb/s, w której maksymalna odległość między punktami sieci nie przekracza 100 m, należy zastosować jako medium transmisyjne

Jakie oznaczenie wskazuje adres witryny internetowej oraz przypisany do niej port?

W systemie Windows, który obsługuje przydziały dyskowe, użytkownik o nazwie Gość

Jakie polecenie należy wprowadzić w konsoli, aby skorygować błędy na dysku?

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

Oznaczenie CE świadczy o tym, że

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Trollowanie w Internecie polega na

Ile maksymalnie dysków twardych można bezpośrednio podłączyć do płyty głównej, której fragment specyfikacji jest przedstawiony w ramce?

|

Zilustrowany na obrazku interfejs to

Wskaź na błędny układ dysku z użyciem tablicy partycji MBR?

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Jaką maksymalną prędkość transferu danych umożliwia interfejs USB 3.0?

Aby zapobiec uszkodzeniu sprzętu w trakcie modernizacji laptopa polegającej na wymianie modułów pamięci RAM, należy

Zgodnie z aktualnymi normami BHP, zalecana odległość oczu od ekranu monitora powinna wynosić

Która z ról w systemie Windows Server umożliwia m.in. zdalną, bezpieczną i uproszczoną instalację systemów operacyjnych Windows na komputerach w sieci?

Zarządzanie pasmem (ang. bandwidth control) w switchu to funkcjonalność

W sieciach bezprzewodowych typu Ad-Hoc IBSS (Independent Basic Service Set) wykorzystywana jest topologia fizyczna

Protokół, który konwertuje nazwy domen na adresy IP, to

Określ adres sieci, do której przypisany jest host o adresie 172.16.0.123/27?

Który typ drukarki stosuje metodę przenoszenia stałego pigmentu z taśmy na papier odporny na wysoką temperaturę?

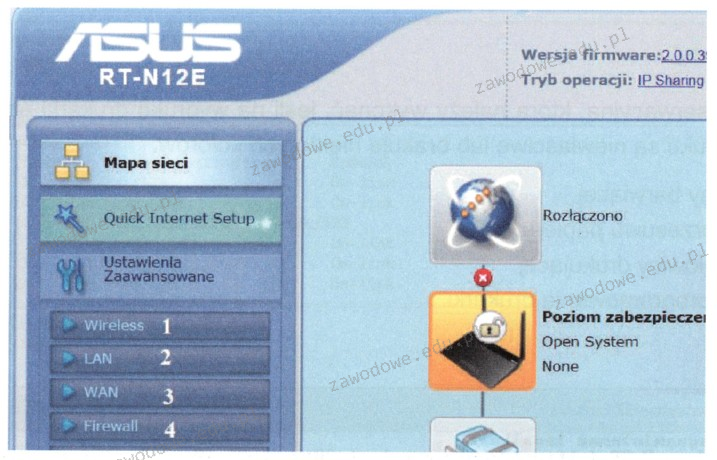

Aby skonfigurować ruter i wprowadzić parametry połączenia od dostawcy internetowego, którą sekcję oznaczoną numerem należy wybrać?

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest