Pytanie 1

Co należy zrobić przed przystąpieniem do prac serwisowych związanych z edytowaniem rejestru systemu Windows?

Wynik: 33/40 punktów (82,5%)

Wymagane minimum: 20 punktów (50%)

Co należy zrobić przed przystąpieniem do prac serwisowych związanych z edytowaniem rejestru systemu Windows?

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Aby podłączyć kartę sieciową przedstawioną na rysunku do laptopa, urządzenie musi być wyposażone w odpowiednie gniazdo

Według specyfikacji JEDEC standardowe napięcie zasilania modułów RAM DDR3L o niskim napięciu wynosi

W modelu RGB, kolor w systemie szesnastkowym przedstawia się w ten sposób: ABCDEF. Wartość natężenia koloru niebieskiego w tym zapisie odpowiada liczbie dziesiętnej

Częścią eksploatacyjną drukarki laserowej nie jest

Jaką licencję musi mieć oprogramowanie, aby użytkownik mógł wprowadzać w nim zmiany?

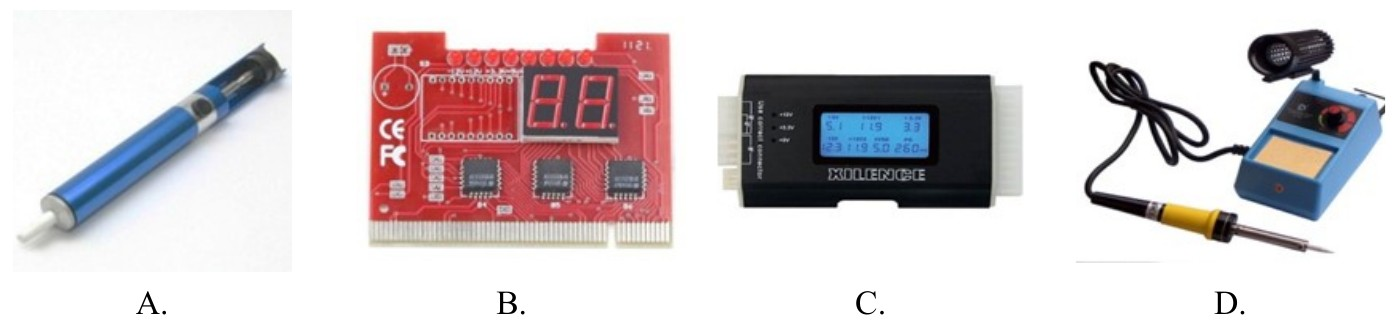

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

W dokumentacji technicznej głośnika komputerowego oznaczenie "10 W" dotyczy jego

W systemie Windows zastosowanie przedstawionego polecenia spowoduje chwilową zmianę koloru

Microsoft Windows [Wersja 6.1.7600] Copyright (c) 2009 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\w>color 1_

Aby wyświetlić informacje o systemie Linux w terminalu, jakie polecenie należy wprowadzić?

Linux egeg-deeesktop 4.8.0-36-generic #36~16.04.1-Ubuntu SMP Sun Feb 5 09:39:41 UTC 2017 i686 i686 i686 GNU/Linux

W systemie Windows zastosowanie zaprezentowanego polecenia spowoduje chwilową modyfikację koloru

Microsoft Windows [Version 10.0.14393] (c) 2016 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\ak>color 1

Plik tekstowy wykonaj.txt w systemie Windows 7 zawiera

@echo off echo To jest tylko jedna linijka tekstuAby wykonać polecenia zapisane w pliku, należy

Do ilu sieci należą komputery o podanych w tabeli adresach IP i standardowej masce sieci?

| Komputer | Adres IP |

|---|---|

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Które z poniższych poleceń systemu Windows generuje wynik przedstawiony na rysunku?

Aktywne połączenia Protokół Adres lokalny Obcy adres Stan TCP 192.168.1.20:49490 fra16s14-in-f3:https USTANOWIONO TCP 192.168.1.20:49519 fra16s08-in-f14:https USTANOWIONO TCP 192.168.1.20:49588 fra16s08-in-f14:https USTANOWIONO TCP 192.168.1.20:49599 fra15s12-in-f42:https CZAS_OCZEKIWANIA TCP 192.168.1.20:49689 fra07s28-in-f3:https CZAS_OCZEKIWANIA TCP 192.168.1.20:49732 fra15s12-in-f46:https USTANOWIONO TCP 192.168.1.20:49733 fra15s16-in-f14:https USTANOWIONO TCP 192.168.1.20:49743 fra16s07-in-f14:https USTANOWIONO TCP 192.168.1.20:49752 fra16s07-in-f14:https USTANOWIONO TCP 192.168.1.20:49753 fra16s08-in-f14:http USTANOWIONO TCP 192.168.1.20:49755 public102925:http USTANOWIONO TCP 192.168.1.20:49756 fra16s13-in-f1:https USTANOWIONO TCP 192.168.1.20:49759 194.54.27.117:https USTANOWIONO TCP 192.168.1.20:49760 194.54.27.117:https USTANOWIONO TCP 192.168.1.20:49761 194.54.27.117:https USTANOWIONO TCP 192.168.1.20:49762 194.54.27.117:https USTANOWIONO TCP 192.168.1.20:49763 fra16s06-in-f138:https USTANOWIONO TCP 192.168.1.20:49764 fra15s16-in-f3:https USTANOWIONO PS C:\Users\Administrator.SERVER.001> _

Oblicz koszt brutto materiałów niezbędnych do połączenia w sieć w topologii gwiazdy 3 komputerów wyposażonych w karty sieciowe, wykorzystując przewody o długości 2m. Ceny materiałów podano w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu "skrętka" | 1 zł za 1 metr |

Komputer K1 jest podłączony do interfejsu G0 routera, a komputer K2 do interfejsu G1 tego samego routera. Na podstawie przedstawionej w tabeli adresacji ustal prawidłowy adres bramy komputera K2.

Interfejs Adres IP Maska

G0 172.16.0.1 255.255.0.0

G1 192.168.0.1 255.255.255.0

Aby prawidłowo uzupełnić składnię przedstawionego polecenia, które udostępnia folder 'Dane' pod nazwą 'test', w miejsce kropek należy wpisać odpowiednie słowo:

net ... test=C:\Dane

Wskaż sygnał informujący o błędzie karty graficznej w komputerze z BIOS POST od firmy AWARD?

Do automatycznej synchronizacji dokumentów redagowanych przez kilka osób w tym samym czasie, należy użyć

Liczba \( 10_{D} \) w systemie uzupełnień do dwóch jest równa

Usługa RRAS serwera Windows 2019 jest przeznaczona do

Funkcja failover usługi DHCP umożliwia

Którą maskę należy zastosować, aby podzielić sieć o adresie 172.16.0.0/16 na podsieci o maksymalnej liczbie 62 hostów?

Aby uzyskać adres IPv4, za pomocą usługi DHCP, komputer kliencki wysyła żądania z portu

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Który z profili w systemie Windows umożliwia migrację ustawień konta pomiędzy stacjami roboczymi?

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

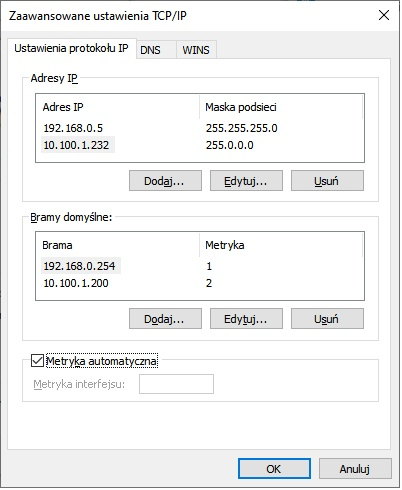

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

Którego polecenia należy użyć, aby w ruterze skonfigurować trasę statyczną dla adresu następnego skoku 192.168.1.1?

Przedsiębiorca przekazujący do składowania odpady inne niż komunalne ma obowiązek prowadzić

W celu doboru właściwej aktualizacji oprogramowania dla punktu dostępowego można skorzystać z identyfikacji

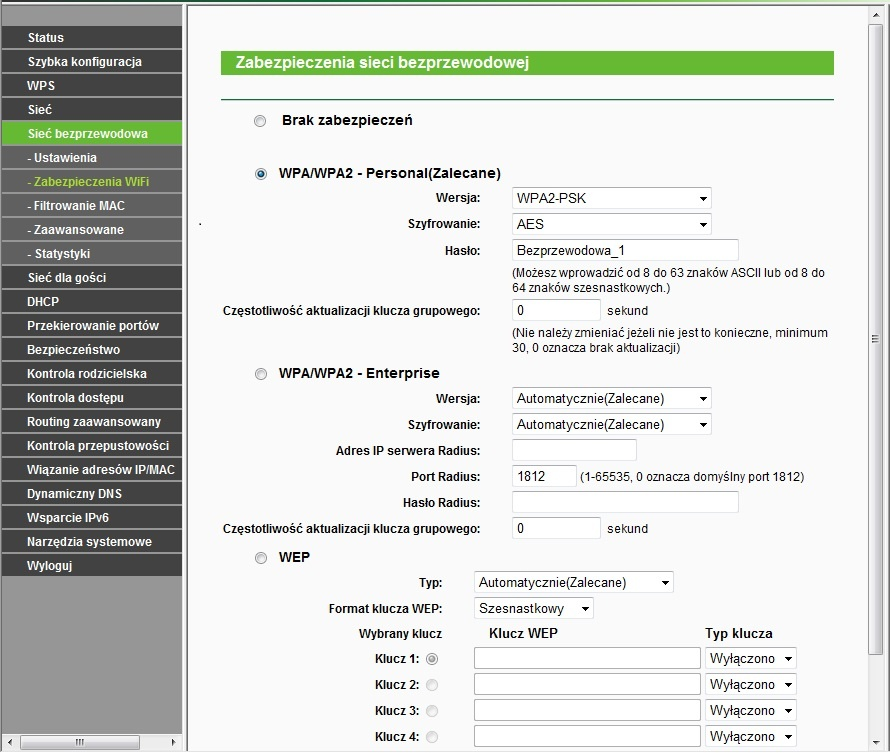

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

Procesor Intel Core i3 można zamontować w gnieździe

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

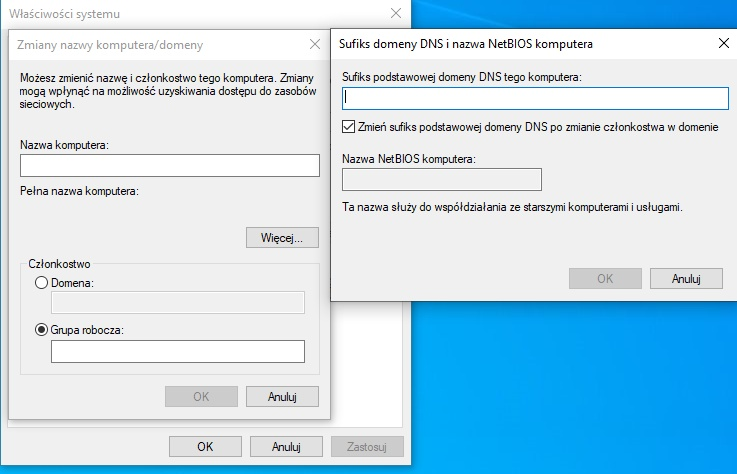

Aby podłączyć stację roboczą z zainstalowanym systemem Windows do domeny zst.local należy

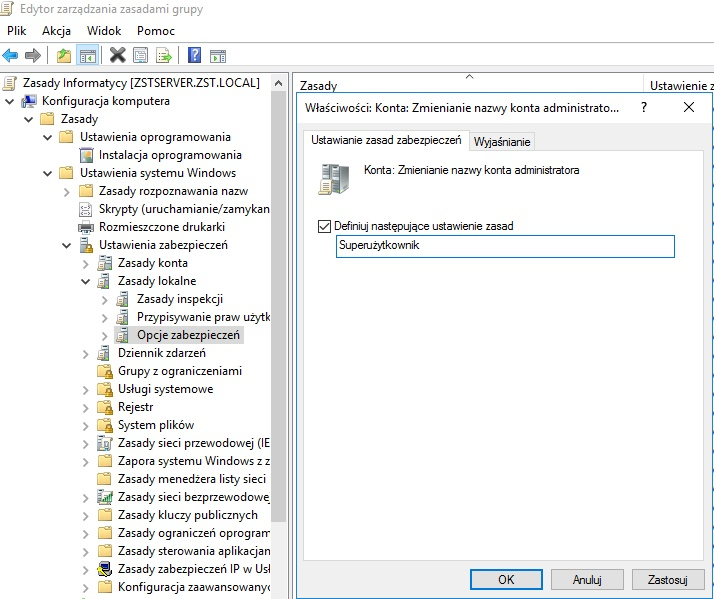

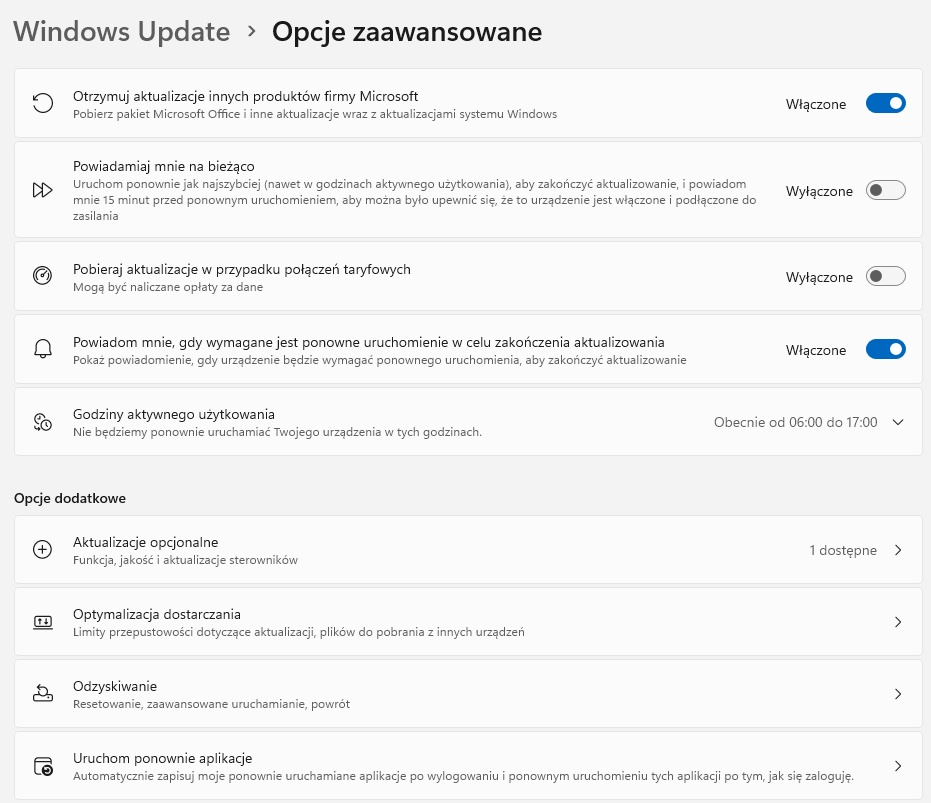

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

Rezultatem działania przedstawionego na ilustracji okna jest