Pytanie 1

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

Licencja Windows OEM nie zezwala na wymianę

Na wydrukach uzyskanych z drukarki laserowej można zauważyć pasma wzdłużne oraz powtarzające się defekty. Jedną z możliwych przyczyn niskiej jakości druku jest wada

Adres komórki pamięci został podany w kodzie binarnym 1110001110010100. Jak zapisuje się ten adres w systemie szesnastkowym?

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Która z warstw modelu ISO/OSI ma związek z protokołem IP?

Poprzez użycie opisanego urządzenia możliwe jest wykonanie diagnostyki działania

Który z protokołów służy do weryfikacji poprawności połączenia między dwoma hostami?

Wykonanie polecenia fsck w systemie Linux będzie skutkować

Jakie są korzyści płynące z użycia systemu plików NTFS?

Jaki będzie rezultat odejmowania dwóch liczb zapisanych w systemie heksadecymalnym 60Ah - 3BFh?

Jak nazywa się licencja oprogramowania pozwalająca na bezpłatne dystrybucję aplikacji?

Jaką sumę należy zapłacić za wymianę karty graficznej w komputerze, jeżeli cena karty wynosi 250 zł, a czas wymiany przez pracownika serwisu to 80 minut, przy czym każda rozpoczęta godzina pracy kosztuje 50 zł?

Jakie narzędzie pozwala na zarządzanie menadżerem rozruchu w systemach Windows od wersji Vista?

Thunderbolt jest typem interfejsu:

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Która norma określa parametry transmisji dla komponentów kategorii 5e?

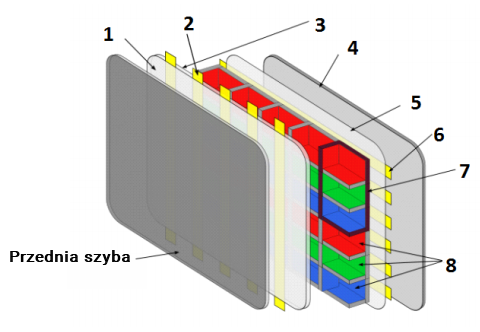

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego, oznaczenie numer 6 dotyczy

W systemie Windows ochrona polegająca na ostrzeganiu przed uruchomieniem nierozpoznanych aplikacji i plików pobranych z Internetu jest realizowana przez

Jak nazywa się pamięć podręczna?

Jaki poziom macierzy RAID umożliwia równoległe zapisywanie danych na wielu dyskach działających jako jedno urządzenie?

Jednym z typowych symptomów mogących świadczyć o nadchodzącej awarii dysku twardego jest wystąpienie

Który z podanych adresów IP należy do kategorii adresów prywatnych?

Użytkownik systemu Windows może logować się na każdym komputerze w sieci, korzystając z profilu, który jest przechowywany na serwerze i może być zmieniany przez użytkownika. Jak nazywa się ten profil?

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

Chusteczki nasączone substancją o właściwościach antystatycznych służą do czyszczenia

Jakie jest zastosowanie maty antystatycznej oraz opaski podczas instalacji komponentu?

Która z licencji ma charakter grupowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, państwowym i charytatywnym na zakup większej ilości oprogramowania firmy Microsoft na korzystnych zasadach?

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

Wykonanie polecenia tar -xf dane.tar w systemie Linux spowoduje

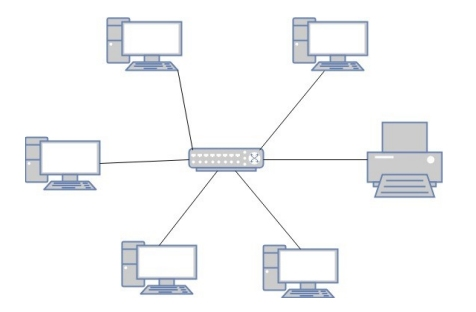

Jaką fizyczną topologię sieci komputerowej ilustruje ten rysunek?

Aby uruchomić monitor wydajności oraz niezawodności w systemie Windows, należy skorzystać z przystawki

Jaki rodzaj fizycznej topologii w sieciach komputerowych jest pokazany na ilustracji?

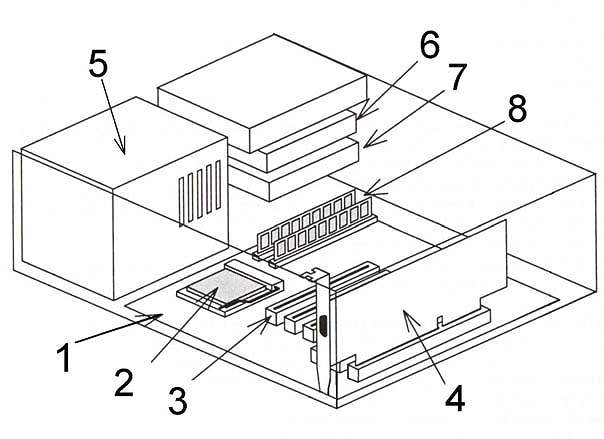

Na ilustracji karta rozszerzeń jest oznaczona numerem

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

W usłudze Active Directory, konfigurację składającą się z jednej lub więcej domen, które dzielą wspólny schemat i globalny wykaz, nazywamy

Atak na system komputerowy przeprowadzany jednocześnie z wielu maszyn w sieci, który polega na zablokowaniu działania tego systemu przez zajęcie wszystkich dostępnych zasobów, określany jest mianem

Miarą wyrażaną w decybelach, która określa różnicę pomiędzy mocą sygnału wysyłanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej, jest

Jakie polecenie w systemie operacyjnym Linux służy do prezentowania konfiguracji interfejsów sieciowych?

Liczba 10101110110(2) w systemie szesnastkowym przedstawia się jako