Pytanie 1

Która para: protokół – warstwa, w której funkcjonuje protokół, jest prawidłowo zestawiona według modelu TCP/IP?

Wynik: 10/40 punktów (25,0%)

Wymagane minimum: 20 punktów (50%)

Która para: protokół – warstwa, w której funkcjonuje protokół, jest prawidłowo zestawiona według modelu TCP/IP?

W dokumentacji przedstawiono typ systemu plików

| „Zaawansowany system plików zapewniający wydajność, bezpieczeństwo, niezawodność i zaawansowane funkcje niespotykane w żadnej wersji systemu FAT. Na przykład dzięki standardowemu rejestrowaniu transakcji i technikom odzyskiwania danych system gwarantuje spójność woluminów. W przypadku awarii system wykorzystuje plik dziennika i informacje kontrolne do przywrócenia spójności systemu plików." |

Jak powinno być usytuowanie gniazd komputerowych RJ45 względem powierzchni biurowej zgodnie z normą PN-EN 50174?

Jaka licencja ma charakter zbiorowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, rządowym, charytatywnym na nabycie większej liczby programów firmy Microsoft na korzystnych warunkach?

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

Urządzenie peryferyjne pokazane na ilustracji to skaner biometryczny, który do autoryzacji wykorzystuje

Jakie urządzenie aktywne pozwoli na podłączenie do sieci lokalnej za pomocą kabla UTP 15 komputerów, drukarki sieciowej oraz rutera?

Użytkownik systemu Windows może skorzystać z polecenia taskmgr, aby

Firma uzyskała zakres adresów 10.10.10.0/16. Po podzieleniu na podsieci zawierające 510 hostów, jakie są adresy podsieci z zastosowaną maską?

Jakie medium transmisyjne nosi nazwę 100BaseTX i jaka jest maksymalna prędkość danych, która może być w nim osiągnięta?

Jaką konfigurację sieciową może mieć komputer, który należy do tej samej sieci LAN, co komputer z adresem 10.8.1.10/24?

Jakie funkcje pełni protokół ARP (Address Resolution Protocol)?

Jak określa się technologię stworzoną przez firmę NVIDIA, która pozwala na łączenie kart graficznych?

Jakie narzędzie jest używane w systemie Windows do przywracania właściwych wersji plików systemowych?

Który z materiałów eksploatacyjnych nie jest stosowany w ploterach?

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

Jaką liczbę warstw określa model ISO/OSI?

Wykonanie polecenia net localgroup w systemie Windows spowoduje

Rozmiar pliku wynosi 2 KiB. Co to oznacza?

Aby stworzyć las w strukturze AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

Zanim przystąpimy do prac serwisowych dotyczących modyfikacji rejestru systemu Windows, konieczne jest wykonanie

Technologia procesorów z serii Intel Core, wykorzystywana w układach i5, i7 oraz i9, umożliwiająca podniesienie częstotliwości w sytuacji, gdy komputer potrzebuje większej mocy obliczeniowej, to

Sprawdzenie ilości wolnego miejsca na dysku twardym w systemie Linux umożliwia polecenie

Adres MAC (Medium Access Control Address) to sprzętowy identyfikator karty sieciowej Ethernet w warstwie modelu OSI

Który z interfejsów można uznać za interfejs równoległy?

W jakiej logicznej topologii funkcjonuje sieć Ethernet?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Program wykorzystywany w wierszu poleceń systemu Windows do kompresji i dekompresji plików oraz katalogów to

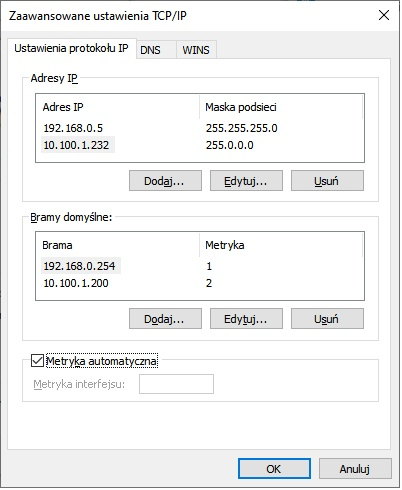

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

Urządzenie zaprezentowane na ilustracji jest wykorzystywane do zaciskania wtyków:

Nieprawidłowa forma zapisu liczby 778 to

Aby zapobiec uszkodzeniu sprzętu podczas modernizacji laptopa, która obejmuje wymianę modułów pamięci RAM, należy

Jaki wydruk w systemie rodziny Linux uzyskamy po wprowadzeniu komendy

dr-x------ 2 root root 0 lis 28 12:39 .gvfs -rw-rw-r-- 1 root root 361016 lis 8 2012 history.dat -rw-r--r-- 1 root root 97340 lis 28 12:39 .ICEauthority drwxrwxr-x 5 root root 4096 paź 7 2012 .icedtea drwx------ 3 root root 4096 cze 27 18:40 .launchpadlib drwxr-xr-x 3 root root 4096 wrz 2 2012 .local

Który zakres adresów pozwala na komunikację multicast w sieciach z użyciem adresacji IPv6?

Jaki typ matrycy powinien być zastosowany w monitorze modernizowanego komputera, aby zapewnić wysoką jakość obrazu oraz szerokie kąty widzenia zarówno w poziomie, jak i w pionie?

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który wymusza jego automatyczne aktualizacje, są

Na ilustracji widoczny jest

Jakie urządzenie elektroniczne ma zdolność do magazynowania ładunku elektrycznego?

Aby zapewnić łączność urządzenia mobilnego z komputerem za pośrednictwem interfejsu Bluetooth, konieczne jest