Pytanie 1

Program do monitorowania, który umożliwia przechwytywanie, nagrywanie oraz dekodowanie różnych pakietów sieciowych to

Wynik: 33/40 punktów (82,5%)

Wymagane minimum: 20 punktów (50%)

Program do monitorowania, który umożliwia przechwytywanie, nagrywanie oraz dekodowanie różnych pakietów sieciowych to

W systemach Microsoft Windows komenda netstat -a pokazuje

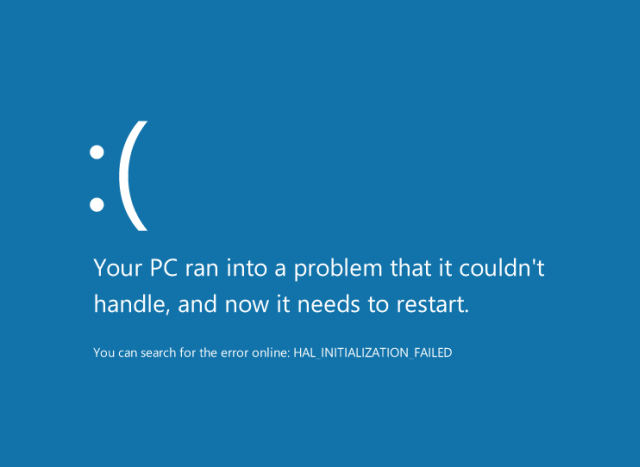

Błąd typu STOP Error (Blue Screen) w systemie Windows, który wiąże się z odniesieniem się systemu do niepoprawnych danych w pamięci RAM, to

Celem złocenia styków złącz HDMI jest

Jaki instrument służy do określania długości oraz tłumienności kabli miedzianych?

Komunikat biosu POST od firmy Award o treści "Display switch is set incorrectly" sugeruje

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

Jeżeli podczas uruchamiania systemu BIOS od AWARD komputer wydał długi sygnał oraz dwa krótkie, co to oznacza?

Zjawisko przesłuchu w sieciach komputerowych polega na

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

W drukarce laserowej do utrwalania obrazu na papierze stosuje się

Co oznacza określenie średni czas dostępu w dyskach twardych?

Użytkownicy sieci WiFi zauważyli problemy oraz częste zrywanie połączenia z internetem. Co może być przyczyną tej sytuacji?

Na zdjęciu pokazano złącza

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Termin "PIO Mode" odnosi się do trybu operacyjnego

Diagnostykę systemu Linux można przeprowadzić za pomocą komendy

| Thread(s) per core: | 1 |

| Core(s) per socket: | 4 |

| Socket(s): | 1 |

| NUMA node(s): | 1 |

Jaką jednostką określa się szybkość przesyłania danych w sieciach komputerowych?

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

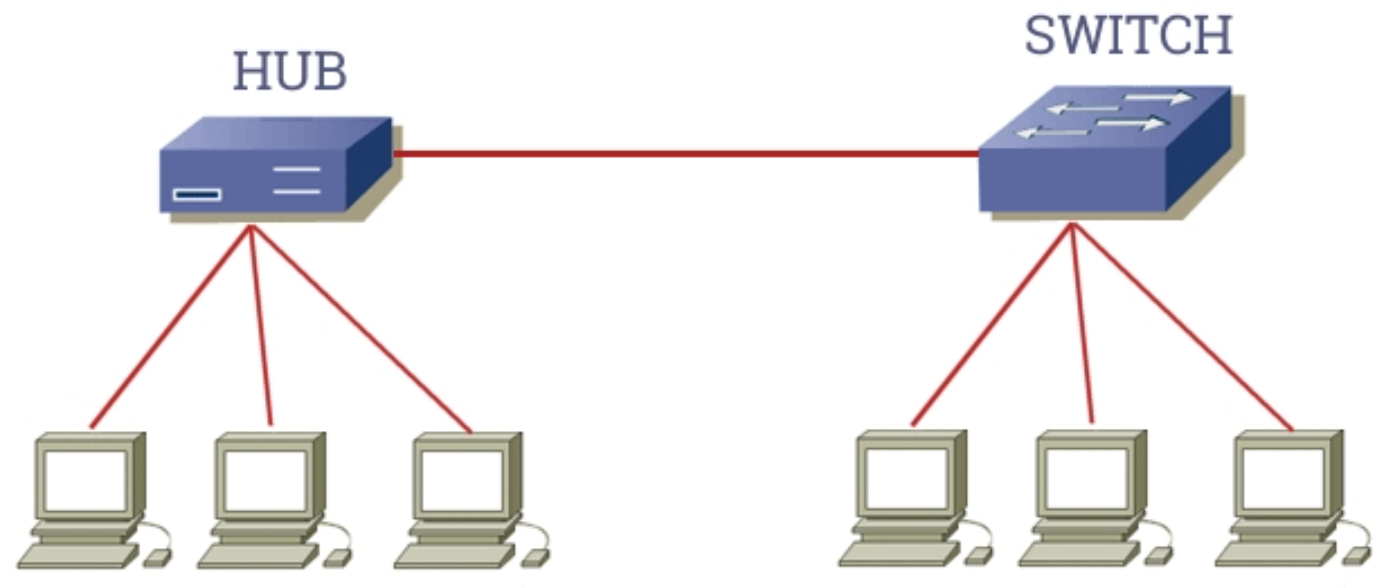

Ile domen kolizyjnych występuje w sieci pokazanej na rysunku?

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

Aby zmierzyć tłumienie łącza światłowodowego w dwóch zakresach transmisyjnych 1310nm oraz 1550nm, powinno się zastosować

Jakie urządzenie wskazujące działa w reakcji na zmiany pojemności elektrycznej?

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Poprzez użycie polecenia ipconfig /flushdns można przeprowadzić konserwację urządzenia sieciowego, która polega na

Jakiego protokołu sieciowego używa się do określenia mechanizmów zarządzania urządzeniami w sieci?

Zamieszczony komunikat tekstowy wyświetlony na ekranie komputera z zainstalowanym systemem Windows wskazuje na

Zamiana taśmy barwiącej jest związana z eksploatacją drukarki

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Aby zmierzyć moc zużywaną przez komputer, należy zastosować

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji protokołów TCP/IP lub innych przesyłanych lub odbieranych w sieci komputerowej, do której jest podłączony komputer użytkownika?

Wskaż właściwą formę maski

W tabeli zaprezentowano parametry trzech dysków twardych w standardzie Ultra320 SCSI. Te dyski są w stanie osiągnąć maksymalny transfer wewnętrzny

| Rotational Speed | 10,025 rpm | ||

| Capacity (Formatted) | 73.5GB | 147GB | 300GB |

| Number of Heads | 2 | 5 | 8 |

| Number of Disks | 1 | 3 | 4 |

| Internal Transfer Rate | Up to 132 MB/s | ||

| Interface Transfer Rate | NP/NC = 320MB/s, FC = 200MB/s | ||

| Buffer Size | |||

| Average Seek (Read/Write) | 4.5/5.0 ms | ||

| Track-to-Track Seek/Read/Write | 0.2ms/0.4ms | ||

| Maximum Seek (Read/Write) | 10/11 ms | ||

| Average Latency | 2.99 ms | ||

| Power Consumption (Idle) | NP/NC = 9.5W, FC = 10.5W | ||

| Acoustic Noise | 3.4 bels | ||

| Shock - Operating/Non-Operating | 65G/225G 2ms | ||

Które narzędzie należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

CommView oraz WireShark to aplikacje wykorzystywane do

Administrator sieci LAN dostrzegł przełączenie w tryb awaryjny urządzenia UPS. To oznacza, że wystąpiła awaria systemu

Jakie polecenie w systemie Windows służy do zbadania trasy, po jakiej przesyłane są pakiety w sieci?

Jakie polecenie w systemie Windows powinno być użyte do sprawdzania aktywnych połączeń karty sieciowej w komputerze?

Które z poniższych poleceń systemu Windows generuje wynik przedstawiony na rysunku?

Aktywne połączenia Protokół Adres lokalny Obcy adres Stan TCP 192.168.1.20:49490 fra16s14-in-f3:https USTANOWIONO TCP 192.168.1.20:49519 fra16s08-in-f14:https USTANOWIONO TCP 192.168.1.20:49588 fra16s08-in-f14:https USTANOWIONO TCP 192.168.1.20:49599 fra15s12-in-f42:https CZAS_OCZEKIWANIA TCP 192.168.1.20:49689 fra07s28-in-f3:https CZAS_OCZEKIWANIA TCP 192.168.1.20:49732 fra15s12-in-f46:https USTANOWIONO TCP 192.168.1.20:49733 fra15s16-in-f14:https USTANOWIONO TCP 192.168.1.20:49743 fra16s07-in-f14:https USTANOWIONO TCP 192.168.1.20:49752 fra16s07-in-f14:https USTANOWIONO TCP 192.168.1.20:49753 fra16s08-in-f14:http USTANOWIONO TCP 192.168.1.20:49755 public102925:http USTANOWIONO TCP 192.168.1.20:49756 fra16s13-in-f1:https USTANOWIONO TCP 192.168.1.20:49759 194.54.27.117:https USTANOWIONO TCP 192.168.1.20:49760 194.54.27.117:https USTANOWIONO TCP 192.168.1.20:49761 194.54.27.117:https USTANOWIONO TCP 192.168.1.20:49762 194.54.27.117:https USTANOWIONO TCP 192.168.1.20:49763 fra16s06-in-f138:https USTANOWIONO TCP 192.168.1.20:49764 fra15s16-in-f3:https USTANOWIONO PS C:\Users\Administrator.SERVER.001> _

Diagnostykę systemu Linux można przeprowadzić używając polecenia

Architecture: x86_64 CPU op-mode(s): 32-bit, 64-bit Byte Order: Little Endian CPU(s): 8 On-line CPU(s) list: 0-7 Thread(s) per core: 2 Core(s) per socket: 4 Socket(s): 1 NUMA node(s): 1 Vendor ID: GenuineIntel CPU family: 6 Model: 42 Stepping: 7 CPU MHz: 1600.000 BogoMIPS: 6784.46 Virtualization: VT-x L1d cache: 32K L1i cache: 32K L2 cache: 256K L3 cache: 8192K NUMA node0 CPU(s): 0-7