Pytanie 1

W systemie Linux można uzyskać listę wszystkich założonych kont użytkowników, wykorzystując polecenie

Wynik: 8/40 punktów (20,0%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux można uzyskać listę wszystkich założonych kont użytkowników, wykorzystując polecenie

Licencja Windows OEM nie zezwala na wymianę

Wskaź, które zdanie dotyczące zapory sieciowej jest nieprawdziwe?

Do automatycznej synchronizacji dokumentów redagowanych przez kilka osób w tym samym czasie, należy użyć

Który standard Gigabit Ethernet pozwala na tworzenie segmentów sieci o długości 550 m lub 5000 m przy prędkości transmisji 1 Gb/s?

Program df działający w systemach z rodziny Linux pozwala na wyświetlenie

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

Komenda msconfig uruchamia w systemie Windows:

Dane z twardego dysku HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

Jakie jest adres rozgłoszeniowy sieci, w której funkcjonuje host z adresem IP 195.120.252.32 oraz maską podsieci 255.255.255.192?

Aby komputery mogły udostępniać dane w sieci, NIE powinny mieć tych samych

Dodatkowe właściwości rezultatu operacji przeprowadzanej przez jednostkę arytmetyczno-logiczne ALU obejmują

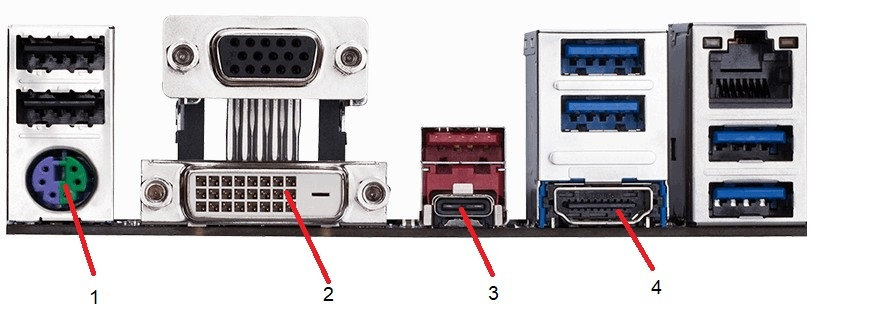

Na przedstawionym rysunku zaprezentowane jest złącze

Kiedy wygasa autorskie prawo majątkowe dotyczące programu komputerowego, stworzonego przez kilku programistów, którzy jako jego autorzy podpisali aplikację swoimi imionami i nazwiskami?

Do przeprowadzenia aktualizacji systemu Windows służy polecenie

W projekcie sieci komputerowej przewiduje się użycie fizycznych adresów kart sieciowych. Która warstwa modelu ISO/OSI odnosi się do tych adresów w komunikacji?

Jak nazywa się system, który pozwala na konwersję nazwy komputera na adres IP w danej sieci?

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

NOWY, GOTOWY, OCZEKUJĄCY oraz AKTYWNY to

Jakie rozszerzenia mają pliki instalacyjne systemu operacyjnego Linux?

W systemach operacyjnych z rodziny Windows odpowiednikiem programu fsck z systemu Linux jest aplikacja

Ile liczb w systemie szesnastkowym jest wymaganych do zapisania pełnej formy adresu IPv6?

Jakie urządzenie jest przedstawione na rysunku?

Jak zapisuje się liczbę siedem w systemie ósemkowym?

W dokumentacji technicznej głośników komputerowych producent może zamieścić informację, że największe pasmo przenoszenia wynosi

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

Urządzenie peryferyjne z interfejsem Mini-DIN podłącza się do gniazda oznaczonego na ilustracji

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

Wykonanie polecenia ipconfig /renew w trakcie ustawiania interfejsów sieciowych doprowadzi do

Wszystkie ustawienia użytkowników komputera są przechowywane w gałęzi rejestru oznaczonej akronimem

W metodzie archiwizacji danych nazwanej Dziadek – Ojciec – Syn na poziomie Dziadek przeprowadza się kopię danych na koniec

Przydzielaniem adresów IP w sieci zajmuje się serwer

Katalog Nakładów Rzeczowych w projektowaniu sieci służy do

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

Który protokół służy do wymiany danych o trasach oraz dostępności sieci pomiędzy routerami w ramach tego samego systemu autonomicznego?

Główny punkt, z którego odbywa się dystrybucja okablowania szkieletowego, to punkt

Aby osiągnąć przepustowość wynoszącą 4 GB/s w obie strony, konieczne jest zainstalowanie w komputerze karty graficznej korzystającej z interfejsu

Drukarką przeznaczoną do druku etykiet i kodów kreskowych, która drukuje poprzez roztapianie pokrycia specjalnej taśmy, w wyniku czego barwnik z niej zostaje przyklejony do materiału, na którym następuje drukowanie jest drukarka

Poprzez użycie opisanego urządzenia możliwe jest wykonanie diagnostyki działania