Pytanie 1

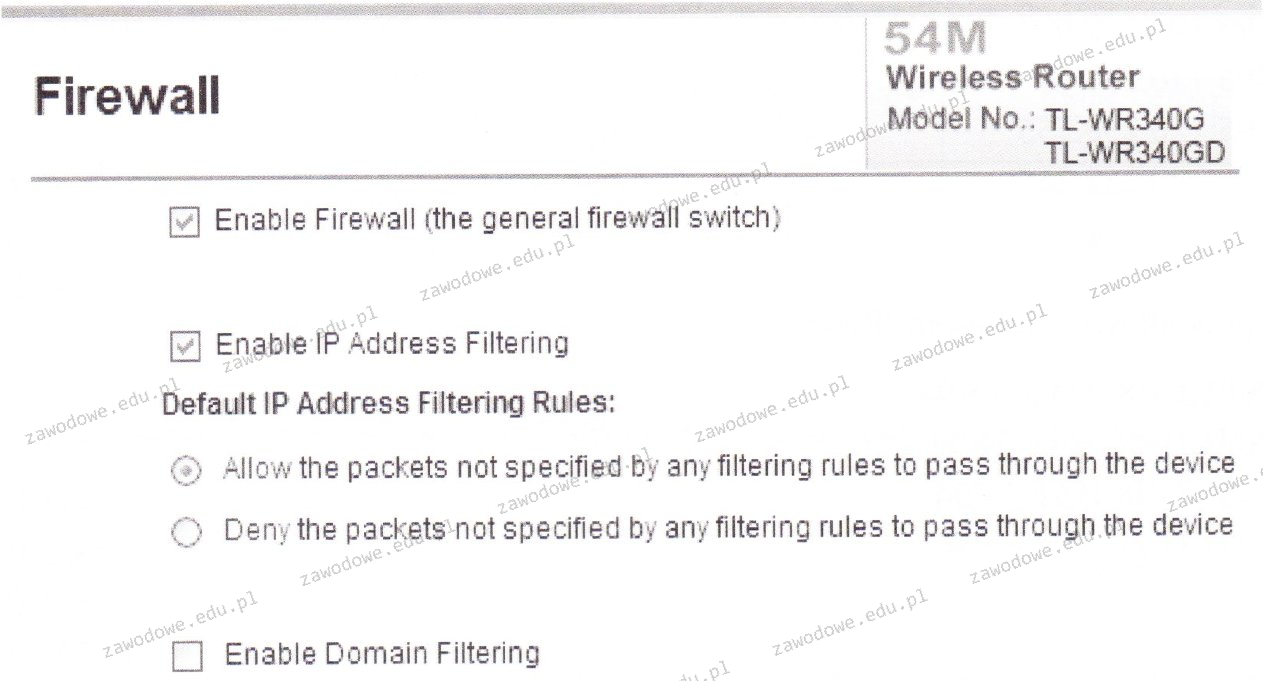

Na rysunku poniżej przedstawiono ustawienia zapory ogniowej w ruterze TL-WR340G. Jakie zasady dotyczące konfiguracji zapory zostały zastosowane?

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Na rysunku poniżej przedstawiono ustawienia zapory ogniowej w ruterze TL-WR340G. Jakie zasady dotyczące konfiguracji zapory zostały zastosowane?

Na podstawie przedstawionego w tabeli standardu opisu pamięci PC-100 wskaż pamięć, która charakteryzuje się maksymalnym czasem dostępu wynoszącym 6 nanosekund oraz minimalnym opóźnieniem między sygnałami CAS i RAS równym 2 cyklom zegara?

| Specyfikacja wzoru: PC 100-abc-def jednolitego sposobu oznaczania pamięci. | ||

| a | CL (ang. CAS Latency) | minimalna liczba cykli sygnału taktującego, liczona podczas operacji odczytu, od momentu uaktywnienia sygnału CAS, do momentu pojawienia się danych na wyjściu modułu DIMM (wartość CL wynosi zwykle 2 lub 3); |

| b | tRCD (ang. RAS to CAS Delay) | minimalne opóźnienie pomiędzy sygnałami RAS i CAS, wyrażone w cyklach zegara systemowego; |

| c | tRP (ang. RAS Precharge) | czas wyrażony w cyklach zegara taktującego, określający minimalną pauzę pomiędzy kolejnymi komendami, wykonywanymi przez pamięć; |

| d | tAC | Maksymalny czas dostępu (wyrażony w nanosekundach); |

| e | SPD Rev | specyfikacja komend SPD (parametr może nie występować w oznaczeniach); |

| f | Parametr zapasowy | ma wartość 0; |

Aby poprawić niezawodność i efektywność przesyłu danych na serwerze, należy

Aby zminimalizować różnice w kolorach pomiędzy zeskanowanymi obrazami prezentowanymi na monitorze a ich wersjami oryginalnymi, należy przeprowadzić

Jaki tryb funkcjonowania Access Pointa jest wykorzystywany do umożliwienia urządzeniom bezprzewodowym łączności z przewodową siecią LAN?

Zestaw narzędzi do instalacji okablowania miedzianego typu "skrętka" w sieci komputerowej powinien obejmować:

W przypadku adresacji IPv6, zastosowanie podwójnego dwukropka służy do

Który z systemów operacyjnych przeznaczonych do pracy w sieci jest dostępny na podstawie licencji GNU?

Serwer, który pozwala na udostępnianie usług drukowania oraz plików z systemu Linux dla stacji roboczych Windows, OS X i Linux, to

Wskaż ilustrację ilustrującą symbol stosowany do oznaczania portu równoległego LPT?

Jaką kwotę trzeba będzie zapłacić za wymianę karty graficznej w komputerze, jeśli koszt karty wynosi 250 zł, czas wymiany to 80 minut, a cena za każdą rozpoczętą roboczogodzinę to 50 zł?

Który z standardów korzysta z częstotliwości 5 GHz?

Na stabilność obrazu w monitorach CRT istotny wpływ ma

Głównym celem realizowanej przez program antywirusowy funkcji ochrony przed ransomware jest zapewnienie zabezpieczenia systemu przed zagrożeniami

Bęben światłoczuły stanowi kluczowy element w funkcjonowaniu drukarki

Do wykonania kopii danych na dysk USB w systemie Linux stosuje się polecenie

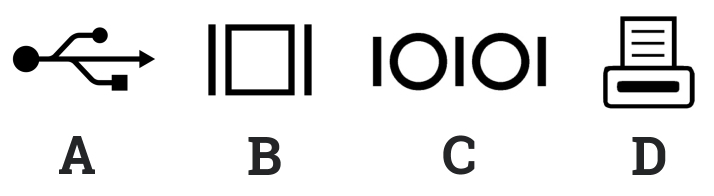

Graficzny symbol odnosi się do standardów sprzętowych

W których nośnikach pamięci masowej uszkodzenia mechaniczne są najbardziej prawdopodobne?

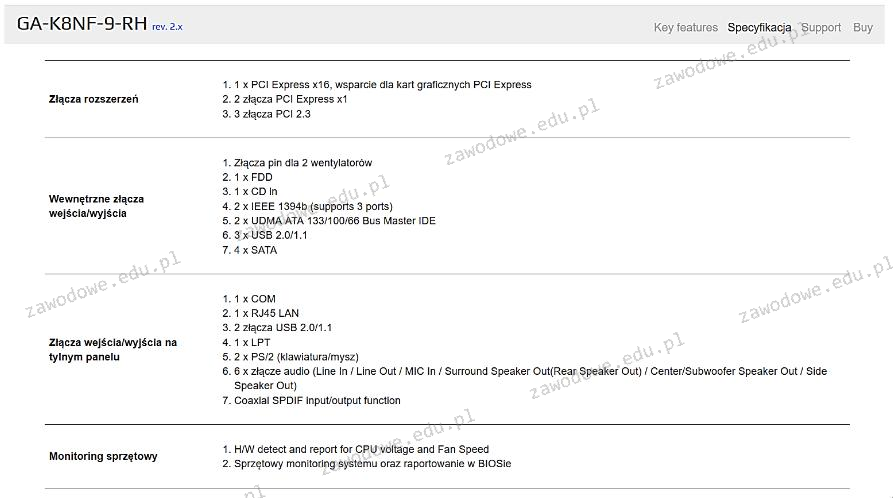

Na przedstawionym rysunku znajduje się fragment dokumentacji technicznej płyty głównej GA-K8NF-9-RH rev. 2.x. Z tego wynika, że maksymalna liczba kart rozszerzeń, które można zamontować (pomijając interfejs USB), wynosi

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Do zainstalowania serwera proxy w systemie Linux, konieczne jest zainstalowanie aplikacji

Na diagramie okablowania strukturalnego przy jednym z komponentów znajduje się oznaczenie MDF. Z którym punktem dystrybucji jest powiązany ten komponent?

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można określić, że ta pamięć

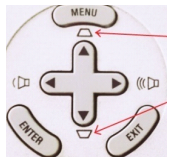

Na przedstawionej grafice wskazano strzałkami funkcje przycisków umieszczonych na obudowie projektora multimedialnego. Dzięki tym przyciskom można

W trakcie instalacji oraz konfiguracji serwera DHCP w systemach z rodziny Windows Server, można wprowadzić zastrzeżenia dla adresów, które będą definiować

Monitor CRT jest podłączany do karty graficznej przy użyciu złącza

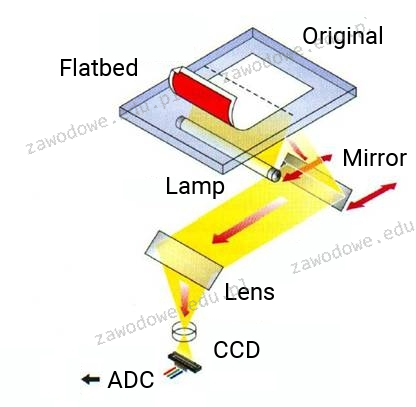

Zaprezentowany schemat ilustruje funkcjonowanie

Który z protokołów funkcjonuje w warstwie aplikacji modelu ISO/OSI, umożliwiając wymianę informacji kontrolnych między urządzeniami sieciowymi?

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

Jakie polecenie należy zastosować w konsoli odzyskiwania systemu Windows, aby poprawić błędne zapisy w pliku boot.ini?

Jakie oznaczenie potwierdza oszczędność energii urządzenia?

W normie PN-EN 50174 nie znajdują się wytyczne dotyczące

Jaki typ zabezpieczeń w sieciach WiFi oferuje najwyższy poziom ochrony?

Powszechnie stosowana forma oprogramowania, która funkcjonuje na zasadzie "najpierw wypróbuj, a potem kup", to

Aby poprawić organizację plików na dysku i przyspieszyć działanie systemu, co należy zrobić?

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

Nawiązywanie szyfrowanych połączeń pomiędzy hostami w sieci publicznej Internet, wykorzystywane w kontekście VPN (Virtual Private Network), to

Co oznacza skrót WAN?

Twórca zamieszczonego programu pozwala na jego darmowe korzystanie tylko w przypadku

| Ancient Domains of Mystery | |

|---|---|

| Autor | Thomas Biskup |

| Platforma sprzętowa | DOS, OS/2, Macintosh, Microsoft Windows, Linux |

| Pierwsze wydanie | 23 października 1994 |

| Aktualna wersja stabilna | 1.1.1 / 20 listopada 2002 r. |

| Aktualna wersja testowa | 1.2.0 Prerelease 18 / 1 listopada 2013 |

| Licencja | postcardware |

| Rodzaj | roguelike |

W jakim modelu płyty głównej można zainstalować procesor o wymienionych specyfikacjach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |