Pytanie 1

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia

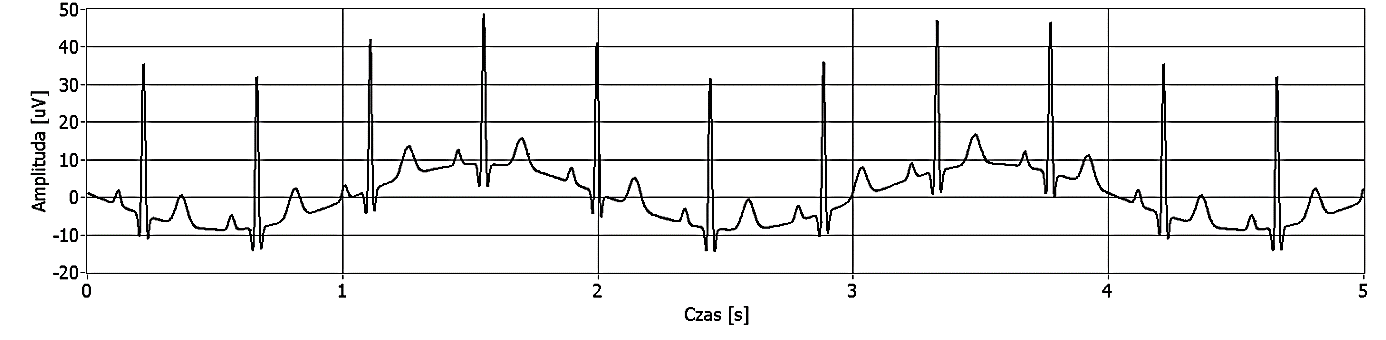

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

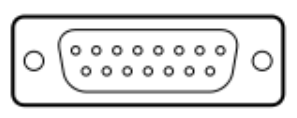

Urządzenie przedstawione na rysunku jest przeznaczone do

System informatyczny wymaga zabezpieczenia danych poprzez tworzenie kopii zapasowych. Dysponując 2 dyskami, można je połączyć w

Urządzenie do rejestracji bioelektrycznych potencjałów mięśniowych to

Operacja warunkowa w większości języków programowania wysokiego poziomu zaczyna się słowem

Który zasilacz pozwala na tymczasowe utrzymanie zasilania akumulatorowego w razie braku zasilania sieciowego?

Rejestr rozkazów procesora przechowuje

W systemie komputerowym przeznaczonym do pracy z dużymi plikami graficznymi należy zwiększyć ilość

Który podzespół komputerowy posiada obudowę o zamieszczonej specyfikacji?

| Specyfikacja obudowy | |

|---|---|

| Obsługiwane gniazda | LGA775 |

| TCASE | 71,4°C |

| Wymiary obudowy | 37,5 mm x 37,5 mm |

| Rozmiar płytki półprzewodnikowej | 214 mm² |

| Liczba tranzystorów płytki półprzewodnikowej | 820 milion |

| Dostępne opcje obniżonej zawartości halogenków | Patrz MDDS |

Organizm człowieka ma zakłóconą zdolność do termoregulacji, gdy wartość temperatury wewnętrznej organizmu spada poniżej

Na zdjęciu RTG najjaśniejsze pole stanowi tkanka kostna, przez którą promieniowanie rentgenowskie jest

Parametr dysku twardego określany skrótem MTBF oznacza średni czas

Podczas tworzenia bazy danych pacjentów polem unikatowym pełniącym rolę klucza podstawowego jest pole zawierające informacje o

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

Aby system komputerowy współpracujący z ultrasonografem mógł nagrywać na jednej płycie DVD dane z kolejnych, wykonywanych na bieżąco badań, musi być wyposażony w nagrywanie

Do zaktualizowania rekordu tabeli należy zastosować polecenie

W celu rejestracji promieniowania radioizotopu nagromadzonego w narządach stosowana jest

Jak nazywa się w programowaniu obiektowym instancję klasy?

Który system bazodanowy uniemożliwia bezpłatne zastosowanie komercyjne?

Niezbędna jest archiwizacja danych na płycie Blue-Ray jednokrotnego zapisu. Płyta taka ma oznaczenie

Przedstawione na rysunku i opisane w ramce narzędzie służy do ściągania izolacji

| Stripper posiada trzy otwory. Pierwszy pozwala na ściągnięcie płaszcza 250 μm do 125 μm. Drugi otwór przeznaczony jest do ściągania powłoki 900 μm do płaszcza o średnicy 250 μm. Trzeci służy do ściągania powłoki z kabli o średnicy 2 mm ÷ 3 mm do ścisłej tuby o średnicy 900 μm. |

Pojęcie „Architektura Harvardska” odnosi się do

Technologia dual channel dotyczy pracy dwóch takich samych

W celu zmiany hasła użytkownika w systemie Linux należy użyć polecenia

Konserwacja oprogramowania nie obejmuje

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

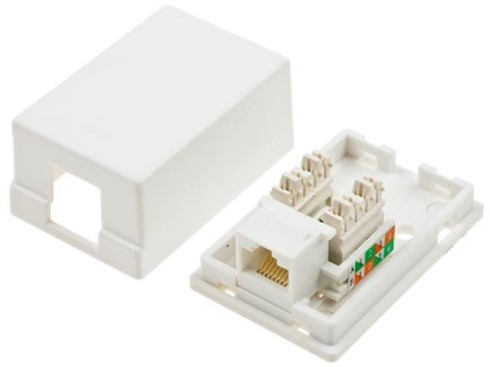

Montaż przewodów w sieciowym gniazdku natynkowym, przedstawionym na rysunku, wykonuje się

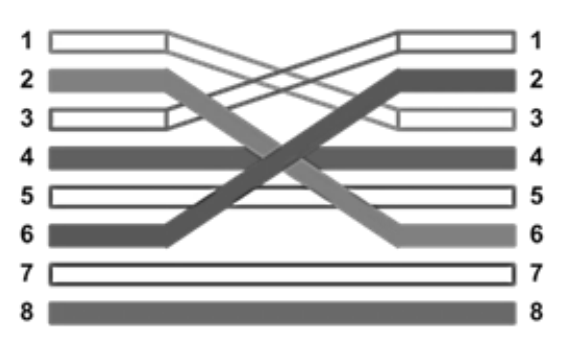

Przedstawiony na rysunku kabel krosowany jest wykorzystany do połączenia

Nie uzyskamy pomocy na temat polecenia „net” w wierszu poleceń systemu Windows wpisując

Ilość jodu-131 podana pacjentowi w terapii tarczycy zmniejszy się o połowę po

Do badań ultrasonograficznych struktur płytko położonych (np. tarczycy) stosuje się głowicę

Urządzenie, które w specyfikacji technicznej posiada zapis: „Urządzenie współpracuje z komputerem klasy PC poprzez złącze USB”, należy podłączyć do złącza oznaczonego piktogramem

Który system plików zapewnia największe bezpieczeństwo danych w systemie Windows?

Który endoskop pozwala na badanie wnętrza tchawicy i oskrzeli?

Struktura anatomiczna człowieka, która jest nazywana krytyczną ze względu na szczególną wrażliwość na zewnętrzne promieniowanie jonizujące, to

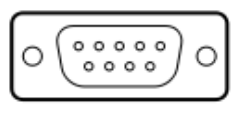

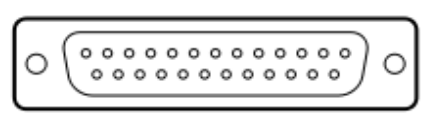

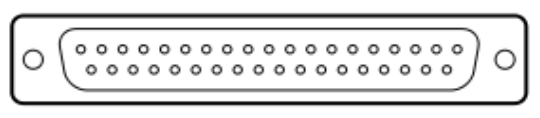

Do którego interfejsu (komunikacja z komputerem odbywa się poprzez port RS 232) należy podłączyć cykloergometr przeznaczony do współpracy z systemem do badań wysiłkowych?

Prezentacja A, B, M jest charakterystyczna dla badania

Aby zapobiec utracie danych w programie obsługi przychodni, należy codziennie wykonywać