Pytanie 1

Użycie polecenia net accounts w Wierszu poleceń systemu Windows, które ustawia maksymalny czas ważności hasła, wymaga zastosowania opcji

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Użycie polecenia net accounts w Wierszu poleceń systemu Windows, które ustawia maksymalny czas ważności hasła, wymaga zastosowania opcji

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

Jak nazywa się złącze wykorzystywane w sieciach komputerowych, pokazane na zamieszczonym obrazie?

Użytkownik systemu Windows napotyka komunikaty o zbyt małej ilości pamięci wirtualnej. W jaki sposób można rozwiązać ten problem?

Aby zweryfikować w systemie Windows działanie nowo zainstalowanej drukarki, co należy zrobić?

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

W drukarce laserowej do trwałego utrwalania druku na papierze wykorzystuje się

W systemie Windows do instalacji aktualizacji oraz przywracania sterowników urządzeń należy użyć przystawki

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Jakiej funkcji powinno się użyć, aby utworzyć kopię zapasową rejestru systemowego w programie regedit?

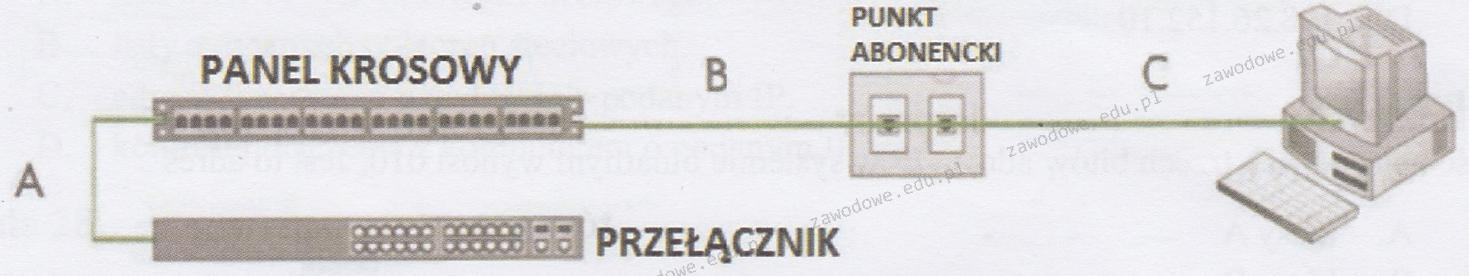

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

Jaki protokół jest stosowany wyłącznie w sieciach lokalnych, gdzie działają komputery z systemami operacyjnymi firmy Microsoft?

Który z wymienionych adresów należy do klasy C?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Oblicz koszt brutto materiałów niezbędnych do połączenia w sieć w topologii gwiazdy 3 komputerów wyposażonych w karty sieciowe, wykorzystując przewody o długości 2m. Ceny materiałów podano w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu "skrętka" | 1 zł za 1 metr |

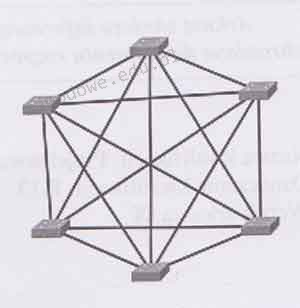

Jaki rodzaj fizycznej topologii w sieciach komputerowych jest pokazany na ilustracji?

Profil użytkownika systemu Windows, który można wykorzystać do logowania na dowolnym komputerze w sieci, przechowywany na serwerze i mogący być edytowany przez użytkownika, to profil

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 zapisany jest w formacie

Uruchomienie systemu Windows jest niemożliwe z powodu awarii oprogramowania. W celu przeprowadzenia jak najmniej inwazyjnej diagnostyki i usunięcia tej usterki, zaleca się

Wirusy polimorficzne mają jedną charakterystyczną cechę, którą jest

Który port stosowany jest przez protokół FTP (File Transfer Protocol) do przesyłania danych?

Do zainstalowania serwera proxy w systemie Linux, konieczne jest zainstalowanie aplikacji

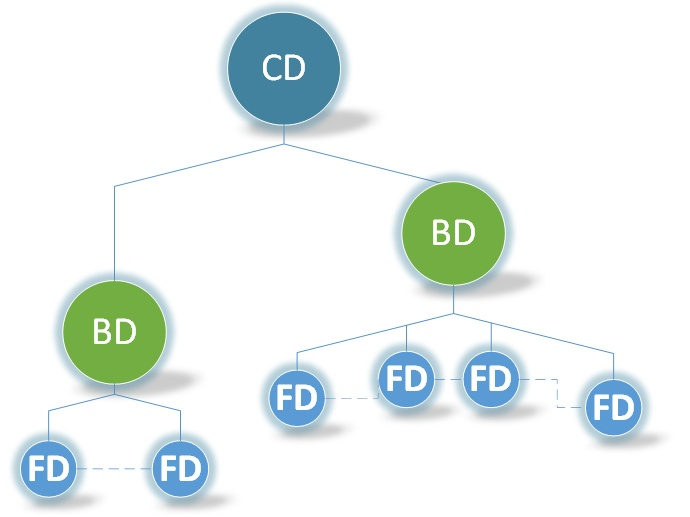

Przedstawiony schemat sieci kampusowej zawiera

Jak nazywa się seria procesorów produkowanych przez firmę Intel, charakteryzująca się małymi wymiarami oraz niskim zużyciem energii, zaprojektowana z myślą o urządzeniach mobilnych?

W systemie Linux polecenie touch jest używane do

Jakiego rodzaju fizycznej topologii sieci komputerowej dotyczy przedstawiony obrazek?

Do utworzenia skompresowanego archiwum danych w systemie Linux można użyć polecenia

Jaką kwotę trzeba będzie zapłacić za wymianę karty graficznej w komputerze, jeśli koszt karty wynosi 250 zł, czas wymiany to 80 minut, a cena za każdą rozpoczętą roboczogodzinę to 50 zł?

Powszechnie stosowana forma oprogramowania, która funkcjonuje na zasadzie "najpierw wypróbuj, a potem kup", to

Na rysunku znajduje się graficzny symbol

Aby poprawić bezpieczeństwo prywatnych danych sesji na stronie internetowej, zaleca się dezaktywację w ustawieniach przeglądarki

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików zapisanych na dysku twardym, konieczne jest wykonanie

Jaką usługę należy zainstalować na systemie Linux, aby umożliwić bezpieczny zdalny dostęp?

Podczas wyboru zasilacza do komputera kluczowe znaczenie

Który z poniższych interfejsów powinien być wybrany do podłączenia dysku SSD do płyty głównej komputera stacjonarnego, aby uzyskać najwyższą szybkość zapisu oraz odczytu danych?

Atak informatyczny, który polega na wyłudzaniu wrażliwych danych osobowych poprzez udawanie zaufanej osoby lub instytucji, nazywamy

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Przedstawiony na ilustracji symbol oznacza

W celu zainstalowania serwera proxy w systemie Linux, należy wykorzystać oprogramowanie