Pytanie 1

Jakie urządzenie jest przedstawione na rysunku?

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie jest przedstawione na rysunku?

Aby zainstalować usługę Active Directory w systemie Windows Server, konieczne jest uprzednie zainstalowanie oraz skonfigurowanie serwera

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który wymusza jego automatyczne aktualizacje, są

Kable światłowodowe nie są powszechnie używane w lokalnych sieciach komputerowych z powodu

Na ilustracji ukazano kartę

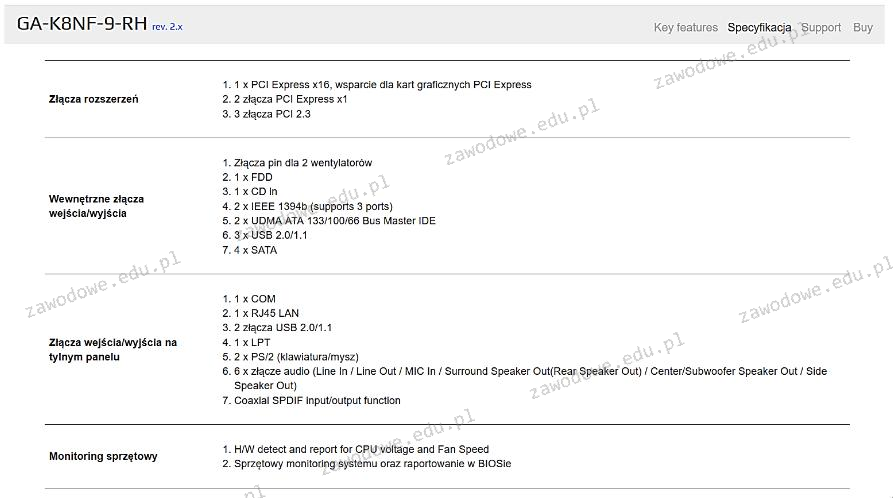

Na przedstawionym rysunku znajduje się fragment dokumentacji technicznej płyty głównej GA-K8NF-9-RH rev. 2.x. Z tego wynika, że maksymalna liczba kart rozszerzeń, które można zamontować (pomijając interfejs USB), wynosi

Ile adresów urządzeń w sieci jest dostępnych dzięki zastosowaniu klasy adresowej C w systemach opartych na protokołach TCP/IP?

Standard zwany IEEE 802.11, używany w lokalnych sieciach komputerowych, określa typ sieci:

Zasady filtrowania ruchu w sieci przez firewall określane są w formie

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

Impulsator pozwala na testowanie uszkodzonych systemów logicznych w komputerze, między innymi poprzez

W metodzie dostępu do medium CSMA/CD (Carrier Sense Multiple Access with Collision Detection) stacja planująca rozpoczęcie transmisji sprawdza, czy w sieci ma miejsce ruch, a następnie

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Jaką liczbę warstw określa model ISO/OSI?

Jakie jest IPv4 urządzenia znajdującego się w sieci 10.100.0.0/18?

Do jakiego celu służy program fsck w systemie Linux?

Na zamieszczonym zdjęciu widać

Wskaź zestaw do diagnostyki logicznych układów elektronicznych umiejscowionych na płycie głównej komputera, który nie reaguje na próby uruchomienia zasilania?

Technologia ADSL pozwala na nawiązanie połączenia DSL

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?

Aby utworzyć kontroler domeny w systemach z rodziny Windows Server na serwerze lokalnym, konieczne jest zainstalowanie roli

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Zadania systemu operacyjnego nie obejmują

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku

W celu zabezpieczenia komputerów w sieci lokalnej przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Dostosowanie ustawień parametrów TCP/IP urządzenia na podstawie adresu MAC karty sieciowej jest funkcją protokołu

Jak wygląda maska dla adresu IP 92.168.1.10/8?

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

Wskaż program w systemie Linux, który jest przeznaczony do kompresji plików?

Jakie polecenie w systemie operacyjnym Linux umożliwia sprawdzenie bieżącej konfiguracji interfejsu sieciowego na komputerze?

Aby uzyskać optymalną wydajność, karta sieciowa w komputerze stosuje transmisję szeregową.

Jakie oprogramowanie jest wykorzystywane do kontrolowania stanu dysków twardych?

Awaria klawiatury może być spowodowana przez uszkodzenie

Wskaź narzędzie przeznaczone do mocowania pojedynczych żył kabla miedzianego w złączach?

Jakie urządzenie należy wykorzystać do zestawienia komputerów w sieci przewodowej o strukturze gwiazdy?

Obecnie pamięci podręczne drugiego poziomu procesora (ang. "L-2 cache") są zbudowane z układów pamięci

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Miarą wyrażaną w decybelach, która określa różnicę pomiędzy mocą sygnału wysyłanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej, jest

Papier termotransferowy to materiał eksploatacyjny stosowany w drukarkach

Urządzeniem wykorzystywanym do formowania kształtów oraz grawerowania m.in. w materiałach drewnianych, szklanych i metalowych jest ploter