Pytanie 1

Jakie funkcje pełni usługa katalogowa Active Directory w systemach Windows Server?

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Jakie funkcje pełni usługa katalogowa Active Directory w systemach Windows Server?

Programem wykorzystywanym w systemie Linux do odtwarzania muzyki jest

Typowym objawem wskazującym na zbliżającą się awarię dysku twardego jest pojawienie się

Jakie polecenie należy wydać, aby skonfigurować statyczny routing do sieci 192.168.10.0?

Który z standardów korzysta z częstotliwości 5 GHz?

Zastosowanie której zasady zwiększy bezpieczeństwo podczas korzystania z portali społecznościowych?

Oblicz całkowity koszt kabla UTP Cat 6, który służy do połączenia 5 punktów abonenckich z punktem dystrybucyjnym, wiedząc, że średnia długość między punktem abonenckim a punktem dystrybucyjnym wynosi 8m oraz że cena brutto za 1m kabla to 1zł. W obliczeniach uwzględnij dodatkowy zapas 2m kabla dla każdego punktu abonenckiego.

W przypadku awarii którego urządzenia w sieci lokalnej, cała sieć przestaje działać w topologii magistrali?

Najszybszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Zrzut ekranu ilustruje wynik polecenia arp -a. Jak należy zrozumieć te dane?

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

Co nie ma wpływu na utratę danych z dysku HDD?

Program do odzyskiwania danych, stosowany w warunkach domowych, umożliwia przywrócenie danych z dysku twardego w sytuacji

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można wymienić na model z gniazdem, nie zmieniając procesora i pamięci

Urządzenie pokazane na ilustracji jest przeznaczone do

Urządzenie elektryczne lub elektroniczne, które zostało zużyte i posiada znak widoczny na ilustracji, powinno być

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jednym z typowych symptomów mogących świadczyć o nadchodzącej awarii dysku twardego jest wystąpienie

Jakie informacje zwraca polecenie netstat -a w systemie Microsoft Windows?

Na ilustracji zaprezentowano strukturę topologiczną

Zintegrowana karta sieciowa na płycie głównej uległa awarii. Komputer nie może załadować systemu operacyjnego, ponieważ brakuje zarówno dysku twardego, jak i napędów optycznych, a system operacyjny jest uruchamiany z lokalnej sieci. W celu przywrócenia utraconej funkcjonalności, należy zainstalować w komputerze

W topologii elementem centralnym jest switch

Narzędzie systemów operacyjnych Windows używane do zmiany ustawień interfejsów sieciowych, na przykład przekształcenie dynamicznej konfiguracji karty sieciowej w konfigurację statyczną, to

Osoba korzystająca z komputera udostępnia w sieci Internet pliki, które posiada. Prawa autorskie będą złamane, gdy udostępni

Który zakres adresów IPv4 jest poprawnie przypisany do danej klasy?

| Zakres adresów IPv4 | Klasa adresu IPv4 | |

|---|---|---|

| A. | 1.0.0.0 ÷ 127.255.255.255 | A |

| B. | 128.0.0.0 ÷ 191.255.255.255 | B |

| C. | 192.0.0.0 ÷ 232.255.255.255 | C |

| D. | 233.0.0.0 ÷ 239.255.255.255 | D |

Aby umożliwić transfer danych między siecią w pracowni a siecią ogólnoszkolną o innej adresacji IP, należy zastosować

Który protokół odpowiada za bezpieczne przesyłanie danych w sieciach komputerowych?

Po zainstalowaniu z domyślnymi uprawnieniami, system Windows XP nie obsługuje formatu systemu plików

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Które z urządzeń używanych w sieciach komputerowych nie modyfikuje liczby kolizyjnych domen?

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Interfejs UDMA to typ interfejsu

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

Za przypisanie czasu procesora do wyznaczonych zadań odpowiada

W systemie Linux polecenie chmod 321 start spowoduje nadanie następujących uprawnień plikowi start:

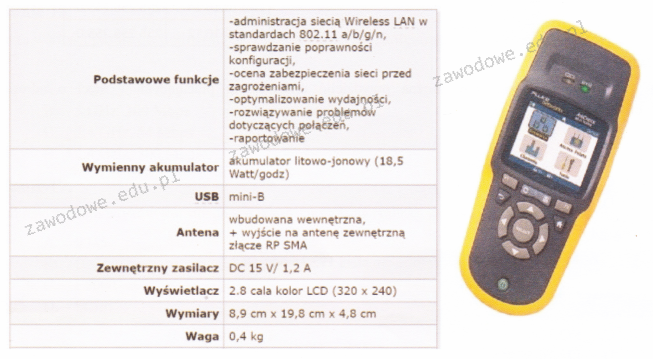

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Ile podsieci obejmują komputery z adresami: 192.168.5.12/25, 192.168.5.200/25 oraz 192.158.5.250/25?

Jak nazywa się jednostka danych PDU w warstwie sieciowej modelu ISO/OSI?

W jednostce ALU do akumulatora została zapisana liczba dziesiętna 240. Jak wygląda jej reprezentacja w systemie binarnym?