Pytanie 1

Jaką maksymalną długość może mieć kabel miedziany UTP kategorii 5e łączący bezpośrednio dwa urządzenia w sieci, według standardu Fast Ethernet 100Base-TX?

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Jaką maksymalną długość może mieć kabel miedziany UTP kategorii 5e łączący bezpośrednio dwa urządzenia w sieci, według standardu Fast Ethernet 100Base-TX?

Jakie urządzenie pełni rolę wskaźnika?

Farad to jednostka

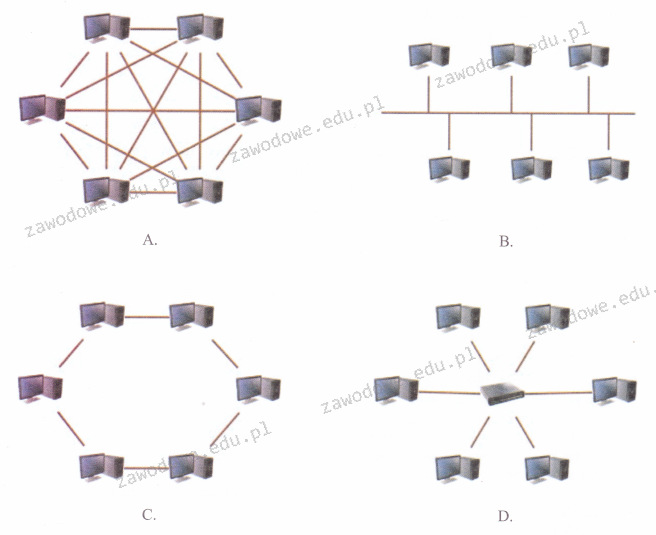

Która z zaprezentowanych na rysunkach topologii odpowiada topologii siatki?

Która norma określa parametry transmisji dla komponentów kategorii 5e?

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Aby zapewnić, że komputer uzyska od serwera DHCP określony adres IP, należy na serwerze zdefiniować

Medium transmisyjne, które jest odporne na zakłócenia elektromagnetyczne i atmosferyczne, to

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

Aby zapewnić możliwość odzyskania ważnych danych, należy regularnie

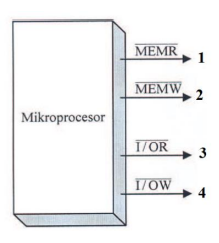

Sygnał kontrolny generowany przez procesor, umożliwiający zapis do urządzeń wejściowych i wyjściowych, został na diagramie oznaczony numerem

Protokół, który pozwala na ściąganie wiadomości e-mail z serwera, to

Rekord startowy dysku twardego w komputerze to

Aby połączyć projektor multimedialny z komputerem, należy unikać użycia złącza

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm

Jakim adresem IPv6 charakteryzuje się autokonfiguracja łącza?

W hierarchicznym modelu sieci, komputery należące do użytkowników są składnikami warstwy

W systemie adresacji IPv6 adres ff00::/8 definiuje

Administrator powinien podzielić adres 10.0.0.0/16 na 4 jednorodne podsieci zawierające równą liczbę hostów. Jaką maskę będą miały te podsieci?

Co jest głównym zadaniem protokołu DHCP?

Protokół SNMP (Simple Network Management Protocol) jest wykorzystywany do

Jakim złączem zasilany jest wewnętrzny dysk twardy typu IDE?

Wskaź 24-pinowe lub 29-pinowe złącze żeńskie, które jest w stanie przesyłać skompresowany sygnał cyfrowy do monitora?

Najskuteczniejszym sposobem na ochronę komputera przed wirusami jest zainstalowanie

Usługi na serwerze są konfigurowane za pomocą

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Do jakich celów powinno się aktywować funkcję RMON (Remote Network Monitoring) w przełączniku?

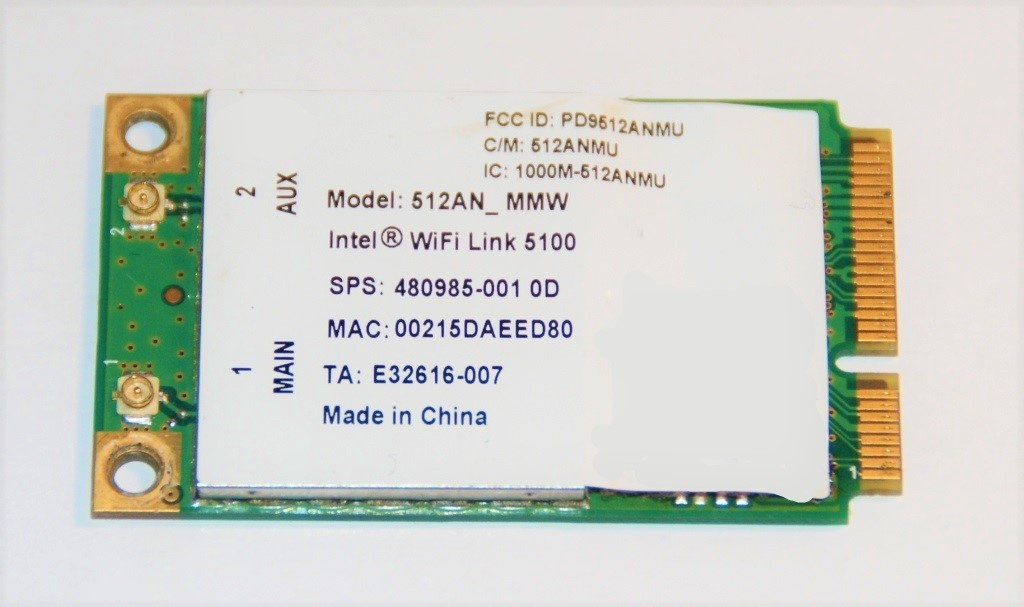

Na ilustracji przedstawiono

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku

GRUB, LILO, NTLDR to

Narzędzie służące do oceny wydajności systemu komputerowego to

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Podczas pracy komputera nastąpił samoczynny twardy reset. Przyczyną resetu najprawdopodobniej jest

Podstawowym zadaniem mechanizmu Plug and Play jest

Który zakres adresów IPv4 jest poprawnie przypisany do danej klasy?

| Zakres adresów IPv4 | Klasa adresu IPv4 | |

|---|---|---|

| A. | 1.0.0.0 ÷ 127.255.255.255 | A |

| B. | 128.0.0.0 ÷ 191.255.255.255 | B |

| C. | 192.0.0.0 ÷ 232.255.255.255 | C |

| D. | 233.0.0.0 ÷ 239.255.255.255 | D |

Użytkownicy z grupy Pracownicy nie mają możliwości drukowania dokumentów za pomocą serwera wydruku w systemie Windows Server. Posiadają oni jedynie uprawnienia do „Zarządzania dokumentami”. Jakie kroki należy podjąć, aby naprawić ten problem?

Która z poniższych informacji odnosi się do profilu tymczasowego użytkownika?

Użytkownik systemu Windows może skorzystać z polecenia taskmgr, aby

Mamy do czynienia z siecią o adresie 192.168.100.0/24. Ile podsieci można utworzyć, stosując maskę 255.255.255.224?

Jakie czynności należy wykonać, aby oczyścić zatkane dysze kartridża w drukarce atramentowej?