Pytanie 1

Thunderbolt to interfejs

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Thunderbolt to interfejs

Zbiór usług sieciowych dla systemów z rodziny Microsoft Windows jest reprezentowany przez skrót

Jakie jest najbardziej typowe dla topologii gwiazdy?

Typ profilu użytkownika w systemie Windows Serwer, który nie zapisuje zmian wprowadzonych na bieżącym pulpicie ani na serwerze, ani na stacji roboczej po wylogowaniu, to profil

Jak skrót wskazuje na rozległą sieć komputerową, która obejmuje swoim zasięgiem miasto?

Który adres IP jest zaliczany do klasy B?

Polecenie uname -s w systemie Linux służy do identyfikacji

Które z wymienionych mediów nie jest odpowiednie do przesyłania danych teleinformatycznych?

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Jakie urządzenie jest używane do pomiaru wartości rezystancji?

Cechą charakterystyczną transmisji za pomocą interfejsu równoległego synchronicznego jest to, że

Według modelu TCP/IP, protokoły DNS, FTP oraz SMTP zaliczają się do warstwy

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaki jest adres broadcastowy dla sieci posiadającej adres IP 192.168.10.0/24?

Aby osiągnąć przepustowość 4 GB/s w obydwie strony, konieczne jest zainstalowanie w komputerze karty graficznej używającej interfejsu

Tworzenie obrazu dysku ma na celu

Profil użytkownika systemu Windows, który można wykorzystać do logowania na dowolnym komputerze w sieci, przechowywany na serwerze i mogący być edytowany przez użytkownika, to profil

Które z urządzeń sieciowych funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

Aby sygnały pochodzące z dwóch routerów w sieci WiFi pracującej w standardzie 802.11g nie wpływały na siebie nawzajem, należy skonfigurować kanały o numerach

Reprezentacja koloru RGB(255, 170, 129) odpowiada formatowi

Wykonując polecenie ipconfig /flushdns, można przeprowadzić konserwację urządzenia sieciowego, która polega na

Dokumentacja końcowa zaprojektowanej sieci LAN powinna zawierać między innymi

Program o nazwie dd, którego przykład użycia przedstawiono w systemie Linux, umożliwia:

dd if=/dev/sdb of=/home/uzytkownik/Linux.iso

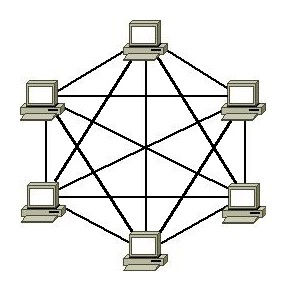

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

W systemie Windows, gdzie należy ustalić wymagania dotyczące złożoności hasła?

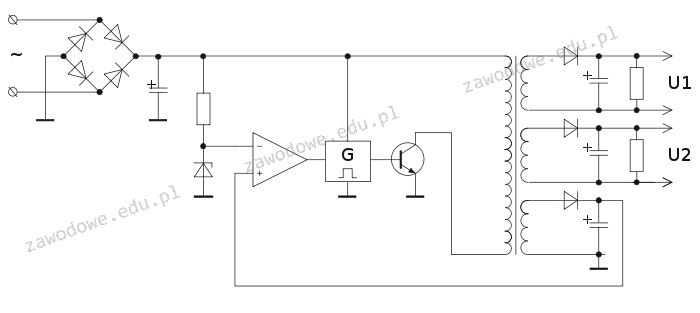

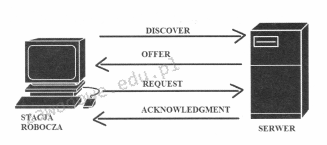

Na rysunku ukazano diagram

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Urządzenie pokazane na ilustracji służy do zgrzewania wtyków

Podstawowym zadaniem mechanizmu Plug and Play jest:

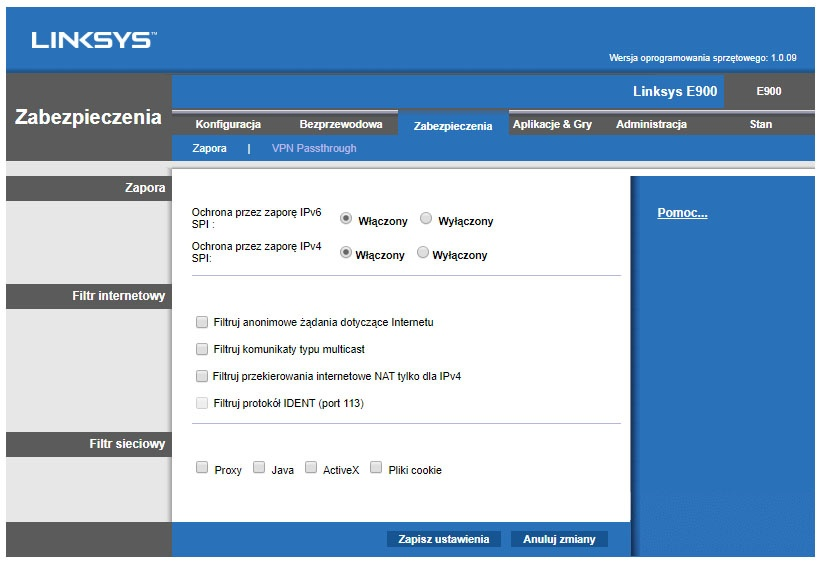

Na ilustracji przedstawiono okno konfiguracji rutera. Wskaż opcję, która wpływa na zabezpieczenie urządzenia przed atakami DDoS.

Mechanizm, który pozwala na podłączenie urządzeń peryferyjnych do systemu komputerowego, w którym każde urządzenie jest identyfikowane przez przypisany mu numer, to

Po włączeniu komputera wyświetlił się komunikat: "non-system disk or disk error. Replace and strike any key when ready". Jakie mogą być przyczyny?

Jak nazywa się kod kontrolny, który służy do wykrywania błędów oraz potwierdzania poprawności danych odbieranych przez stację końcową?

Proces, który uniemożliwia całkowicie odzyskanie danych z dysku twardego, to

Co robi polecenie Gpresult?

CommView oraz WireShark to aplikacje wykorzystywane do

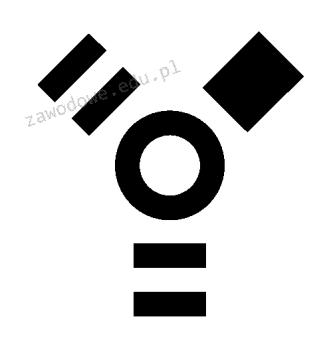

Symbol graficzny przedstawiony na ilustracji oznacza złącze

Którego protokołu działanie zostało zobrazowane na załączonym rysunku?

Aby uporządkować dane pliku na dysku twardym, zapisane w klastrach, które nie sąsiadują ze sobą, tak aby znajdowały się w sąsiadujących klastrach, należy przeprowadzić