Pytanie 1

W celu ochrony lokalnej sieci komputerowej przed atakami typu Smurf pochodzącymi z Internetu, należy zainstalować oraz właściwie skonfigurować

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W celu ochrony lokalnej sieci komputerowej przed atakami typu Smurf pochodzącymi z Internetu, należy zainstalować oraz właściwie skonfigurować

Kluczowym mechanizmem zabezpieczającym dane przechowywane na serwerze jest

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Wskaż zewnętrzny protokół rutingu?

Przedstawiony symbol znajdujący się na obudowie komputera stacjonarnego oznacza ostrzeżenie przed

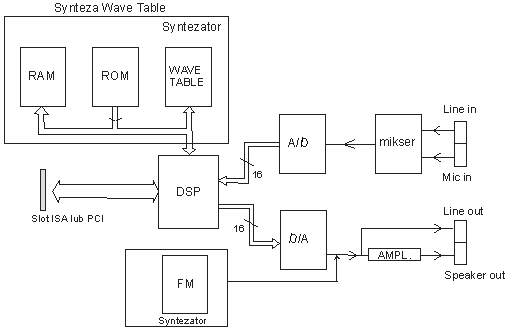

Który z elementów przedstawionych na diagramie karty dźwiękowej na rysunku jest odpowiedzialny za cyfrowe przetwarzanie sygnałów?

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku

Ile urządzeń jest w stanie współpracować z portem IEEE1394?

Do instalacji i usuwania oprogramowania w systemie Ubuntu wykorzystywany jest menedżer

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

Które z poniższych stwierdzeń odnosi się do sieci P2P - peer to peer?

Usługa w systemie Windows Server, która umożliwia zdalną instalację systemów operacyjnych na komputerach zarządzanych przez serwer, to

Który z początkowych znaków w nazwie pliku w systemie Windows wskazuje na plik tymczasowy?

Który standard z rodziny IEEE 802 odnosi się do sieci bezprzewodowych, zwanych Wireless LAN?

Komputer jest połączony z siecią Internetową i nie posiada zainstalowanego oprogramowania antywirusowego. Jak można sprawdzić, czy ten komputer jest zainfekowany wirusem, nie wchodząc w ustawienia systemowe?

Według normy PN-EN 50174 maksymalny rozplot kabla UTP powinien wynosić nie więcej niż

Jak można zwolnić miejsce na dysku, nie tracąc przy tym danych?

Karta sieciowa w standardzie Fast Ethernet umożliwia przesył danych z maksymalną prędkością

Aby mieć możliwość tworzenia kont użytkowników, komputerów oraz innych obiektów, a także centralnego przechowywania informacji o nich, konieczne jest zainstalowanie na serwerze Windows roli

W dokumentacji technicznej wydajność głośnika połączonego z komputerem wyraża się w jednostce:

Jaki sterownik drukarki jest uniwersalny dla różnych urządzeń oraz systemów operacyjnych i stanowi standard w branży poligraficznej?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie polecenie w systemie Linux umożliwia wyświetlenie identyfikatora użytkownika?

Odnalezienie głównego rekordu rozruchowego, wczytującego system z aktywnej partycji umożliwia

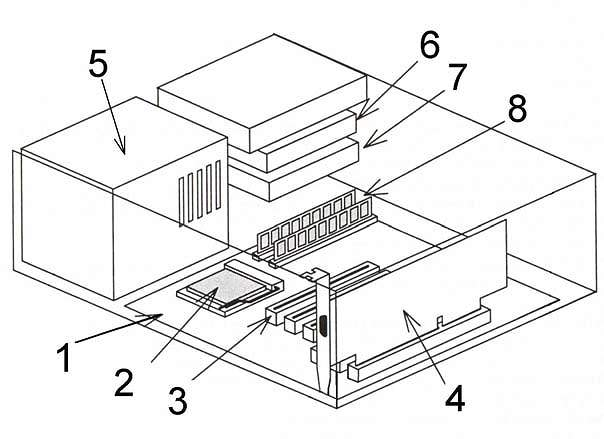

Na ilustracji procesor jest oznaczony liczbą

Jakie funkcje posiada program tar?

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można wymienić na model z gniazdem, nie zmieniając procesora i pamięci

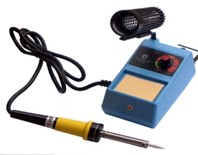

Przedstawione narzędzie podczas naprawy zestawu komputerowego przeznaczone jest do

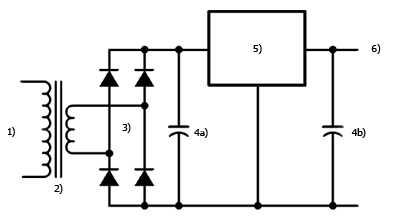

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Na wyświetlaczu drukarki widnieje komunikat "PAPER JAM". Aby zlikwidować problem, należy w pierwszej kolejności

Przed dokonaniem zakupu komponentu komputera lub urządzenia peryferyjnego na platformach aukcyjnych, warto zweryfikować, czy nabywane urządzenie ma wymagany w Polsce certyfikat

Aby naprawić wskazaną awarię, należy

|

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

Które narzędzie należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

Który z poniższych protokołów jest wykorzystywany do uzyskiwania dynamicznych adresów IP?

Jednym z programów stosowanych do tworzenia kopii zapasowych partycji oraz dysków jest

Do realizacji iloczynu logicznego z negacją należy użyć funktora

Rekord startowy dysku twardego w komputerze to

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem