Pytanie 1

Termin określający zdolność do rozbudowy sieci to

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Termin określający zdolność do rozbudowy sieci to

Topologia fizyczna sieci komputerowej przedstawiona na ilustracji to topologia

W celu konserwacji elementów z łożyskami oraz ślizgami w urządzeniach peryferyjnych wykorzystuje się

Dwie stacje robocze w tej samej sieci nie są w stanie się skomunikować. Która z poniższych okoliczności może być przyczyną opisanego problemu?

Funkcję S.M.A.R.T. w twardym dysku, która jest odpowiedzialna za nadzorowanie i wczesne ostrzeganie o możliwych awariach, można uruchomić poprzez

Wskaż błędny podział dysku MBR na partycje?

Na ilustracji widoczna jest pamięć operacyjna

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Adres IP urządzenia umożliwiającego innym komputerom w sieci lokalnej dostęp do Internetu, to adres

Komunikat tekstowy KB/Interface error, wyświetlony na ekranie komputera z BIOS POST firmy AMI, informuje o błędzie

Jakie urządzenie stosuje się do pomiaru rezystancji?

Ikona z wykrzyknikiem, którą widać na ilustracji, pojawiająca się przy nazwie urządzenia w Menedżerze urządzeń, wskazuje, że to urządzenie

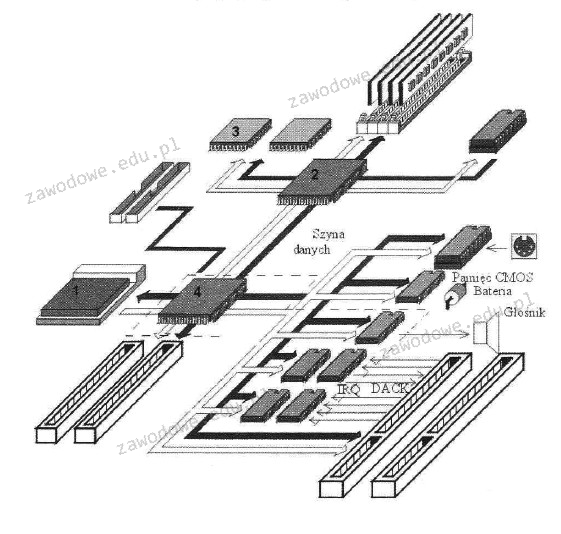

Jaką liczbą oznaczono procesor na diagramie płyty głównej komputera?

Jakie urządzenie pozwala na podłączenie kabla światłowodowego wykorzystywanego w okablowaniu pionowym sieci do przełącznika z jedynie gniazdami RJ45?

Przed dokonaniem zakupu komponentu komputera lub urządzenia peryferyjnego na platformach aukcyjnych, warto zweryfikować, czy nabywane urządzenie ma wymagany w Polsce certyfikat

W specyfikacji głośników komputerowych producent mógł podać informację, że maksymalne pasmo przenoszenia wynosi

Który z parametrów czasowych w pamięci RAM określany jest jako czas dostępu?

Czym jest procesor Athlon 2800+?

Jaką wartość w systemie szesnastkowym ma liczba 1101 0100 0111?

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

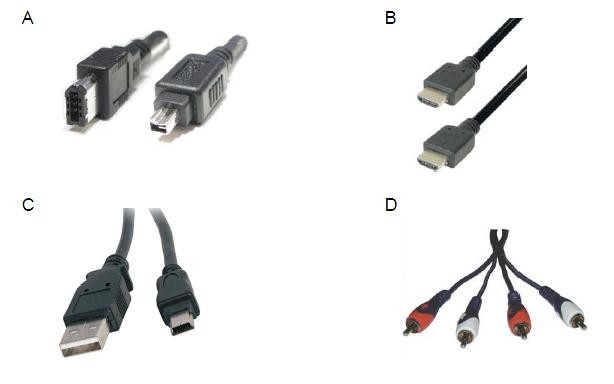

Aby połączyć cyfrową kamerę z interfejsem IEEE 1394 (FireWire) z komputerem, wykorzystuje się kabel z wtykiem zaprezentowanym na fotografii

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

Na stronie wydrukowanej w drukarce atramentowej pojawiają się smugi, kropki, kleksy i plamy. Aby rozwiązać problemy z jakością wydruku, należy

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W jakim typie skanera stosuje się fotopowielacze?

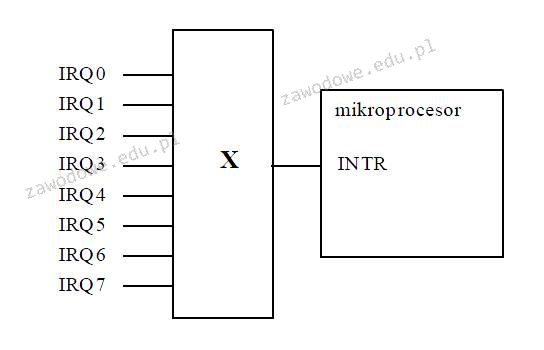

Numer przerwania przypisany do karty sieciowej został zapisany w systemie binarnym jako 10101. Ile to wynosi w systemie dziesiętnym?

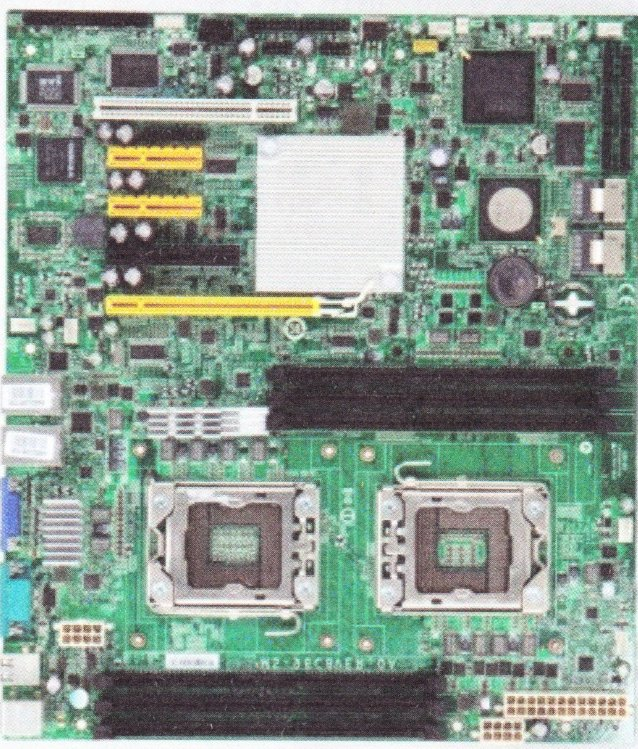

W komputerze użyto płyty głównej widocznej na obrazku. Aby podnieść wydajność obliczeniową maszyny, zaleca się

Na podstawie nazw sygnałów sterujących zidentyfikuj funkcję komponentu komputera oznaczonego na schemacie symbolem X?

Przy pomocy testów statycznych okablowania można zidentyfikować

Jakie urządzenie powinno się wykorzystać, aby rozszerzyć zasięg sieci bezprzewodowej w obiekcie?

Sprzęt, który umożliwia konfigurację sieci VLAN, to

Jakie polecenie w systemie Windows służy do monitorowania bieżących połączeń sieciowych?

Zamianę uszkodzonych kondensatorów w karcie graficznej umożliwi

Jakie urządzenie stosuje technikę polegającą na wykrywaniu zmian w pojemności elektrycznej podczas manipulacji kursorem na monitorze?

Błąd typu STOP Error (Blue Screen) w systemie Windows, który wiąże się z odniesieniem się systemu do niepoprawnych danych w pamięci RAM, to

Jakiego typu wkrętak należy użyć do wypięcia dysku twardego mocowanego w laptopie za pomocą podanych śrub?

Parametry katalogowe przedstawione w ramce dotyczą dysku twardego

| ST31000528AS |

| Seagate Barracuda 7200.12 ,32 MB, |

| Serial ATA/300, Heads 4, Capacity 1TB |

Wskaż interfejsy płyty głównej widoczne na rysunku.

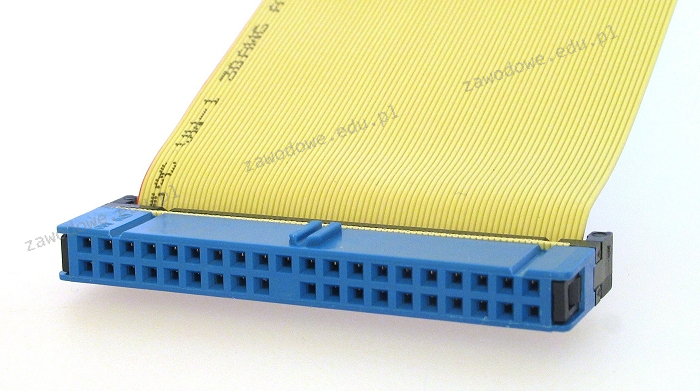

Na ilustracji przedstawiono taśmę (kabel) złącza

Magistrala PCI-Express stosuje do przesyłania danych metodę komunikacji