Pytanie 1

Jak nazywa się bezklasowa metoda podziału przestrzeni adresowej IPv4?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Jak nazywa się bezklasowa metoda podziału przestrzeni adresowej IPv4?

Użytkownik systemu Windows wybrał opcję powrót do punktu przywracania. Które pliki powstałe po wybranym punkcie nie zostaną naruszone przez tę akcję?

Jakie narzędzie wraz z odpowiednimi parametrami należy zastosować w systemie Windows, aby uzyskać przedstawione informacje o dysku twardym?

ST9500420AS Identyfikator dysku : A67B7C06 Typ : ATA Stan : Online Ścieżka : 0 Element docelowy : 0 Identyfikator jednostki LUN: 0 Ścieżka lokalizacji : PCIROOT(0)#ATA(C00T00L00) Bieżący stan tylko do odczytu : Nie Tylko do odczytu: Nie Dysk rozruchowy : Tak Dysk plików stronicowania: Tak Dysk plików hibernacji: Nie Dysk zrzutów awaryjnych: Tak Dysk klastrowany: Nie Wolumin ### Lit Etykieta Fs Typ Rozmiar Stan Info ----------- --- ----------- ----- ------------ ------- ------- -------- Wolumin 1 SYSTEM NTFS Partycja 300 MB Zdrowy System Wolumin 2 C NTFS Partycja 445 GB Zdrowy Rozruch Wolumin 3 D HP_RECOVERY NTFS Partycja 15 GB Zdrowy Wolumin 4 E HP_TOOLS FAT32 Partycja 5122 MB Zdrowy

Podane dane katalogowe odnoszą się do routera z wbudowaną pamięcią masową

| CPU | AtherosAR7161 680MHz |

| Memory | 32MB DDR SDRAM onboard memory |

| Boot loader | RouterBOOT |

| Data storage | 64MB onboard NAND memory chip |

| Ethernet | One 10/100 Mbit/s Fast Ethernet port with Auto-MDI/X |

| miniPCI | One MiniPCI Type IIIA/IIIB slot One MiniPCIe slot for 3G modem only (onboard SIM connector) |

| Wireless | Built in AR2417 802. 11 b/g wireless, 1x MMCX connector |

| Expansion | One USB 2.0 ports (without powering, needs power adapter, available separately) |

| Serial port | One DB9 RS232C asynchronous serial port |

| LEDs | Power, NAND activity, 5 user LEDs |

| Power options | Power over Ethernet: 10..28V DC (except power over datalines). Power jack: 10..28V DC. Includes voltage monitor |

| Dimensions | 105 mm x 105 mm, Weight: 82 g |

| Power consumption | Up to 5W with wireless at full activity |

| Operating System | MikroTik RouterOS v3, Level4 license |

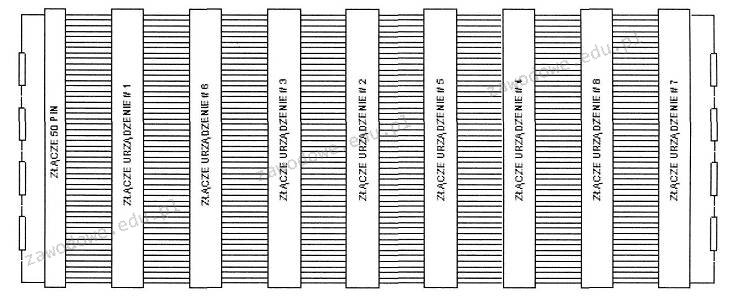

Który z interfejsów można uznać za interfejs równoległy?

Obrazek ilustruje rezultat działania programu

│ ├── Checkbox_checked.svg │ └── Checkbox_unchecked.svg │ ├── revisions.txt │ ├── tools │ │ ├── howto.txt │ │ ├── Mangler │ │ │ ├── make.sh │ │ │ └── src │ │ │ └── Mangler.java │ │ └── WiFi101 │ │ ├── tool │ │ │ └── firmwares │ │ │ ├── 19.4.4 │ │ │ │ ├── m2m_aio_2b0.bin │ │ │ │ └── m2m_aio_3a0.bin │ │ │ └── 19.5.2 │ │ │ └── m2m_aio_3a0.bin │ │ └── WiFi101.jar │ ├── tools-builder │ │ └── ctags │ │ └── 5.8-arduino11 │ │ └── ctags │ └── uninstall.sh └── brother └── PTouch └── ql570 └── cupswrapper ├── brcupsconfpt1 └── cupswrapperql570pt1

Za pomocą taśmy 60-pinowej pokazanej na ilustracji łączy się z płytą główną komputera

W wyniku wykonania komendy: net user w terminalu systemu Windows, pojawi się

Wykonanie polecenia attrib +h +s +r przykład.txt w terminalu systemu Windows spowoduje

W architekturze sieci lokalnych opartej na modelu klient - serwer

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

Sprzęt używany w sieciach komputerowych, posiadający dedykowane oprogramowanie do blokowania nieautoryzowanego dostępu do sieci, to

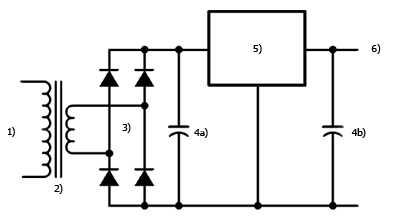

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Do realizacji alternatywy logicznej z negacją należy użyć funktora

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaką postać ma liczba dziesiętna 512 w systemie binarnym?

Zestaw uzupełniający, składający się ze strzykawki z fluidem, igły oraz rękawiczek zabezpieczających, służy do uzupełnienia pojemników z nośnikiem drukującym w drukarkach

Głowica drukująca, składająca się z wielu dysz zintegrowanych z mechanizmem drukarki, wykorzystywana jest w drukarce

Jaką minimalną rozdzielczość powinna wspierać karta graficzna, aby możliwe było odtwarzanie materiału wideo w trybie Full HD na 23-calowym monitorze?

Jaką topologię fizyczną charakteryzuje zapewnienie nadmiarowych połączeń między urządzeniami sieciowymi?

Jakie zastosowanie ma narzędzie tracert w systemach operacyjnych rodziny Windows?

Domyślnie dostęp anonimowy do zasobów serwera FTP umożliwia

Jakie urządzenie wykorzystuje się do pomiaru napięcia w zasilaczu?

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

Jakie urządzenie sieciowe funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

Określ adres sieci, do której przypisany jest host o adresie 172.16.0.123/27?

Który kolor żyły znajduje się w kablu skrętkowym?

Zgodnie z aktualnymi normami BHP, zalecana odległość oczu od ekranu monitora powinna wynosić

W tabeli przedstawiono numery podzespołów, które są ze sobą kompatybilne

| Lp. | Podzespół | Parametry |

|---|---|---|

| 1. | Procesor | INTEL COREi3-4350- 3.60 GHz, x2/4, 4 MB, 54W, HD 4600, BOX, s-1150 |

| 2. | Procesor | AMD Ryzen 7 1800X, 3.60 GHz, 95W, s-AM4 |

| 3. | Płyta główna | GIGABYTE ATX, X99, 4x DDR3, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

| 4. | Płyta główna | Asus CROSSHAIR VI HERO, X370, SATA3, 4xDDR4, USB3.1, ATX, WI-FI AC, s- AM4 |

| 5. | Pamięć RAM | Corsair Vengeance LPX, DDR4 2x16GB, 3000MHz, CL15 black |

| 6. | Pamięć RAM | Crucial Ballistix DDR3, 2x8GB, 1600MHz, CL9, black |

Jak określić długość prefiksu adresu sieci w adresie IPv4?

Po dokonaniu eksportu klucza HKCU stworzona zostanie kopia rejestru zawierająca dane o konfiguracji

Jakie polecenie w systemie Windows służy do zbadania trasy, po jakiej przesyłane są pakiety w sieci?

Jakie oznaczenie powinien mieć komputer, aby mógł zostać sprzedany na terenie Polski, zgodnie z Dyrektywami Rady Europy?

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Przynależność komputera do konkretnej wirtualnej sieci nie może być ustalona na podstawie

W dokumentacji powykonawczej dotyczącej fizycznej i logicznej struktury sieci lokalnej powinien znajdować się

Aby zabezpieczyć system przed atakami typu phishing, nie zaleca się