Pytanie 1

Usługa, umożliwiająca zdalną pracę na komputerze z systemem Windows z innego komputera z systemem Windows, który jest połączony z tą samą siecią lub z Internetem, to

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Usługa, umożliwiająca zdalną pracę na komputerze z systemem Windows z innego komputera z systemem Windows, który jest połączony z tą samą siecią lub z Internetem, to

Aby zasilić najbardziej wydajne karty graficzne, konieczne jest dodatkowe 6-pinowe gniazdo zasilacza PCI-E, które dostarcza napięcia

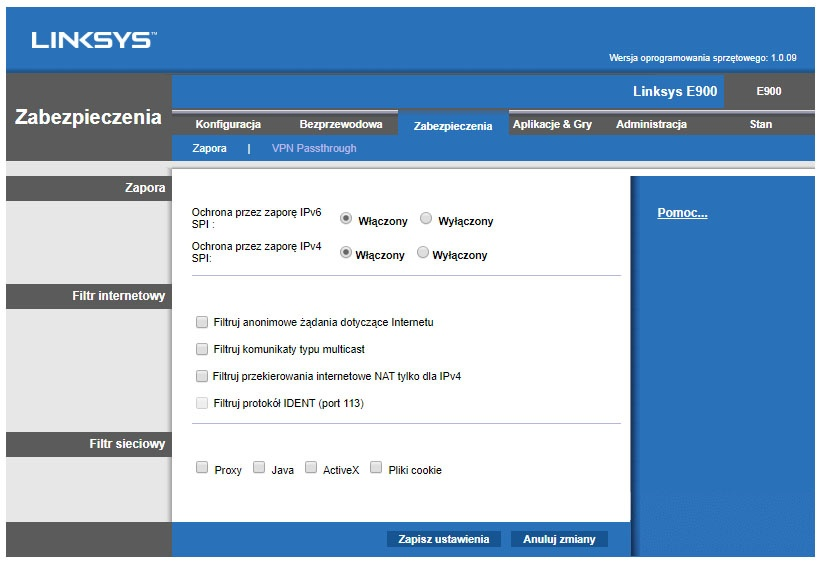

Na ilustracji przedstawiono okno konfiguracji rutera. Wskaż opcję, która wpływa na zabezpieczenie urządzenia przed atakami DDoS.

Sygnatura (ciąg bitów) 55AA (w systemie szesnastkowym) kończy tablicę partycji. Jaka jest odpowiadająca jej wartość w systemie binarnym?

Wykonanie polecenia tar –xf dane.tar w systemie Linux spowoduje

Zamontowany w notebooku trackpoint jest urządzeniem wejściowym reagującym na

Element trwale zainstalowany, w którym znajduje się zakończenie poziomego okablowania strukturalnego abonenta, to

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę haseł oraz stosowanie haseł o odpowiedniej długości, które spełniają kryteria złożoności, należy ustawić

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?

Termin określający zdolność do rozbudowy sieci to

Ile punktów abonenckich (2 x RJ45) powinno być zainstalowanych w biurze o powierzchni 49 m2, zgodnie z normą PN-EN 50167?

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

Atak DDoS (ang. Disributed Denial of Service) na serwer doprowadzi do

Jakie jest główne zadanie systemu DNS w sieci komputerowej?

Które środowisko graficzne przeznaczone dla systemu Linux charakteryzuje się najmniejszymi wymaganiami parametrów pamięci RAM?

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

Komunikat "BIOS checksum error" pojawiający się podczas uruchamiania komputera zazwyczaj wskazuje na

Co jest efektem polecenia ipconfig /release?

W sieciach bezprzewodowych typu Ad-Hoc IBSS (Independent Basic Service Set) wykorzystywana jest topologia fizyczna

Aby zabezpieczyć system przed oprogramowaniem o zdolności do samoreplikacji, należy zainstalować

Jaki system plików powinien być wybrany przy instalacji systemu Linux?

Przynależność komputera do konkretnej wirtualnej sieci nie może być ustalona na podstawie

Standard zwany IEEE 802.11, używany w lokalnych sieciach komputerowych, określa typ sieci:

Jakie urządzenie powinno być użyte, aby poprawić zasięg sieci bezprzewodowej w obiekcie?

Jakie medium transmisyjne używają myszki Bluetooth do interakcji z komputerem?

Jakie wbudowane narzędzie w systemie Windows służy do identyfikowania problemów związanych z animacjami w grach oraz odtwarzaniem filmów?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie polecenie służy do przeprowadzania aktualizacji systemu operacyjnego Linux korzystającego z baz RPM?

Jak nazywa się pamięć podręczną procesora?

Urządzenie, które zamienia otrzymane ramki na sygnały przesyłane w sieci komputerowej, to

Ile maksymalnie dysków twardych można bezpośrednio podłączyć do płyty głównej, której fragment specyfikacji jest przedstawiony w ramce?

|

Program df działający w systemach z rodziny Linux pozwala na wyświetlenie

Który standard z rodziny IEEE 802 odnosi się do sieci bezprzewodowych, zwanych Wireless LAN?

Jednym z rezultatów wykonania poniższego polecenia jest:

sudo passwd -n 1 -x 5 test

Na podstawie zaprezentowanego cennika oblicz, jaki będzie całkowity koszt jednego dwumodułowego podwójnego gniazda abonenckiego montowanego na powierzchni.

| Lp. | Nazwa | j.m. | Cena jednostkowa brutto |

|---|---|---|---|

| 1. | Puszka natynkowa 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 2. | Ramka + suport 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 3. | Adapter 22,5x45 mm do modułu keystone | szt. | 3,00 zł |

| 4. | Moduł keystone RJ45 kategorii 5e | szt. | 7,00 zł |

Zgodnie z normą PN-EN 50173, minimalna liczba punktów rozdzielczych, które należy zainstalować, wynosi

Czym jest dziedziczenie uprawnień?

Administrator powinien podzielić sieć o adresie 193.115.95.0 z maską 255.255.255.0 na 8 równych podsieci. Jaką maskę sieci powinien wybrać administrator?

Jaką metodę stosuje się do dostępu do medium transmisyjnego z wykrywaniem kolizji w sieciach LAN?

Aby naprawić uszkodzony sektor rozruchowy dysku w systemie Windows 7, należy użyć polecenia