Pytanie 1

Który z poniższych programów nie służy do diagnozowania sieci komputerowej w celu wykrywania problemów?

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Który z poniższych programów nie służy do diagnozowania sieci komputerowej w celu wykrywania problemów?

W systemie Windows mechanizm ostrzegający przed uruchamianiem nieznanych aplikacji oraz plików pobranych z Internetu funkcjonuje dzięki

W metodzie archiwizacji danych nazwanej Dziadek – Ojciec – Syn na poziomie Dziadek przeprowadza się kopię danych na koniec

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

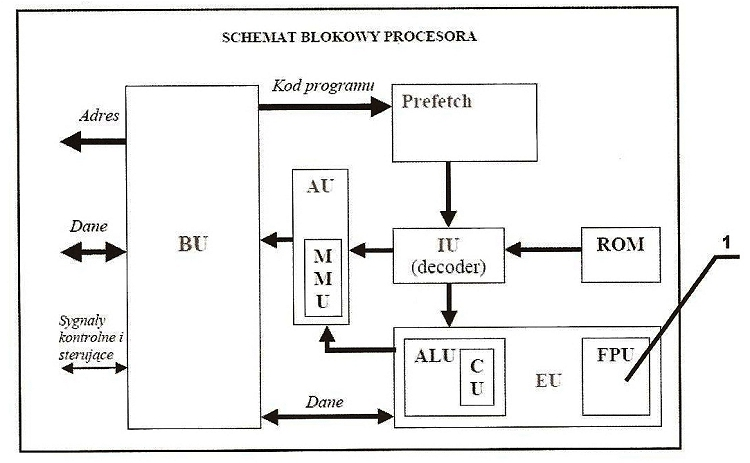

Element oznaczony numerem 1 w schemacie blokowym procesora pełni funkcję

Klient dostarczył wadliwy sprzęt komputerowy do serwisu. W trakcie procedury przyjmowania sprzętu, ale przed rozpoczęciem jego naprawy, serwisant powinien

Podaj poprawną sekwencję czynności, które należy wykonać, aby przygotować nowy laptop do użycia.

Prawo osobiste twórcy do oprogramowania komputerowego

Liczba FAFC w systemie heksadecymalnym odpowiada wartości liczbowej

Jaką maksymalną prędkość danych można osiągnąć w sieci korzystającej z skrętki kategorii 5e?

Który z podanych adresów IPv4 należy do kategorii B?

Jakie polecenie w systemie operacyjnym Windows służy do wyświetlenia konfiguracji interfejsów sieciowych?

Matryce monitorów typu charakteryzują się najmniejszymi kątami widzenia

Jakie polecenie w systemach z rodziny Windows Server umożliwia administratorowi przekierowanie komputerów do określonej jednostki organizacyjnej w ramach usług katalogowych?

Które medium transmisyjne charakteryzuje się najmniejszym ryzykiem narażenia na zakłócenia elektromagnetyczne przesyłanego sygnału?

Jakie polecenie powinien zastosować użytkownik systemu Linux, aby wydobyć zawartość archiwum o nazwie dane.tar?

Jakie polecenie w systemie Linux jest potrzebne do stworzenia archiwum danych?

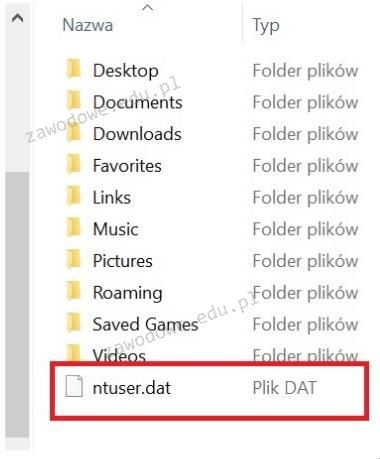

Aby zmienić profil na obowiązkowy, trzeba zmodyfikować rozszerzenie pliku ntuser.dat na

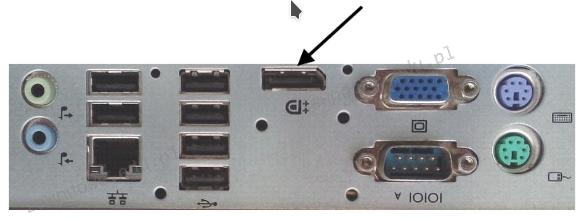

Na ilustracji ukazany jest tylny panel stacji roboczej. Strzałką wskazano port

Jakim skrótem określa się połączenia typu punkt-punkt w ramach publicznej infrastruktury telekomunikacyjnej?

Do pomiaru wartości mocy pobieranej przez zestaw komputerowy służy

Który z protokołów pełni rolę protokołu połączeniowego?

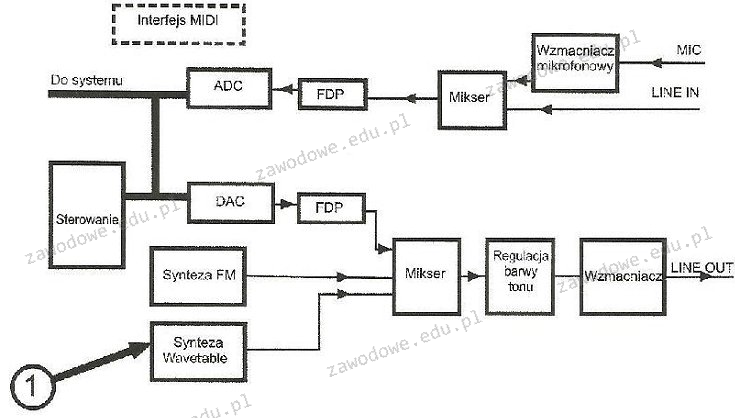

Element wskazany cyfrą 1 na diagramie karty dźwiękowej?

Aby zabezpieczyć system przed atakami z sieci nazywanymi phishingiem, nie powinno się

Z jaką minimalną efektywną częstotliwością taktowania mogą działać pamięci DDR2?

Który z wymienionych adresów stanowi adres hosta w obrębie sieci 10.128.0.0/10?

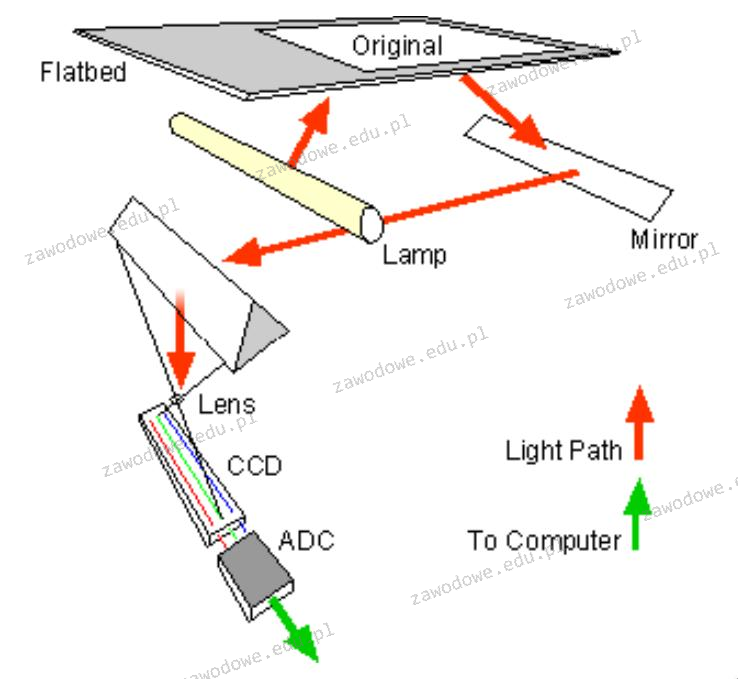

Ilustrowany schemat obrazuje zasadę funkcjonowania

Jakie narzędzie służy do połączenia pigtaila z włóknami światłowodowymi?

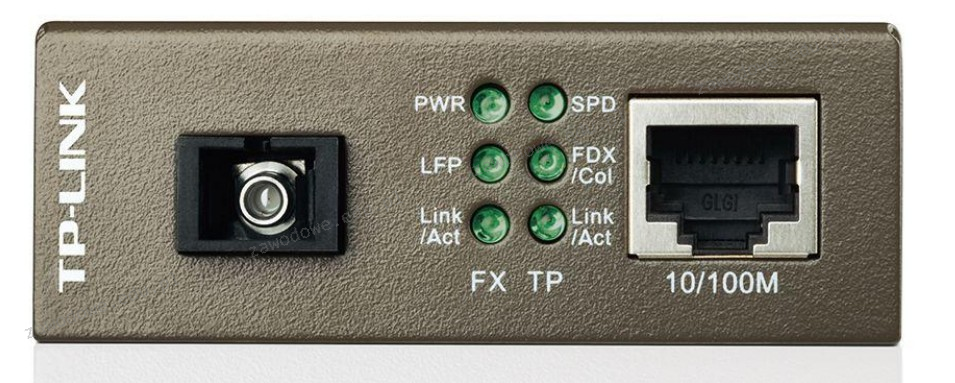

Urządzenie pokazane na grafice służy do

Aby uruchomić monitor wydajności oraz niezawodności w systemie Windows, należy skorzystać z przystawki

Jakie urządzenie sieciowe reprezentuje ten symbol graficzny?

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w

Jednym z czynników, dla których zapis na dysku SSD jest szybszy niż na dysku HDD, jest

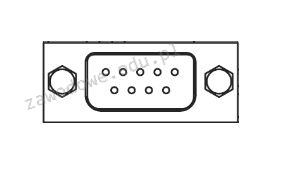

Obrazek ilustruje rodzaj złącza

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

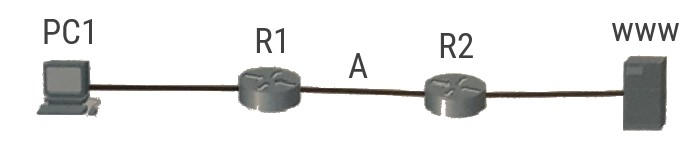

Ramka danych przesyłanych z komputera PC1 do serwera www znajduje się pomiędzy ruterem R1 a ruterem R2 (punkt A). Jakie adresy są w niej zawarte?

Jaka jest maksymalna liczba hostów, które można przypisać w sieci o adresie IP klasy B?

Oprogramowanie, które regularnie przerywa działanie przez pokazanie komunikatu o konieczności uiszczenia opłaty, co prowadzi do zniknięcia tego komunikatu, jest dystrybuowane na podstawie licencji

Norma PN-EN 50173 rekomenduje montaż przynajmniej

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o: