Pytanie 1

W topologii elementem centralnym jest switch

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

W topologii elementem centralnym jest switch

Rysunek obrazuje zasadę działania drukarki

Jakie urządzenie sieciowe zostało pokazane na ilustracji?

Narzędzie służące do oceny wydajności systemu komputerowego to

Jaką czynność można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, bez przechodzenia do trybu uprzywilejowanego, na poziomie dostępu widocznym w powyższej ramce?

Ile hostów można zaadresować w sieci o adresie 172.16.3.96/28?

Aby skopiować folder c:\test wraz ze wszystkimi podfolderami na przenośny dysk f:\ w systemie Windows 7, jakie polecenie należy zastosować?

Włączenie systemu Windows w trybie debugowania umożliwia

Co oznacza zapis 192.168.1/24 w kontekście maski podsieci?

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

W systemach Windows XP Pro/ Windows Vista Bizness/Windows 7 Pro/Windows 8 Pro, rozwiązaniem zapewniającym poufność danych dla użytkowników korzystających z jednego komputera, których informacje mogą być wykorzystywane wyłącznie przez nich, jest

Jakie polecenie należy wykorzystać w systemie Linux, aby zlokalizować wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i mają w nazwie ciąg znaków abc?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jak nazywa się protokół używany do przesyłania wiadomości e-mail?

Który z poniższych protokołów jest wykorzystywany do uzyskiwania dynamicznych adresów IP?

Aby zminimalizować wpływ zakłóceń elektromagnetycznych na przesyłany sygnał w tworzonej sieci komputerowej, jakie rozwiązanie należy zastosować?

Jaki rodzaj portu może być wykorzystany do podłączenia zewnętrznego dysku do laptopa?

Jaką normę wykorzystuje się przy okablowaniu strukturalnym w komputerowych sieciach?

W nagłówku ramki standardu IEEE 802.3 w warstwie łącza danych znajduje się

Sprzęt, który umożliwia konfigurację sieci VLAN, to

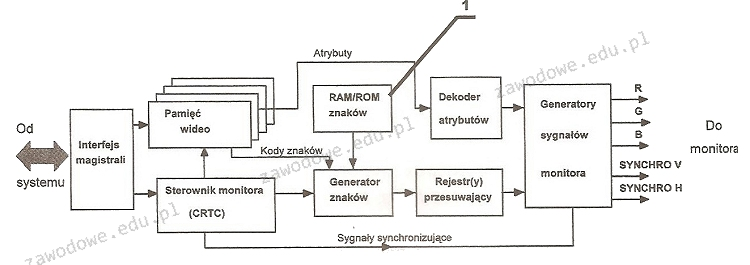

Element oznaczony cyfrą 1 na diagramie blokowym karty graficznej?

Na stronie wydrukowanej przez drukarkę laserową występują jaśniejsze i ciemniejsze fragmenty. W celu usunięcia problemów z jakością oraz nieciągłościami w wydruku, należy

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie

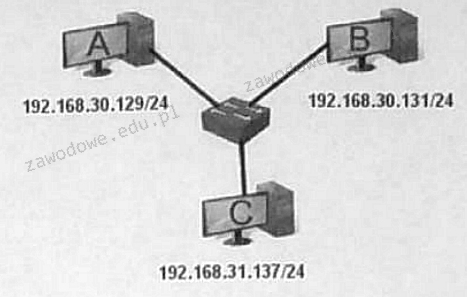

Hosty A i B nie są w stanie nawiązać komunikacji z hostem C. Między hostami A i B wszystko działa poprawnie. Jakie mogą być powody, dla których hosty A i C oraz B i C nie mogą się komunikować?

Urządzenie przedstawione na obrazie jest przeznaczone do

Impulsator pozwala na diagnozowanie uszkodzonych układów logicznych komputera między innymi poprzez

Usługa, umożliwiająca zdalną pracę na komputerze z systemem Windows z innego komputera z systemem Windows, który jest połączony z tą samą siecią lub z Internetem, to

W skład sieci komputerowej wchodzą 3 komputery stacjonarne oraz drukarka sieciowa, połączone kablem UTP z routerem mającym 1 x WAN oraz 5 x LAN. Które z urządzeń sieciowych pozwoli na podłączenie dodatkowych dwóch komputerów do tej sieci za pomocą kabla UTP?

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Na komputerze klienckim z systemem Windows XP plik "hosts" to plik tekstowy, który wykorzystywany jest do przypisywania

Adres IP 192.168.2.0/24 został podzielony na 8 podsieci. Jaką maskę należy zastosować dla tych nowych podsieci?

Jak w systemie Windows Professional można ustalić czas działania drukarki oraz jej uprawnienia do drukowania?

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

Jakie zadanie pełni router?

Jaki skrót odpowiada poniższej masce podsieci: 255.255.248.0?

Na podstawie specyfikacji płyty głównej przedstawionej w tabeli, wskaż największą liczbę kart rozszerzeń, które mogą być podłączone do magistrali Peripheral Component Interconnect?

| BIOS Type | AWARD |

| BIOS Version | 1.8 |

| Memory Sockets | 3 |

| Expansion Slots | 1 AGP/5 PCI |

| AGP 8X | Yes |

| AGP Pro | No |

| NorthbridgeCooling Fan | Yes |

| Northbridge | nForce2 SPP |

| Southbridge | nForce2 MCP-T |

| FSB Speeds | 100-300 1 MHz |

| MultiplierSelection | Yes – BIOS |

| CoreVoltages | 1.1V-2.3V |

| DDR Voltages | 2.5V-2.9V |

| AGP Voltages | 1.5V-1.8V |

| Chipset Voltages | 1.4V-1.7V |

| AGP/PCI Divider in BIOS | Yes (AGP) |

Jaki port na tylnym panelu płyty głównej jest w dokumentacji określany jako port zgodny z normą RS232C?

Jaką maksymalną ilość GB pamięci RAM może obsłużyć 32-bitowa edycja systemu Windows?