Pytanie 1

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

Zainstalowanie w komputerze wskazanej karty pozwoli na

Uruchomienie systemu Windows w trybie debugowania pozwala na

Jakiego protokołu używa polecenie ping?

Aby chronić systemy sieciowe przed atakami z zewnątrz, należy zastosować

W nowoczesnych ekranach dotykowych działanie ekranu jest zapewniane przez mechanizm, który wykrywa zmianę

Wykonując w konsoli systemu Windows Server komendę convert, co można zrealizować?

Które z urządzeń nie powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Aby zminimalizować wpływ zakłóceń elektromagnetycznych na przesyłany sygnał w tworzonej sieci komputerowej, jakie rozwiązanie należy zastosować?

Jakie polecenie w systemie Windows pozwala na zmianę zarówno nazwy pliku, jak i jego lokalizacji?

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

Liczba 10011001100 zaprezentowana w systemie heksadecymalnym ma formę

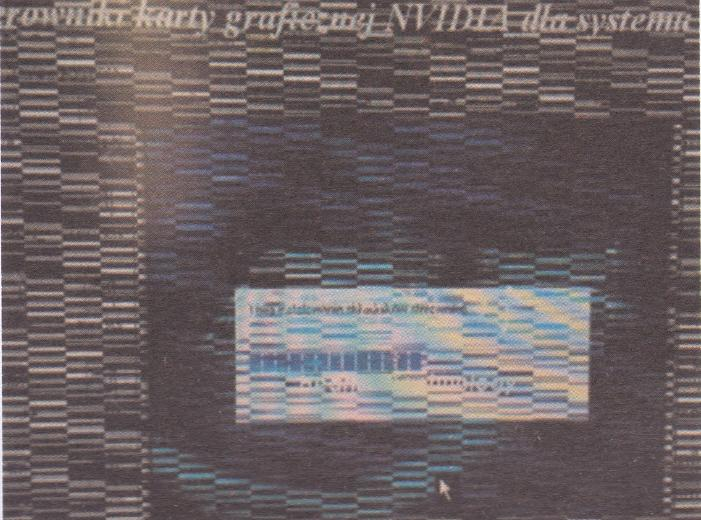

Jakie jest usytuowanie przewodów w złączu RJ45 według schematu T568A?

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Jakie oprogramowanie do wirtualizacji jest dostępne jako rola w systemie Windows Server 2012?

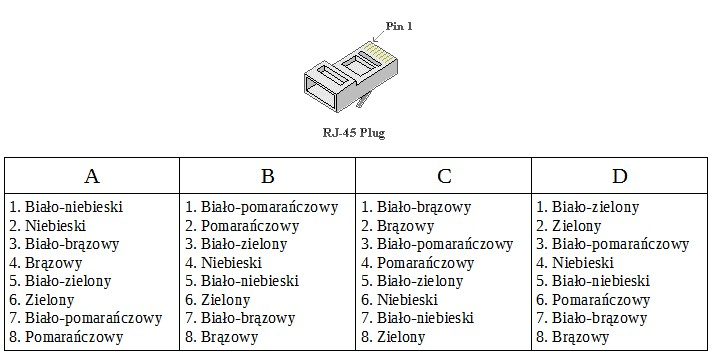

Głównie które aktualizacje zostaną zainstalowane po kliknięciu na przycisk OK prezentowany na zrzucie ekranu?

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

Jak wygląda liczba 257 w systemie dziesiętnym?

W dokumentacji jednego z komponentów komputera zamieszczono informację, że to urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

Jakie jest adres rozgłoszeniowy sieci, w której funkcjonuje host z adresem IP 195.120.252.32 oraz maską podsieci 255.255.255.192?

Liczba BACA zapisana w systemie szesnastkowym odpowiada liczbie

Podczas tworzenia sieci kablowej o maksymalnej prędkości przesyłu danych wynoszącej 1 Gb/s, w której maksymalna odległość między punktami sieci nie przekracza 100 m, należy zastosować jako medium transmisyjne

W którym katalogu w systemie Linux można znaleźć pliki zawierające dane o urządzeniach zainstalowanych w komputerze, na przykład pamięci RAM?

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz maską 26 bitową?

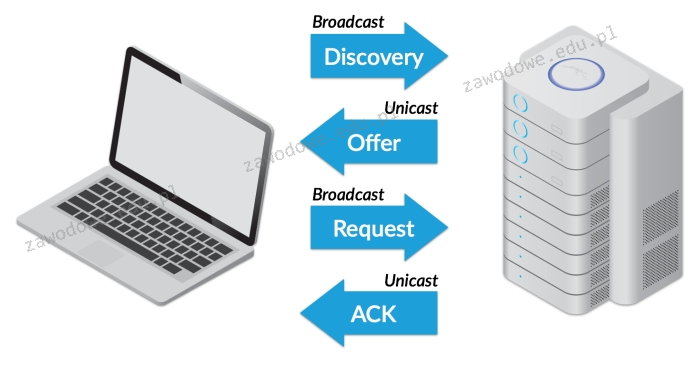

Którego protokołu działanie zostało zaprezentowane na diagramie?

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Jaką liczbę bitów posiada adres logiczny IPv6?

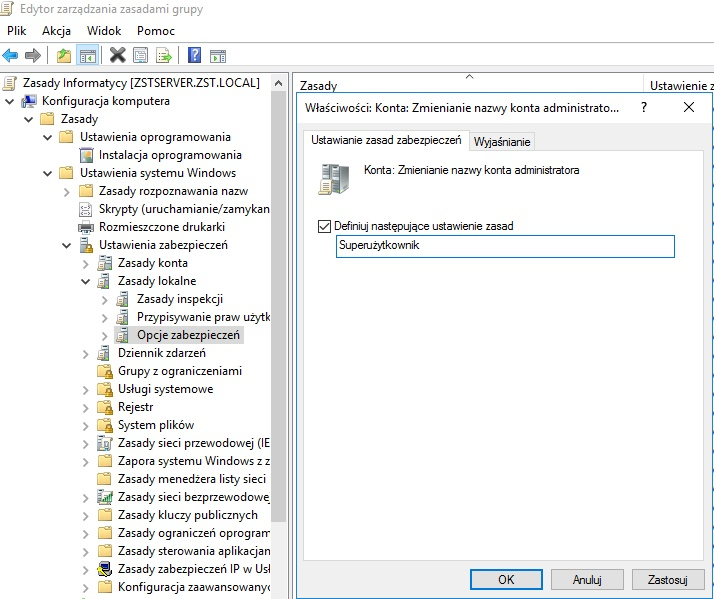

Rezultatem działania przedstawionego na ilustracji okna jest

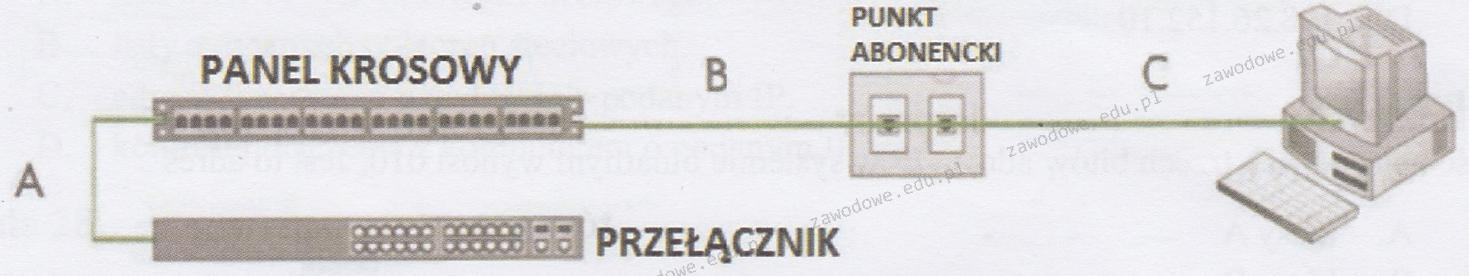

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

W specyfikacji IEEE 802.3af opisano technologię dostarczania energii elektrycznej do różnych urządzeń sieciowych jako

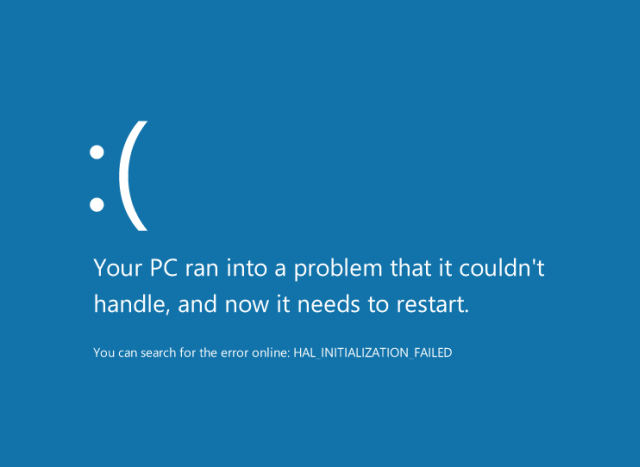

Zamieszczony komunikat tekstowy wyświetlony na ekranie komputera z zainstalowanym systemem Windows wskazuje na

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Interfejs UDMA to interfejs

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 jest zapisany w formacie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Które z poniższych poleceń służy do naprawienia głównego rekordu rozruchowego dysku twardego w systemie Windows?

Norma EN 50167 odnosi się do rodzaju okablowania

Aby poprawić organizację plików na dysku i przyspieszyć działanie systemu, co należy zrobić?