Pytanie 1

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem

Przedstawiony skaner należy podłączyć do komputera przy użyciu złącza

Aby powiększyć lub zmniejszyć rozmiar ikony na pulpicie, trzeba obracać rolką myszki, trzymając jednocześnie klawisz

W którym modelu płyty głównej można zamontować procesor o podanych parametrach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

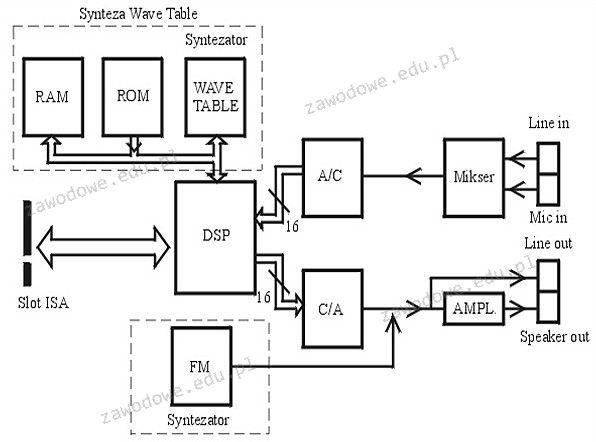

Na ilustracji zaprezentowano schemat działania

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

Jak określa się technologię stworzoną przez firmę NVIDIA, która pozwala na łączenie kart graficznych?

Liczba 10011001100 w systemie heksadecymalnym przedstawia się jako

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosowany jest mechanizm

Program, który nie jest przeznaczony do analizy stanu komputera to

Zamianę uszkodzonych kondensatorów w karcie graficznej umożliwi

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Zidentyfikuj najprawdopodobniejszą przyczynę pojawienia się komunikatu "CMOS checksum error press F1 to continue press DEL to setup" podczas uruchamiania systemu komputerowego?

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Komputer, którego naprawa ma zostać przeprowadzona u klienta, nie reaguje na wciśnięcie przycisku POWER. Pierwszą czynnością harmonogramu prac związanych z lokalizacją i usunięciem tej usterki powinno być

Jakie znaczenie ma skrót MBR w kontekście technologii komputerowej?

W nowoczesnych ekranach dotykowych działanie ekranu jest zapewniane przez mechanizm, który wykrywa zmianę

Watomierz jest stosowany do pomiaru

Główny protokół stosowany do ustalania ścieżki i przesyłania nią pakietów danych w sieci komputerowej to

Diody LED RGB pełnią funkcję źródła światła w skanerach

Jakim modułem pamięci RAM, który jest zgodny z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/8xDDR4 2133, ECC, maksymalnie 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć?

Drukarka, która zapewnia zdjęcia o wysokiej jakości to drukarka

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Które medium transmisyjne umożliwia izolację galwaniczną pomiędzy systemami przesyłu danych?

Drukarka do zdjęć ma mocno zabrudzoną obudowę oraz ekran. Aby oczyścić zanieczyszczenia bez ryzyka ich uszkodzenia, należy zastosować

Jaką wartość dziesiętną ma liczba FF w systemie szesnastkowym?

Typowym objawem wskazującym na zbliżającą się awarię dysku twardego jest pojawienie się

Klawiatura QWERTY, która pozwala na wprowadzanie znaków typowych dla języka polskiego, nazywana jest także klawiaturą

Co umożliwia zachowanie równomiernego rozkładu ciepła pomiędzy procesorem a radiatorem?

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

W biurowcu należy podłączyć komputer do routera ADSL za pomocą przewodu UTP Cat 5e. Jaka powinna być maksymalna odległość między komputerem a routerem?

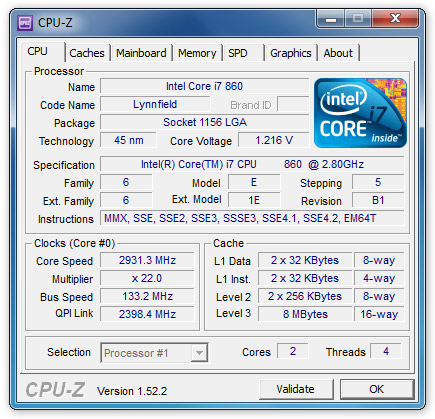

W dokumentacji technicznej procesora producent umieścił wyniki testu, który został wykonany przy użyciu programu CPU-Z. Z tych danych wynika, że procesor dysponuje

Oblicz całkowity koszt kabla UTP Cat 6, który będzie użyty do połączenia 5 punktów abonenckich z punktem dystrybucji, mając na uwadze, że średnia odległość pomiędzy każdym punktem abonenckim a punktem dystrybucji wynosi 8 m oraz że cena za 1 m kabla wynosi 1 zł. W obliczeniach uwzględnij zapas 2 m kabla na każdy punkt abonencki.

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

W czterech różnych sklepach dostępny jest ten sam komputer w odmiennych cenach. Gdzie można go kupić najtaniej?

| Sklep | Cena netto | Podatek | Informacje dodatkowe |

|---|---|---|---|

| A. | 1500 zł | 23% | Rabat 5% |

| B. | 1600 zł | 23% | Rabat 15% |

| C. | 1650 zł | 23% | Rabat 20% |

| D. | 1800 zł | 23% | Rabat 25 % |

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

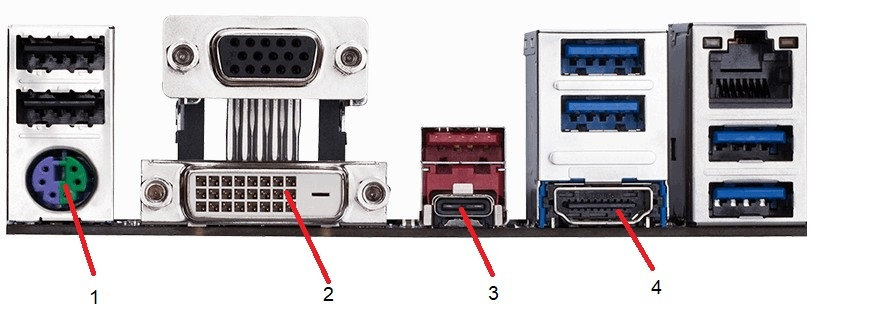

Urządzenie peryferyjne z interfejsem Mini-DIN podłącza się do gniazda oznaczonego na ilustracji

Karta rozszerzeń przedstawiona na zdjęciu dysponuje systemem chłodzenia

Aby podłączyć dysk z interfejsem SAS, konieczne jest użycie kabla przedstawionego na ilustracji