Pytanie 1

Martwy piksel, który jest defektem w monitorach LCD, to punkt, który ciągle ma ten sam kolor

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Martwy piksel, który jest defektem w monitorach LCD, to punkt, który ciągle ma ten sam kolor

Który kolor żyły nie występuje w kablu typu skrętka?

Zasady dotyczące filtracji ruchu w firewallu są ustalane w postaci

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wskaż interfejsy płyty głównej widoczne na rysunku.

Na wydrukach uzyskanych z drukarki laserowej można zauważyć pasma wzdłużne oraz powtarzające się defekty. Jedną z możliwych przyczyn niskiej jakości druku jest wada

Zgodnie z normą PN-EN 50174, okablowanie poziome w systemie okablowania strukturalnego to segment okablowania pomiędzy

Jak w systemie Windows Professional można ustalić czas działania drukarki oraz jej uprawnienia do drukowania?

Komunikat tekstowy KB/Interface error, wyświetlony na ekranie komputera z BIOS POST firmy AMI, informuje o błędzie

Jakie polecenie diagnostyczne powinno się użyć, aby uzyskać informacje na temat tego, czy miejsce docelowe odpowiada oraz po jakim czasie nastąpiła odpowiedź?

Firma uzyskała zakres adresów 10.10.10.0/16. Po podzieleniu na podsieci zawierające 510 hostów, jakie są adresy podsieci z zastosowaną maską?

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo brudne. Jakie środki należy zastosować, aby je wyczyścić?

Aby komputery mogły udostępniać dane w sieci, NIE powinny mieć tych samych

Kondygnacyjny punkt dystrybucyjny jest połączony za pomocą poziomego okablowania z

W systemie Linux użycie polecenia passwd Ala spowoduje

Jakie jest najbardziej typowe dla topologii gwiazdy?

Jaki jest adres broadcastowy dla sieci posiadającej adres IP 192.168.10.0/24?

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

Która z wymienionych czynności konserwacyjnych drukarek dotyczy tylko drukarki laserowej?

Wartość liczby BACA w systemie heksadecymalnym to liczba

Awaria drukarki igłowej może być spowodowana uszkodzeniem

Aby serwer mógł przesyłać dane w zakresach częstotliwości 2,4 GHz oraz 5 GHz, konieczne jest zainstalowanie w nim karty sieciowej działającej w standardzie

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Fast Ethernet to norma sieci przewodowej, która pozwala na przesył danych z maksymalną szybkością

Z powodu uszkodzenia kabla typu skrętka utracono dostęp między przełącznikiem a stacją roboczą. Który instrument pomiarowy powinno się wykorzystać, aby zidentyfikować i naprawić problem bez wymiany całego kabla?

W dokumentacji technicznej procesora znajdującego się na płycie głównej komputera, jaką jednostkę miary stosuje się do określenia szybkości zegara?

W tabeli przedstawiono dane katalogowe procesora AMD Athlon 1333 Model 4 Thunderbird. Jaka jest częstotliwość przesyłania danych między rejestrami?

| General information | |

|---|---|

| Type | CPU / Microprocessor |

| Market segment | Desktop |

| Family | AMD Athlon |

| CPU part number | A1333AMS3C |

| Stepping codes | AYHJA AYHJAR |

| Frequency (MHz) | 1333 |

| Bus speed (MHz) | 266 |

| Clock multiplier | 10 |

| Gniazdo | Socket A (Socket 462) |

| Notes on AMD A1333AMS3C | |

| ○ Actual bus frequency is 133 MHz. Because the processor uses Double Data Rate bus the effective bus speed is 266 MHz. | |

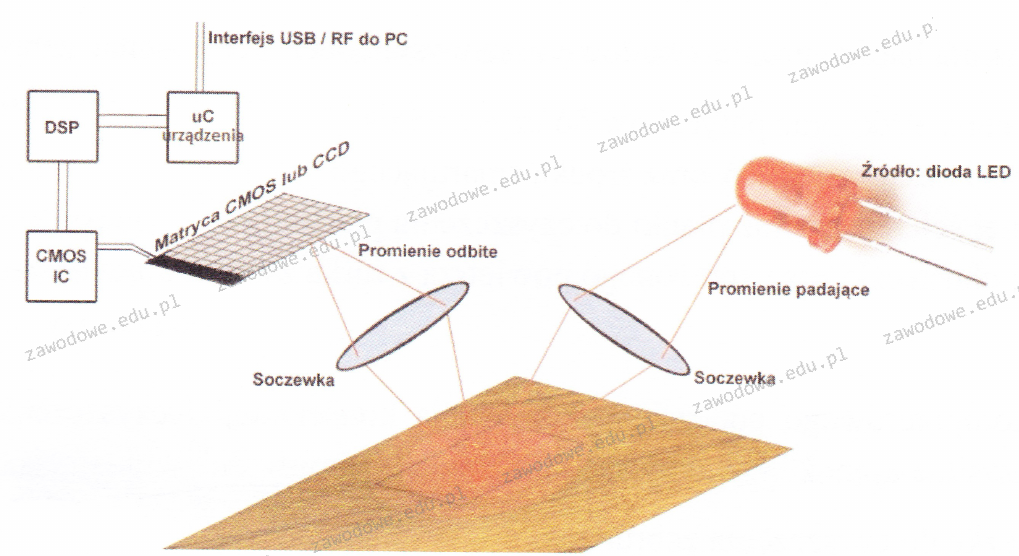

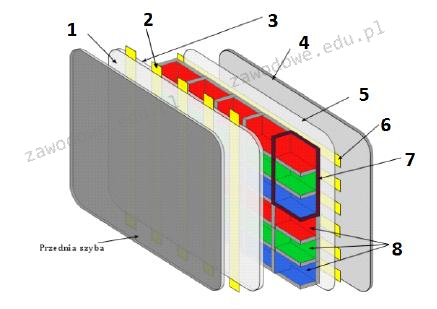

Zilustrowany schemat przedstawia zasadę funkcjonowania

Aplikacją systemu Windows, która umożliwia analizę wpływu różnych procesów i usług na wydajność CPU oraz oceny stopnia obciążenia pamięci i dysku, jest

Która z licencji na oprogramowanie wiąże je trwale z zakupionym komputerem i nie pozwala na przenoszenie praw użytkowania programu na inny komputer?

Na urządzeniu znajduje się symbol, który stanowi certyfikat potwierdzający zgodność sprzętu w zakresie emisji promieniowania, ergonomii, efektywności energetycznej oraz ekologii, co przedstawiono na rysunku

Jaką maksymalną długość może mieć kabel miedziany UTP kategorii 5e łączący bezpośrednio dwa urządzenia w sieci, według standardu Fast Ethernet 100Base-TX?

Które cechy ma licencja bezpłatnego oprogramowania zwana freemium?

Drukarka fotograficzna ma bardzo brudną obudowę oraz wyświetlacz. Aby usunąć zabrudzenia bez ich uszkodzenia, należy użyć

W systemie Windows aktualne ustawienia użytkownika komputera przechowywane są w gałęzi rejestru o skrócie

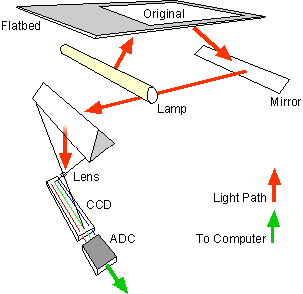

Przedstawiony schemat przedstawia zasadę działania

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego numer 6 zaznaczono

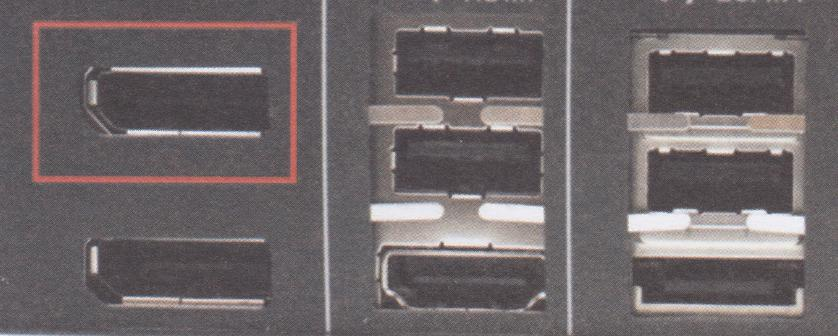

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs