Pytanie 1

Port AGP służy do łączenia

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Port AGP służy do łączenia

Aby podłączyć kasę fiskalną wyposażoną w złącze komunikacyjne DB-9M do komputera stacjonarnego, należy zastosować przewód

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

Karta dźwiękowa, która może odtworzyć plik w formacie MP3, powinna być zaopatrzona w układ

W systemie Linux, gdzie przechowywane są hasła użytkowników?

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Program do odzyskiwania danych, stosowany w warunkach domowych, umożliwia przywrócenie danych z dysku twardego w sytuacji

Określenie najbardziej efektywnej trasy dla połączenia w sieci to

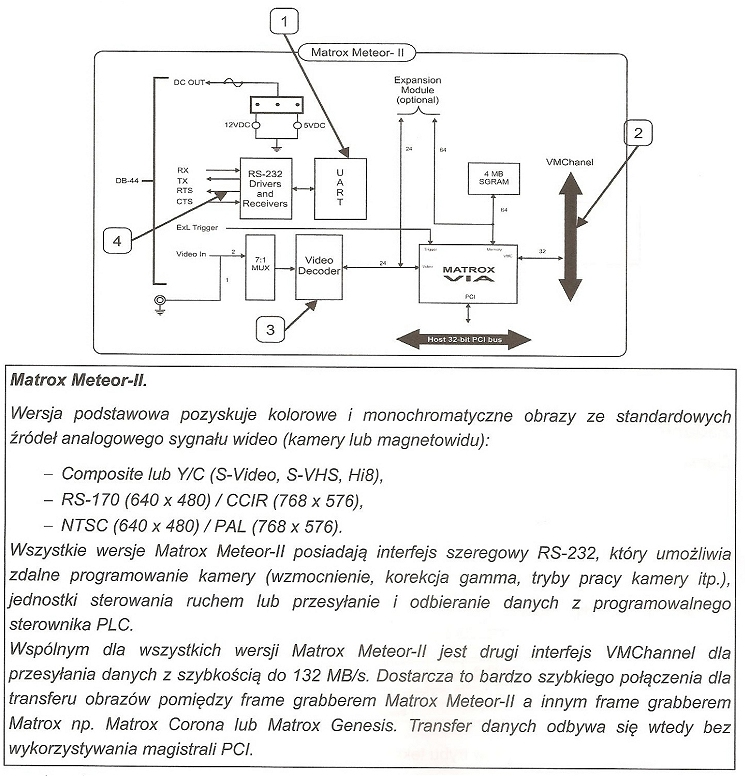

Który z elementów oznaczonych numerami od 1 do 4, ukazanych na schemacie blokowym frame grabbera oraz opisanych w fragmencie dokumentacji technicznej, jest odpowiedzialny za wymianę danych z innymi urządzeniami przetwarzającymi obraz wideo, unikając zbędnego obciążenia magistrali PCI?

Która usługa pozwala na zdalne zainstalowanie systemu operacyjnego?

Urządzenie używane do zestawienia 6 komputerów w sieci lokalnej to:

Jakie urządzenie powinno być wykorzystane do pomiaru mapy połączeń w okablowaniu strukturalnym sieci lokalnej?

Komputer K1 jest podłączony do interfejsu G0 routera, a komputer K2 do interfejsu G1 tego samego routera. Na podstawie przedstawionej w tabeli adresacji ustal prawidłowy adres bramy komputera K2.

Interfejs Adres IP Maska

G0 172.16.0.1 255.255.0.0

G1 192.168.0.1 255.255.255.0

Ilustracja przedstawia rodzaj pamięci

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Określ zakres adresów IP z klasy A, który wykorzystywany jest do adresacji prywatnej w sieciach komputerowych?

Jakie jest IPv4 urządzenia znajdującego się w sieci 10.100.0.0/18?

W dokumentacji jednego z komponentów komputera zawarto informację, że urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

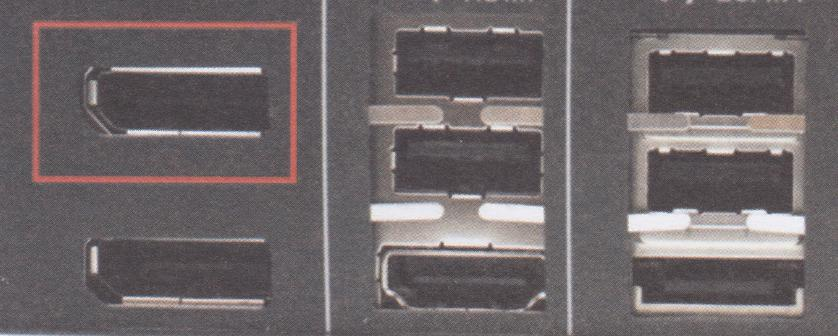

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

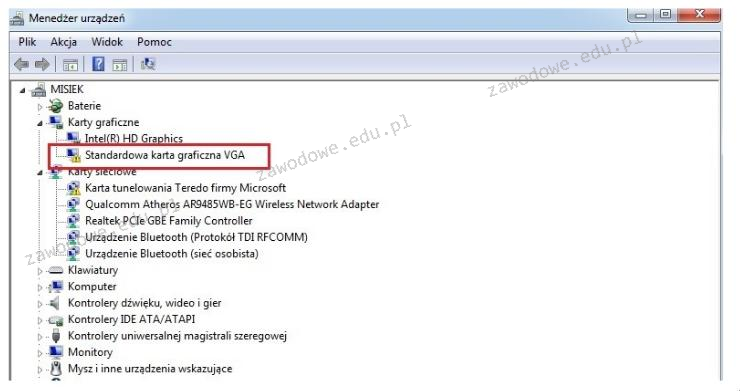

W dokumentacji technicznej procesora Intel Xeon Processor E3-1220, producent przedstawia następujące dane: # rdzeni: 4 # wątków: 4 Częstotliwość zegara: 3.1 GHz Maksymalna częstotliwość Turbo: 3.4 GHz Intel Smart Cache: 8 MB DMI: 5 GT/s Zestaw instrukcji: 64 bit Rozszerzenia zestawu instrukcji: SSE4.1/4.2, AVX Opcje wbudowane: Nie Litografia: 32 nm Maksymalne TDP: 80 W. Co to oznacza dla Menedżera zadań systemu Windows, jeśli chodzi o historię użycia?

| # of Cores: | 4 |

| # of Threads: | 4 |

| Clock Speed: | 3.1 GHz |

| Max Turbo Frequency: | 3.4 GHz |

| Intel® Smart Cache: | 8 MB |

| DMI: | 5 GT/s |

| Instruction Set: | 64-bit |

| Instruction Set Extensions: | SSE4.1/4.2, AVX |

| Embedded Options Available: | No |

| Lithography: | 32 nm |

| Max TDP: | 80 W |

W interfejsie graficznym systemów Ubuntu lub SuSE Linux, aby zainstalować aktualizacje programów systemowych, można zastosować aplikacje

Które z poniższych poleceń w Windows wyświetla adresy IP interfejsów sieciowych?

Oświetlenie oparte na diodach LED w trzech kolorach wykorzystuje skanery typu

Na płycie głównej doszło do awarii zintegrowanej karty sieciowej. Komputer nie ma dysku twardego ani innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w sieci firmowej komputery nie mają napędów, a wszystko "czyta" się z serwera. Aby przywrócić utraconą funkcjonalność, należy zainstalować

Jakie czynności nie są realizowane przez system operacyjny?

Jakie polecenie w systemach Windows/Linux jest zazwyczaj wykorzystywane do monitorowania trasy pakietów w sieciach IP?

W systemie Windows zastosowanie zaprezentowanego polecenia spowoduje chwilową modyfikację koloru

Microsoft Windows [Version 10.0.14393] (c) 2016 Microsoft Corporation. Wszelkie prawa zastrzeżone. C:\Users\ak>color 1

W systemie Linux komendą, która jednocześnie podnosi uprawnienia dla procesu uruchamianego z terminala, jest

Na ilustracji widoczny jest komunikat systemowy. Jaką czynność powinien wykonać użytkownik, aby naprawić występujący błąd?

Jednym z typowych symptomów mogących świadczyć o nadchodzącej awarii dysku twardego jest wystąpienie

Wykonanie polecenia perfmon w terminalu systemu Windows spowoduje

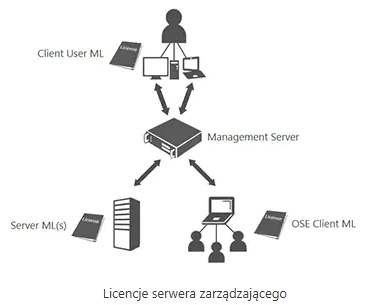

Wskaż model licencjonowania serwera zarządzającego (Management Serwer), oferowanego firmom przez Microsoft, którego schemat przedstawiono na ilustracji.

Adres IP jest przypisywany przełącznikowi warstwy drugiej w celu

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

Jaką funkcję pełni serwer ISA w systemie Windows?

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

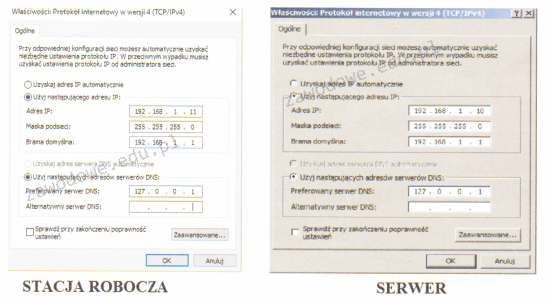

Na rysunku widać ustawienia protokołu TCP/IP serwera oraz komputera roboczego. Na serwerze działa rola serwera DNS. Wykonanie polecenia ping www.cke.edu.pl na serwerze zwraca wynik pozytywny, natomiast na stacji roboczej wynik jest negatywny. Co należy zmienić, aby usługa DNS na stacji pracowała poprawnie?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?