Pytanie 1

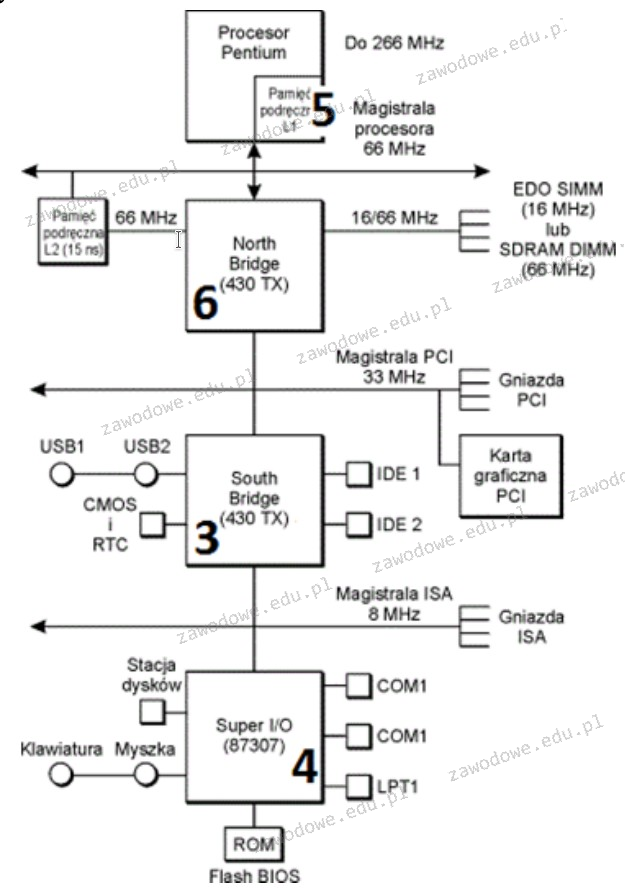

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Jak nazywa się protokół, który pozwala na ściąganie wiadomości e-mail z serwera?

Jaki system operacyjny funkcjonuje w trybie tekstowym i umożliwia uruchomienie środowiska graficznego KDE?

Jaką konfigurację sieciową może mieć komputer, który należy do tej samej sieci LAN, co komputer z adresem 10.8.1.10/24?

Złącze SC powinno być zainstalowane na przewodzie

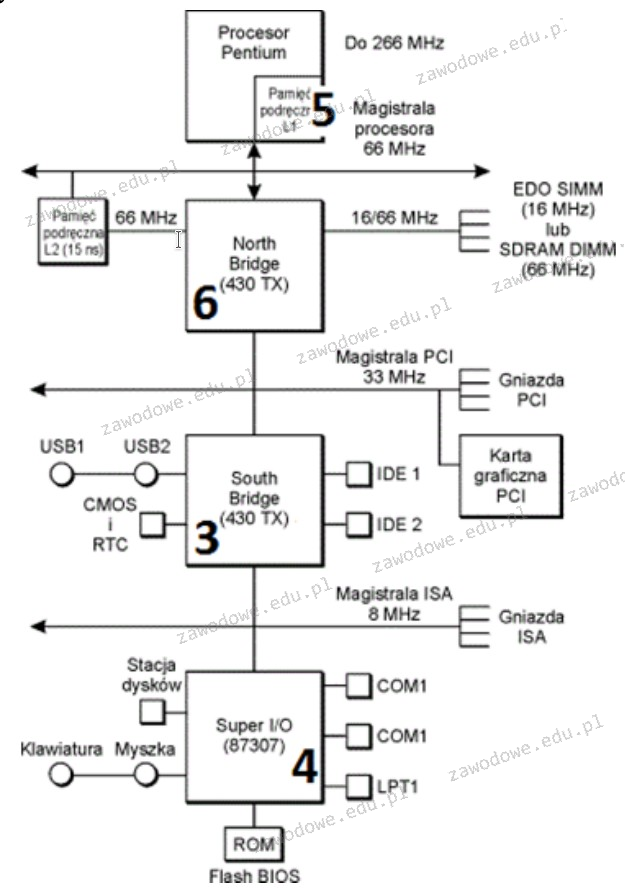

W którym systemie liczbowym zapisano zakresy We/Wy przedstawione na ilustracji?

Na podstawie danych zawartych w tabeli dotyczącej specyfikacji płyty głównej, wskaż maksymalną liczbę kart rozszerzeń, które można zainstalować w magistrali Peripheral Component Interconnect.

W systemie Linux program, który odpowiada aplikacji chkdsk z Windows, to

Pozyskiwanie materiałów z odpadów w celu ich ponownego użycia to

Mechanizm, który pozwala na podłączenie urządzeń peryferyjnych do systemu komputerowego, w którym każde urządzenie jest identyfikowane przez przypisany mu numer, to

Serwer DNS pełni rolę

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

Wskaż zewnętrzny protokół rutingu?

Bęben działający na zasadzie reakcji fotochemicznych jest wykorzystywany w drukarkach

System operacyjny został poddany atakowi przez oprogramowanie szpiegujące. Po usunięciu problemów, aby zapobiec przyszłym atakom, należy

Wymianę uszkodzonych kondensatorów karty graficznej umożliwi

Polecenie Gpresult

Dokumentacja końcowa dla planowanej sieci LAN powinna między innymi zawierać

W trakcie normalnego funkcjonowania systemu operacyjnego w laptopie zjawia się informacja o potrzebie sformatowania wewnętrznego dysku twardego. Co to oznacza?

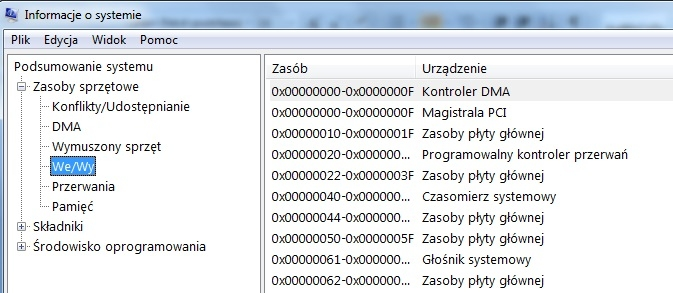

Na ilustracji przedstawiono schemat konstrukcji logicznej

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

W lokalnej sieci uruchomiono serwer odpowiedzialny za przydzielanie dynamicznych adresów IP. Jaką usługę należy aktywować na tym serwerze?

Aby podczas prac montażowych zabezpieczyć szczególnie wrażliwe podzespoły elektroniczne komputera przed wyładowaniem elektrostatycznym, należy stosować

Urządzenie peryferyjne, które jest kontrolowane przez komputer i wykorzystywane do obsługi dużych, płaskich powierzchni, a do produkcji druków odpornych na czynniki zewnętrzne używa farb rozpuszczalnikowych, to ploter

Po zainstalowaniu z domyślnymi uprawnieniami, system Windows XP nie obsługuje formatu systemu plików

Jaki jest standardowy port dla serwera HTTP?

Do przeprowadzenia ręcznej konfiguracji interfejsu sieciowego w systemie Linux konieczne jest użycie polecenia

Jak brzmi nazwa klucza rejestru w systemie Windows, w którym zapisane są relacje między typami plików a aplikacjami, które je obsługują?

Którego z poniższych zadań nie wykonują serwery plików?

Norma TIA/EIA-568-B.2 definiuje szczegóły dotyczące parametrów transmisji

Który poziom macierzy RAID zapisuje dane jednocześnie na wielu dyskach jako jedno urządzenie?

Okablowanie pionowe w systemie strukturalnym łączy się

Jeśli rozdzielczość myszy wynosi 200dpi, a monitor ma rozdzielczość Full HD, to aby przesunąć kursor wzdłuż ekranu, należy przesuń mysz o

Jakie czynności należy wykonać, aby oczyścić zatkane dysze kartridża w drukarce atramentowej?

Autorskie prawo osobiste twórcy do programu komputerowego

Instalacja systemów Linux oraz Windows 7 odbyła się bez żadnych problemów. Systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, przy tej samej specyfikacji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Użytkownik systemu Windows napotyka komunikaty o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?