Pytanie 1

Jakie narzędzie jest najbardziej odpowiednie do delikatnego zgięcia blachy obudowy komputera oraz przykręcenia śruby montażowej w trudno dostępnej lokalizacji?

Wynik: 33/40 punktów (82,5%)

Wymagane minimum: 20 punktów (50%)

Jakie narzędzie jest najbardziej odpowiednie do delikatnego zgięcia blachy obudowy komputera oraz przykręcenia śruby montażowej w trudno dostępnej lokalizacji?

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

Dezaktywacja automatycznych aktualizacji systemu Windows skutkuje

Komputer z BIOS-em firmy Award wyświetlił komunikat o treści Primary/Secondary master/slave hard disk fail. Co taki komunikat może sugerować w kontekście konieczności wymiany?

Częścią eksploatacyjną drukarki laserowej nie jest

Użytkownik pragnie ochronić dane na karcie pamięci przed przypadkowym usunięciem. Taką zabezpieczającą cechę oferuje karta

Aby zapewnić maksymalną ochronę danych przy użyciu dokładnie 3 dysków, powinny one być przechowywane w macierzy RAID

GRUB, LILO, NTLDR to

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Najkrótszy czas dostępu charakteryzuje się

Licencja Windows OEM nie umożliwia wymiany

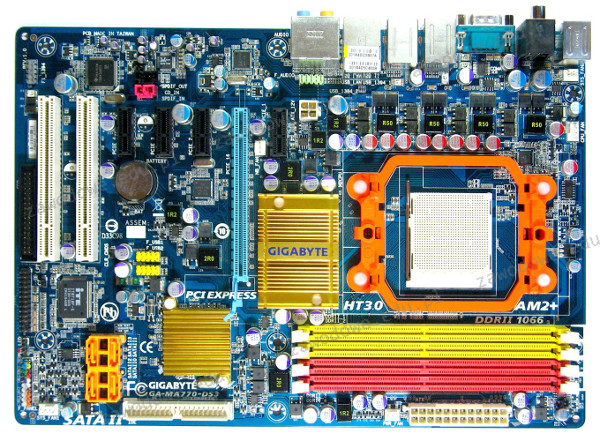

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Do interfejsów pracujących równolegle należy interfejs

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora wysyła sygnał do komputera, co pozwala na określenie pozycji kursora?

Jakie złącze umożliwia przesył danych między przedstawioną na ilustracji płytą główną a urządzeniem zewnętrznym, nie dostarczając jednocześnie zasilania do tego urządzenia przez interfejs?

W jakim typie skanera wykorzystuje się fotopowielacze?

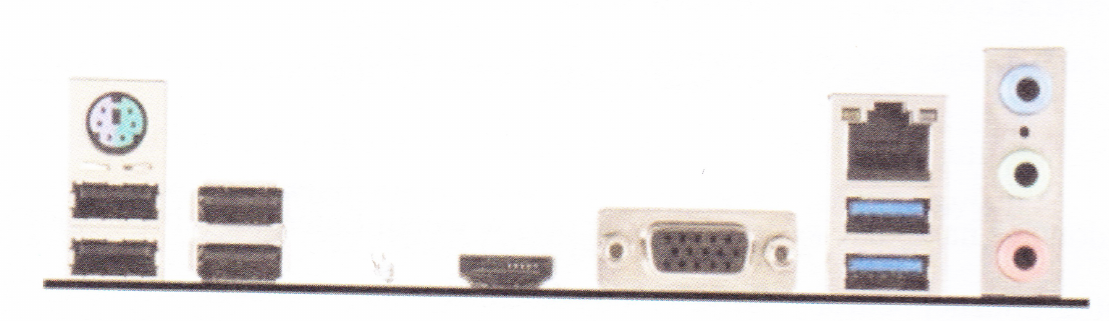

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

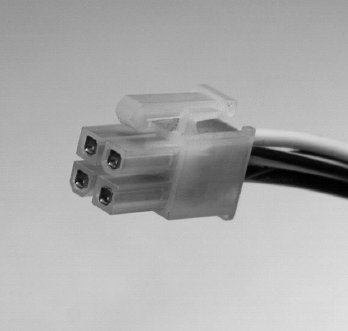

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

Na zdjęciu widoczny jest

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Do ilu sieci należą komputery o podanych w tabeli adresach IP i standardowej masce sieci?

| Komputer | Adres IP |

|---|---|

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Jakie właściwości topologii fizycznej sieci zostały przedstawione w poniższej ramce?

Aby była możliwa komunikacja pomiędzy dwiema różnymi sieciami, do których należą karty sieciowe serwera, należy w systemie Windows Server dodać rolę

Aby serwer z systemem Linux mógł udostępniać pliki i drukarki komputerom klienckim z systemem Windows, należy zainstalować na nim

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?

Którą maskę należy zastosować, aby podzielić sieć o adresie 172.16.0.0/16 na podsieci o maksymalnej liczbie 62 hostów?

Wskaż cechę platformy wirtualizacji Hyper-V.

Które zdanie opisujące domenę Windows jest prawdziwe?

Które słowo należy umieścić w miejscu znaków zapytania w poniższym poleceniu, aby utworzyć konta pracowników?

for %i in (1, 2, 3, 4, 5, 6, 7, 8, 9, 10) do net ??? "pracownik%i" zaq1@WSX /add

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Którego polecenia należy użyć, aby w ruterze skonfigurować trasę statyczną dla adresu następnego skoku 192.168.1.1?

Przedstawiony na ilustracji symbol oznacza

W warstwie łącza danych modelu odniesienia ISO/OSI możliwą przyczyną błędów działania lokalnej sieci komputerowej jest

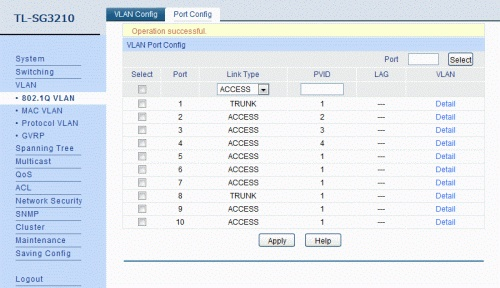

Na ilustracji przedstawiono konfigurację przełącznika z utworzonymi sieciami VLAN. Którymi portami można przesyłać oznaczone ramki z różnych sieci VLAN?

Procesor Intel Core i3 można zamontować w gnieździe

Aby dostęp do systemu Windows Serwer 2016 był możliwy dla 50 urządzeń, bez względu na liczbę użytkowników, należy w firmie zakupić licencję

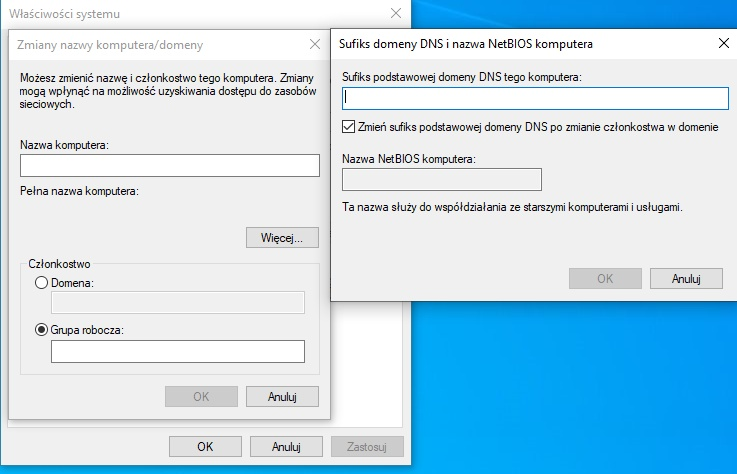

Aby podłączyć stację roboczą z zainstalowanym systemem Windows do domeny zst.local należy

Który protokół umożliwia zarządzanie wieloma folderami pocztowymi oraz pobieranie i operowanie na listach znajdujących się na zdalnym serwerze?

Kopie listy kontaktów telefonu można odzyskać z pliku o rozszerzeniu