Pytanie 1

Jaką komendę należy wpisać w miejsce kropek, aby w systemie Linux wydłużyć standardowy odstęp czasowy między kolejnymi wysyłanymi pakietami przy użyciu polecenia ping?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Jaką komendę należy wpisać w miejsce kropek, aby w systemie Linux wydłużyć standardowy odstęp czasowy między kolejnymi wysyłanymi pakietami przy użyciu polecenia ping?

Zastosowanie symulacji stanów logicznych w obwodach cyfrowych pozwala na

Jaki protokół sygnalizacyjny jest wykorzystywany w technologii VoIP?

Aby użytkownik notebooka z systemem Windows 7 lub nowszym mógł używać drukarki za pośrednictwem sieci WiFi, powinien zainstalować drukarkę na porcie

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm

Składnikiem systemu Windows 10, który zapewnia ochronę użytkownikom przed zagrożeniami ze strony złośliwego oprogramowania, jest program

Poniżej zaprezentowano fragment pliku konfiguracyjnego serwera w systemie Linux. Jaką usługi dotyczy ten fragment?

option domain-name "meinheimnetz";

ddns-update-style none;

default-lease-time 14400;

subnet 192.168.1.0 netmask 255.255.255.0 {

range 192.168.1.10 192.168.1.20;

default-lease-time 14400;

max-lease-time 172800;

}Jakie urządzenie powinno być użyte do łączenia komputerów w strukturze gwiazdy?

Aby przekształcić serwer w kontroler domeny w systemach Windows Server, konieczne jest użycie komendy

Przesyłanie informacji przy użyciu fal radiowych w pasmie ISM odbywa się w standardzie

Jak nazywa się metoda dostępu do medium transmisyjnego z detekcją kolizji w sieciach LAN?

Laptopy zazwyczaj są wyposażone w bezprzewodowe sieci LAN. Ograniczenia ich stosowania dotyczą emisji fal radiowych, które mogą zakłócać działanie innych, istotnych dla bezpieczeństwa, urządzeń?

W strukturze sieciowej zaleca się umiejscowienie jednego punktu abonenckiego na powierzchni wynoszącej

Który z poniższych adresów IPv4 należy do klasy C?

Jakie jest nominalne wyjście mocy (ciągłe) zasilacza o parametrach przedstawionych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

|---|---|---|---|---|---|---|

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336 W | 3,6 W | 12,5 W |

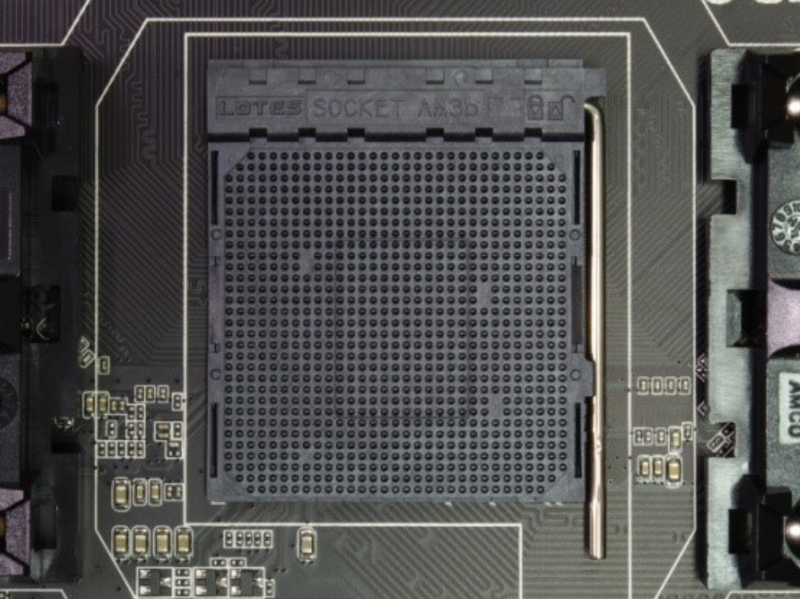

Na płycie głównej wyposażonej w gniazdo przedstawione na zdjęciu można zainstalować procesor

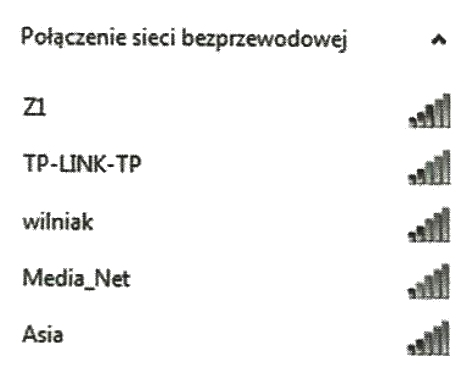

Użytkownik laptopa z systemem Windows 7 widzi dostępne sieci Wi-Fi, jak przedstawiono na ilustracji. Przy konfiguracji połączenia z siecią Z1 musi wprowadzić

Minimalna ilość pamięci RAM wymagana dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Jak wielu hostów można maksymalnie zaadresować w sieci lokalnej, mając do dyspozycji jeden blok adresów klasy C protokołu IPv4?

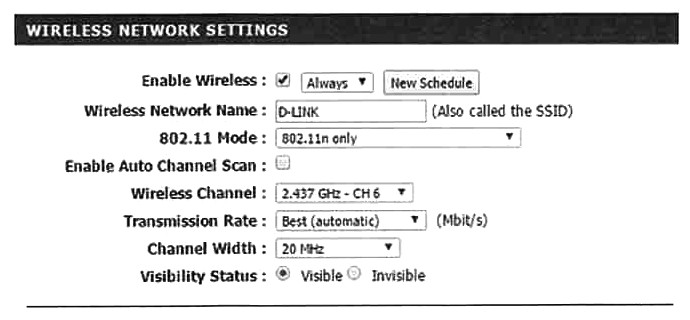

Który z parametrów w ustawieniach punktu dostępowego jest odpowiedzialny za login używany podczas próby połączenia z bezprzewodowym punktem dostępu?

Złącze SC powinno być zainstalowane na kablu

Wykonanie komendy perfmon w konsoli systemu Windows spowoduje

Wskaż technologię stosowaną do dostarczania Internetu, która jest połączona z usługą telewizji kablowej, w której światłowód oraz kabel koncentryczny pełnią rolę medium transmisyjnego.

Która z możliwości konfiguracji ustawień dla użytkownika z ograniczonymi uprawnieniami w systemie Windows jest oferowana przez przystawkę secpol?

Ile maksymalnie kanałów z dostępnego pasma kanałów w standardzie 802.11b może być używanych w Polsce?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z poniższych protokołów jest wykorzystywany do uzyskiwania dynamicznych adresów IP?

Jakie zdanie charakteryzuje SSH Secure Shell?

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Aby uruchomić monitor wydajności oraz niezawodności w systemie Windows, należy skorzystać z przystawki

Która para: protokół – warstwa, w której funkcjonuje protokół, jest prawidłowo zestawiona według modelu TCP/IP?

Medium transmisyjne, które jest odporne na zakłócenia elektromagnetyczne i atmosferyczne, to

Podstawowym zadaniem mechanizmu Plug and Play jest

Możliwość odzyskania listy kontaktów na telefonie z systemem Android występuje, jeśli użytkownik wcześniej zsynchronizował dane urządzenia z Google Drive za pomocą

Drukarką przeznaczoną do druku etykiet i kodów kreskowych, która drukuje poprzez roztapianie pokrycia specjalnej taśmy, w wyniku czego barwnik z niej zostaje przyklejony do materiału, na którym następuje drukowanie jest drukarka

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

Zużyty sprzęt elektryczny lub elektroniczny, na którym znajduje się symbol zobrazowany na ilustracji, powinien być

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

Na stronie wydrukowanej w drukarce atramentowej pojawiają się smugi, kropki, kleksy i plamy. Aby rozwiązać problemy z jakością wydruku, należy

Gdy w przeglądarce internetowej wpiszemy adres HTTP, pojawia się błąd "403 Forbidden", co oznacza, że