Pytanie 1

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

Aby zasilić najbardziej wydajne karty graficzne, konieczne jest dodatkowe 6-pinowe gniazdo zasilacza PCI-E, które dostarcza napięcia

Które narzędzie jest przeznaczone do lekkiego odgięcia blachy obudowy komputera oraz zamocowania śruby montażowej w trudno dostępnym miejscu?

Jakie połączenie bezprzewodowe należy zastosować, aby mysz mogła komunikować się z komputerem?

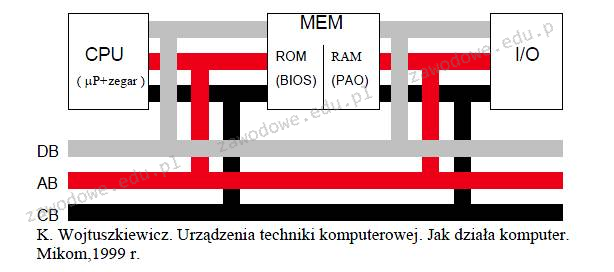

Który z komponentów komputera, gdy zasilanie jest wyłączone, zachowuje program inicjujący uruchamianie systemu operacyjnego?

Zdiagnostykowane wyniki wykonania polecenia systemu Linux odnoszą się do ```/dev/sda: Timing cached reads: 18100 MB in 2.00 seconds = 9056.95 MB/sec```

Najwyższą prędkość transmisji danych w sieciach bezprzewodowych zapewnia standard

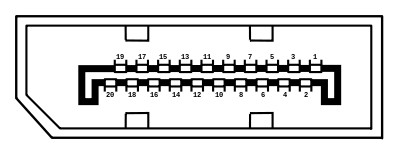

Podaj standard interfejsu wykorzystywanego do przewodowego łączenia dwóch urządzeń.

Na załączonym rysunku przedstawiono

Zamiana koncentratorów na switch'e w sieci Ethernet doprowadzi do

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

Mysz bezprzewodowa jest podłączona do komputera, jednak kursor nie porusza się gładko i „skacze” po ekranie. Możliwą przyczyną problemu z urządzeniem może być

Ile bajtów odpowiada jednemu terabajtowi?

Jakiego narzędzia należy użyć do zakończenia końcówek kabla UTP w module keystone z złączami typu 110?

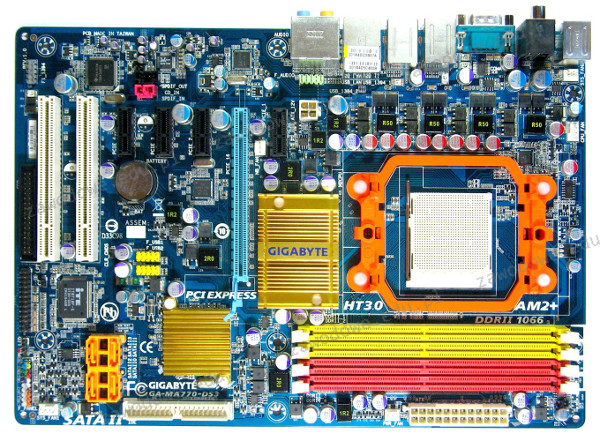

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Który typ drukarki stosuje metodę, w której stały barwnik jest przenoszony z taśmy na papier odporny na wysoką temperaturę?

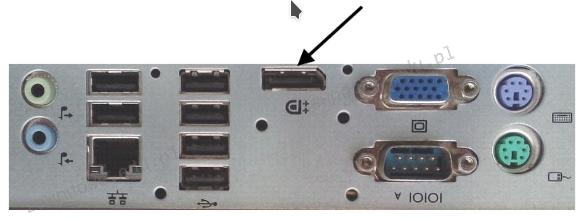

Na ilustracji ukazany jest tylny panel stacji roboczej. Strzałką wskazano port

Jakie złącze umożliwia przesył danych między przedstawioną na ilustracji płytą główną a urządzeniem zewnętrznym, nie dostarczając jednocześnie zasilania do tego urządzenia przez interfejs?

Literowym symbolem P oznacza się

Jaką pamięć RAM można użyć z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, obsługującą maksymalnie 128GB, 4x PCI-E 16x, RAID, USB 3.1, S-2011-V3/ATX?

Jaką minimalną ilość pamięci RAM powinien mieć komputer, aby zainstalować 32-bitowy system operacyjny Windows 7 i móc efektywnie korzystać z trybu graficznego?

Podczas pracy dysk twardy wydaje stukanie, a uruchamianie systemu oraz odczyt danych są znacznie spowolnione. W celu naprawienia tej awarii, po wykonaniu kopii zapasowej danych na zewnętrznym nośniku należy

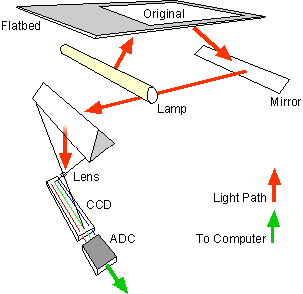

Przedstawiony schemat przedstawia zasadę działania

Aby bezpośrednio połączyć dwa komputery w przewodowej sieci LAN, należy zastosować

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Zabrudzony czytnik w napędzie optycznym powinno się czyścić

Tworzenie obrazu dysku ma na celu

Jeśli jednostka alokacji ma 1024 bajty, to pliki podane w tabeli zajmują na dysku:

Nazwa Wielkość

Ala.exe 50B

Dom.bat 1024B

Wirus.exe 2kB

Domes.exr 350B

Aby połączyć projektor multimedialny z komputerem, nie można zastosować złącza

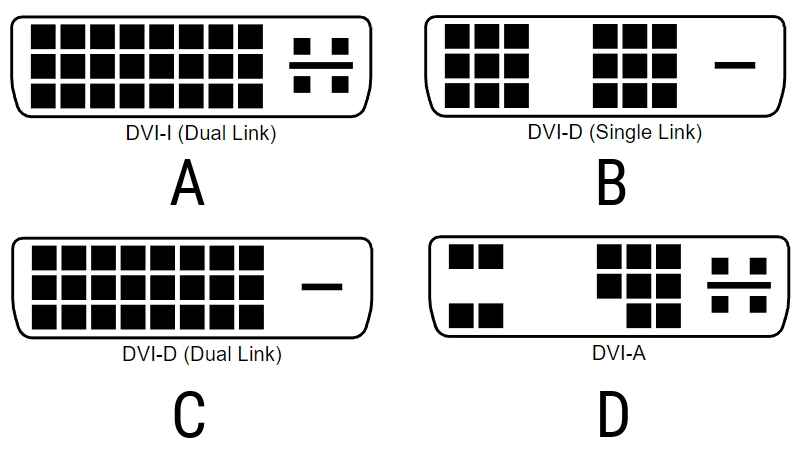

Który standard złącza DVI pozwala na przesyłanie jedynie sygnału analogowego?

Obecnie pamięci podręczne drugiego poziomu procesora (ang. "L-2 cache") są zbudowane z układów pamięci

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

W cenniku usług informatycznych znajdują się poniższe wpisy. Jaki będzie koszt dojazdu serwisanta do klienta, który mieszka poza miastem, w odległości 15km od siedziby firmy?

| Dojazd do klienta na terenie miasta – 25 zł netto |

| Dojazd do klienta poza miastem – 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony. |

Na ilustracji ukazano port

Jakie złącze powinna mieć karta graficzna, aby mogła być bezpośrednio podłączona do telewizora LCD, który ma tylko analogowe złącze do komputera?

Zgodnie z normą TIA/EIA-568-B.1 kabel UTP 5e z przeplotem powstaje poprzez zamianę lokalizacji w wtyczce 8P8C następujących par żył (odpowiednio według kolorów):