Pytanie 1

Najłatwiej zidentyfikować błędy systemu operacyjnego Windows wynikające z konfliktów sprzętowych, takich jak przydzielanie pamięci, przerwań IRQ oraz kanałów DMA, przy użyciu narzędzia

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Najłatwiej zidentyfikować błędy systemu operacyjnego Windows wynikające z konfliktów sprzętowych, takich jak przydzielanie pamięci, przerwań IRQ oraz kanałów DMA, przy użyciu narzędzia

Komputer posiada mysz bezprzewodową, ale kursor nie porusza się gładko, tylko "skacze" na ekranie. Możliwą przyczyną problemu z urządzeniem może być

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Standard IEEE 802.11b dotyczy sieci

Zastosowanie symulacji stanów logicznych w obwodach cyfrowych pozwala na

Polecenie tar w systemie Linux służy do

"Gorące podłączenie" ("Hot plug") oznacza, że urządzenie, które jest podłączane, ma

Wskaź, które z poniższych stwierdzeń dotyczących zapory sieciowej jest nieprawdziwe?

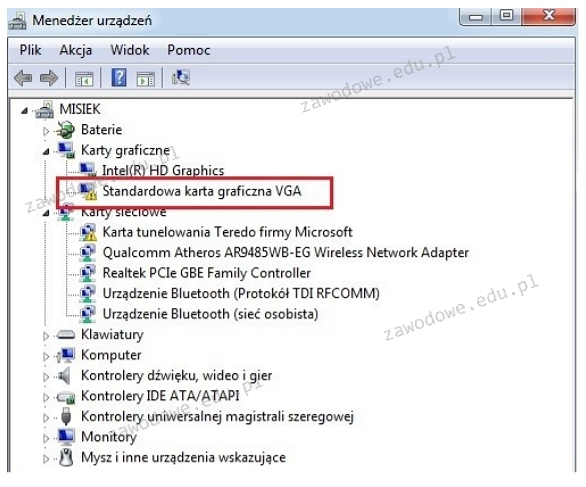

Informacja zawarta na ilustracji może wskazywać na

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę hasła oraz stosowanie haseł o odpowiedniej długości i spełniających wymagania dotyczące złożoności, należy ustawić

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików zapisanych na dysku twardym, konieczne jest wykonanie

Aby zapewnić użytkownikom Active Directory możliwość logowania oraz dostęp do zasobów tej usługi w sytuacji awarii kontrolera domeny, co należy zrobić?

Jaką liczbę naturalną reprezentuje zapis 41 w systemie szesnastkowym w systemie dziesiętnym?

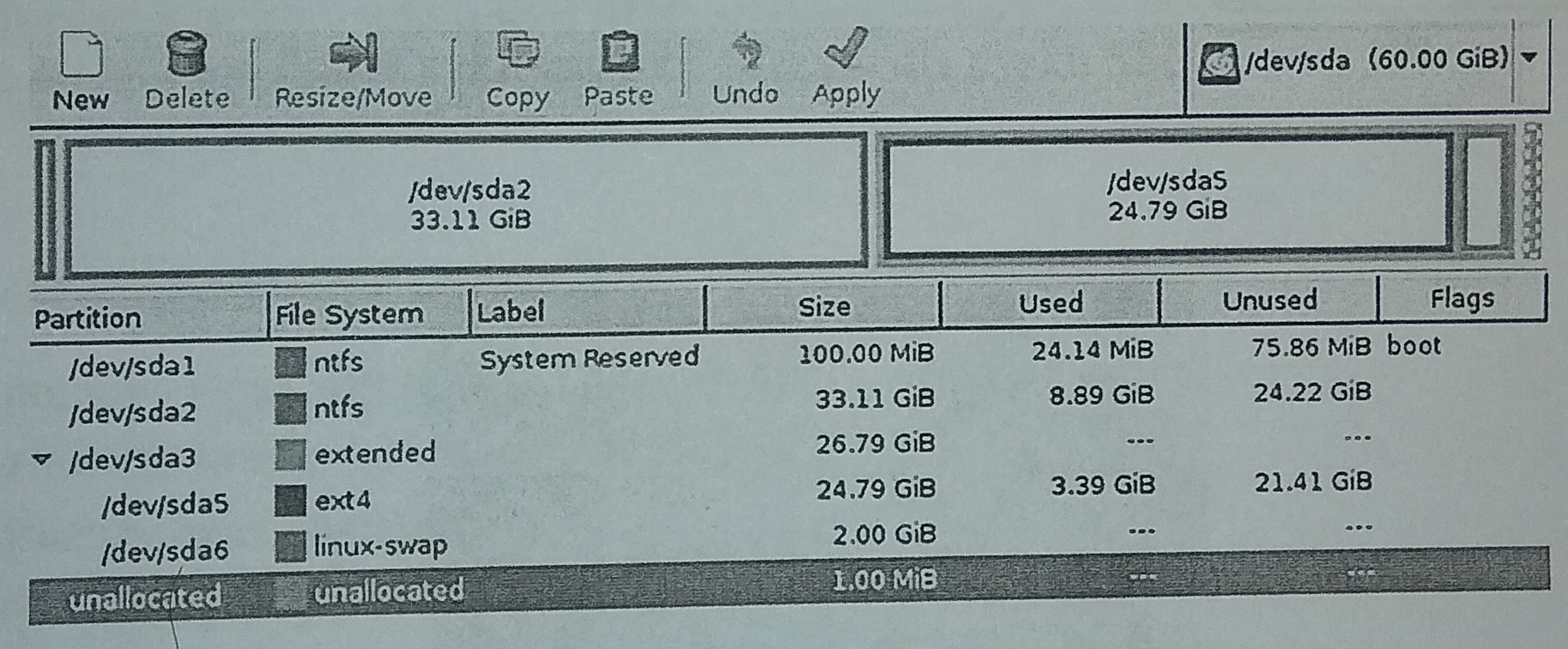

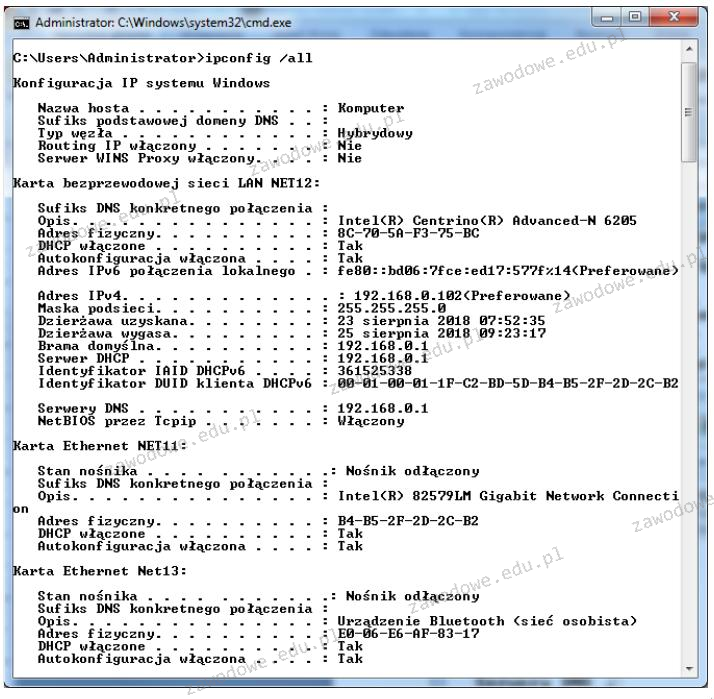

Analiza danych wyświetlonych przez program umożliwia stwierdzenie, że

System operacyjny został poddany atakowi przez oprogramowanie szpiegujące. Po usunięciu problemów, aby zapobiec przyszłym atakom, należy

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

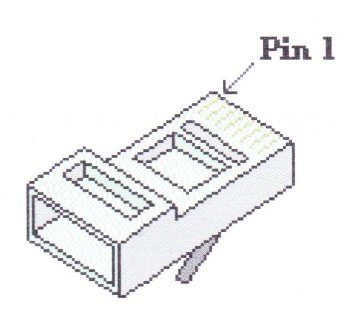

Jak wygląda układ przewodów w złączu RJ45 zgodnie z kolejnością połączeń T568A?

Jakie urządzenie łączy sieć lokalną z siecią rozległą?

Moduł Mini-GBiCSFP pełni funkcję

W której warstwie modelu odniesienia ISO/OSI działają protokoły IP oraz ICMP?

Jakim sposobem zapisuje się dane na nośnikach BD-R?

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Rodzaje ataków mających na celu zakłócenie funkcjonowania aplikacji oraz procesów w urządzeniach sieciowych to ataki klasy

Minimalna zalecana ilość pamięci RAM dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można określić, że ta pamięć

Zewnętrzny dysk 3,5 cala o pojemności 5 TB, przeznaczony do archiwizacji lub tworzenia kopii zapasowych, dysponuje obudową z czterema różnymi interfejsami komunikacyjnymi. Który z tych interfejsów powinno się użyć do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

Jakie polecenie w systemie Linux umożliwia wyświetlenie zawartości katalogu?

Standardowo, w systemie Linux, twardy dysk w standardzie SATA jest oznaczany jako

Administrator systemu Windows zauważył znaczne spowolnienie działania komputera spowodowane niską ilością dostępnej pamięci RAM. W celu zidentyfikowania programu, który zużywa jej najwięcej, powinien skorzystać z narzędzia

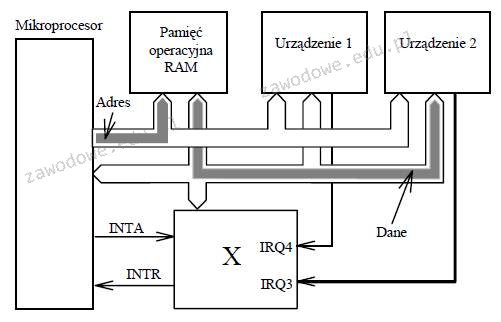

Na przedstawionym schemacie blokowym fragmentu systemu mikroprocesorowego, co oznacza symbol X?

W klasycznym adresowaniu, adres IP 74.100.7.8 przynależy do

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych w komputerze, można zauważyć, że

Element drukujący, składający się z wielu dysz połączonych z mechanizmem drukującym, znajduje zastosowanie w drukarce

Jakie medium transmisyjne gwarantuje izolację galwaniczną pomiędzy systemami przesyłu danych?

Który typ drukarki stosuje metodę, w której stały barwnik jest przenoszony z taśmy na papier odporny na wysoką temperaturę?

Jaki protokół jest stosowany wyłącznie w sieciach lokalnych, gdzie działają komputery z systemami operacyjnymi firmy Microsoft?

Protokół User Datagram Protocol (UDP) należy do

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

Który typ profilu użytkownika zmienia się i jest zapisywany na serwerze dla klienta działającego w sieci Windows?

Która z poniższych opcji nie jest wykorzystywana do zdalnego zarządzania stacjami roboczymi?