Pytanie 1

Największe pasmo transmisji sygnału charakteryzuje się

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Największe pasmo transmisji sygnału charakteryzuje się

Błąd przesunięcia zera w konwerterze A/C definiowany jest przez wartość napięcia

Która z wymienionych sieci stosuje komutację komórek?

Określ rodzaj licencji, która pozwala na darmowe dystrybuowanie aplikacji bez ujawniania kodu źródłowego oraz nieodpłatne użytkowanie oprogramowania, przy czym można pobierać opłaty za produkty stworzone z jego wykorzystaniem?

Przetwornik A/C z równoważeniem ładunków elektrycznych przetwarza sygnał metodą

Jaka licencja dotyczy oprogramowania, które umożliwia korzystanie w tym samym czasie przez liczbę użytkowników określoną w umowie?

Aby sprawdzić ciągłość kabla UTP Cat 5e oraz wykrywać odwrócone i skrzyżowane pary, należy użyć

W systemach operacyjnych obsługujących wiele zadań, co oznacza skrót PID?

Przedstawione na rysunku narzędzie jest stosowane do montażu

W dokumentacji zestawu komputerowego zapisano: nośnik pamięci, nazwany recovery disc, został dołączony do zestawu komputerowego. Co oznacza ten zapis?

W jakiej generacji telefonii komórkowej wprowadzono standard transmisji danych LTE (ang. Long Term Evolution)?

Jakie komunikaty w protokole SNMP są standardowo przesyłane na port 162 TCP lub UDP?

Najskuteczniejszym sposobem ochrony komputera przed złośliwym oprogramowaniem jest

Której metody kodowania dotyczy podany opis?

| Na początku sygnał przyjmuje stan odpowiadający jego wartości binarnej, w środku czasu transmisji bitu następuje zmiana sygnału na przeciwny. Dla zera poziom zmienia się z niskiego na wysoki, dla jedynki – z wysokiego na niski. Konwencja ta została wprowadzona przez G. E. Thomasa w 1949 roku. |

W światłowodach jednomodowych sygnał doświadcza dyspersji chromatycznej, która jest wynikiem dwóch zjawisk:

Z centralką PAX nie jest możliwe połączenie ze

Interfejs rutera ma adres 192.200.200.5/26. Ile dodatkowych urządzeń może być podłączonych w tej podsieci?

Zakładka Advanced Chipset Features lub Chipset Features Setup w BIOS-ie umożliwia

Reflektometrem OTDR dokonano pomiaru odcinka włókna światłowodowego, uzyskując na wyświetlaczu obraz jak na rysunku. Na podstawie tego pomiaru można stwierdzić, że tłumienie włókna na odcinku A-B wynosi

Jaki prefiks maski powinien wybrać dostawca internetu, aby z adresu IPv4 74.0.0.0 /8 uzyskać dokładnie 32 podsieci?

Norma IEEE 802.11 odnosi się do sieci

Jak określa się algorytm zarządzania kolejką, w którym pakiety, które jako pierwsze trafiły do bufora, opuszczają go w tej samej kolejności, w jakiej do niego dotarły?

Fizyczny punkt styku z siecią PSTN (Public Switching Telephone Network) nazywany jest

Do jakich celów wykorzystuje się ekranowanie kabli miedzianych?

Który nośnik, biorąc pod uwagę jego pojemność, najlepiej nadaje się do przechowywania kopii zapasowej dysku twardego o wielkości powyżej 1 TB?

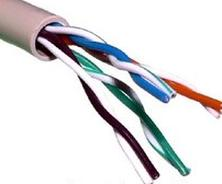

Skretka przedstawiona na rysunku, zgodnie z normą ISO/IEC 11801:2002, jest oznaczana symbolem

Który rodzaj komutacji umożliwia przesyłanie informacji metodą bezpołączeniową?

Urządzenie ADSL umożliwia dostęp do internetu dla abonentów

Jaką przepływność ma kanał typu D w ISDN PRA?

Oblicz codzienny koszt zużycia energii elektrycznej przez komputer, który działa przez 4 godziny w ciągu dnia. Moc, którą pobiera zestaw, wynosi 0,5 kW. Cena za 1 kWh to 0,15 zł?

Jaką impedancję falową ma kabel koncentryczny oznaczony jako RG58?

Jak wiele urządzeń można maksymalnie zaadresować w sieci 36.239.30.0/23?

Który z protokołów służy do wymiany informacji o ścieżkach pomiędzy różnymi systemami autonomicznymi?

Które urządzenie służy do pomiaru tłumienia w torze optycznym sieci światłowodowej?

Metryka rutingu to wartość stosowana przez algorytmy rutingu do wyboru najbardziej efektywnej ścieżki. Wartość metryki nie jest uzależniona od

Jakie urządzenia są wymagane do pomiaru strat mocy optycznej w światłowodzie?

Jaką rolę odgrywa filtr dolnoprzepustowy w układzie próbkującym?

Który protokół routingu służy do wymiany danych o trasach między różnymi systemami autonomicznymi?

Modulacja, która polega na jednoczesnej zmianie amplitudy oraz fazy sygnału nośnego, gdzie każda modyfikacja fali nośnej koduje czterobitową informację wejściową, definiowana jest jako modulacja

Zmierzone amplitudy sygnału okresowego o stałej częstotliwości na początku oraz na końcu toru transmisyjnego wyniosły odpowiednio U1=100 mV i U2=10 mV. Jakie tłumienie charakteryzuje ten tor dla danej częstotliwości?