Pytanie 1

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Na ilustracji zaprezentowane jest urządzenie do

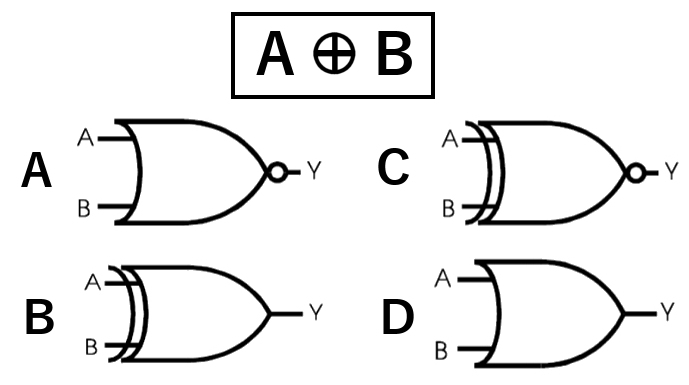

Do realizacji alternatywy logicznej z negacją należy użyć funktora

Jakie urządzenie zapewnia zabezpieczenie przed różnorodnymi atakami z sieci i może również realizować dodatkowe funkcje, takie jak szyfrowanie danych przesyłanych lub automatyczne informowanie administratora o włamaniu?

Zarządzanie partycjami w systemach operacyjnych Windows

Ile maksymalnie kanałów z dostępnego pasma kanałów w standardzie 802.11b może być używanych w Polsce?

Jakim złączem zasilany jest wewnętrzny dysk twardy typu IDE?

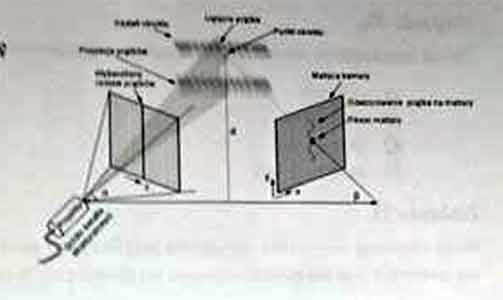

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Jaki protokół służy komputerom do informowania rutera o przynależności do konkretnej grupy multicastowej?

Która z kopii w trakcie archiwizacji plików pozostawia ślad archiwizacji?

Program wirusowy, którego zasadniczym zamiarem jest samoistne rozprzestrzenianie się w sieci komputerowej, to:

W dokumentacji technicznej wydajność głośnika połączonego z komputerem wyraża się w jednostce:

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

Aby stworzyć las w strukturze AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

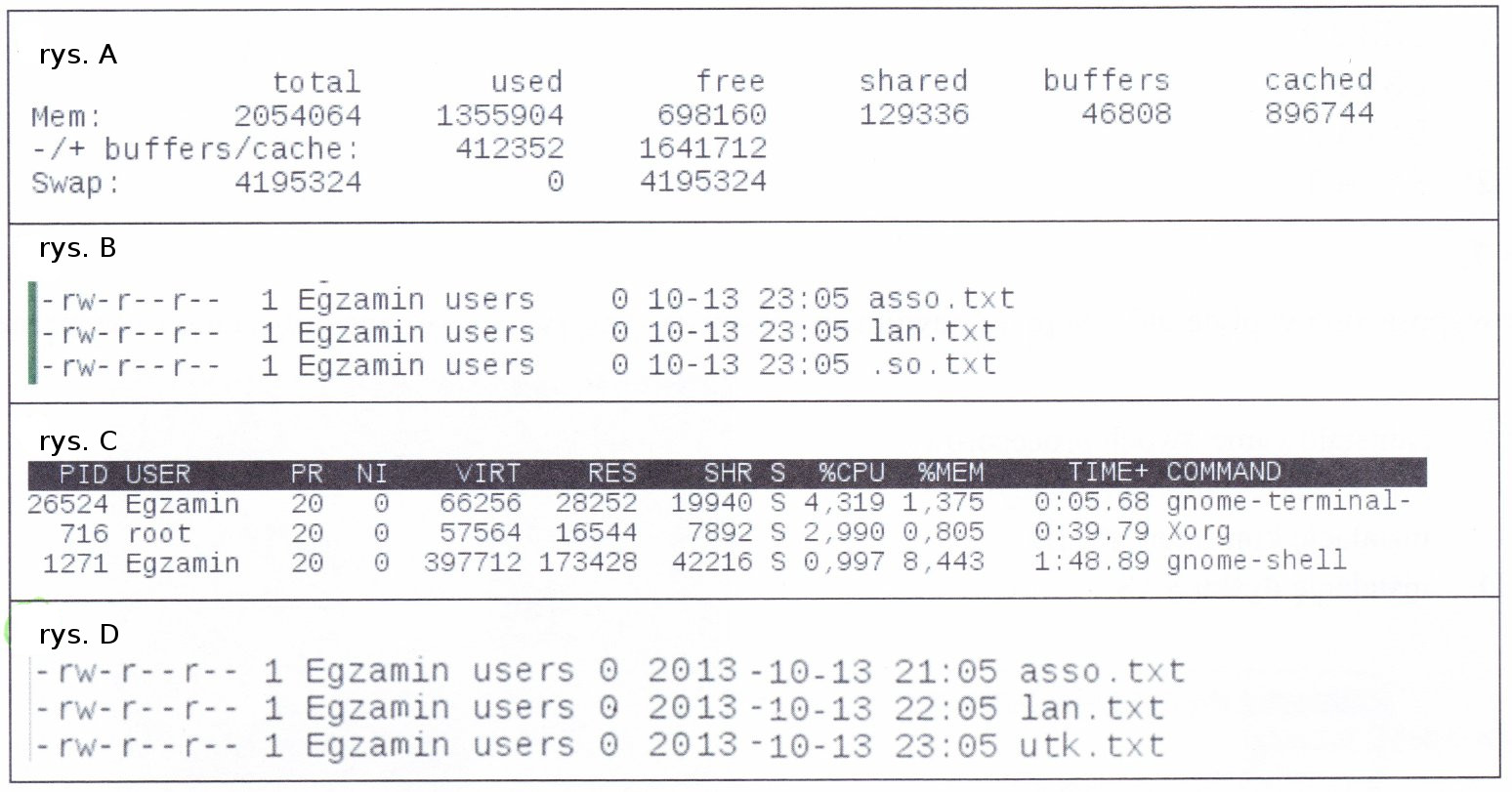

Rezultat wykonania komendy ls -l w systemie Linux ilustruje poniższy rysunek

Na stronie wydrukowanej na drukarce laserowej pojawiają się jaśniejsze i ciemniejsze obszary. Aby rozwiązać problemy z nieciągłością i jakością wydruku, należy

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji pakietów TCP/IP lub protokołów wysyłanych lub odbieranych w sieci komputerowej, do której podłączony jest komputer użytkownika?

W drukarce laserowej do trwałego utrwalania druku na papierze wykorzystuje się

W bezprzewodowej sieci firmowej aktywowano usługę, która zajmuje się tłumaczeniem nazw mnemonicznych. Co to za usługa?

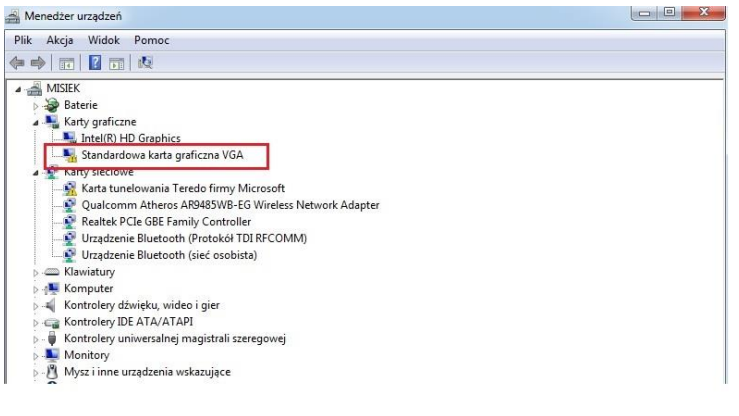

Jakie kroki powinien podjąć użytkownik, aby wyeliminować błąd zaznaczony na rysunku ramką?

W metodzie dostępu do medium CSMA/CD (Carrier Sense Multiple Access with Collision Detection) stacja, która planuje rozpocząć transmisję, nasłuchuje, czy w sieci występuje aktywność, a następnie

Aby monitorować stan dysków twardych w serwerach, komputerach osobistych i laptopach, można użyć programu

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaki instrument służy do określania długości oraz tłumienności kabli miedzianych?

Wartość liczby 1100112 zapisanej w systemie dziesiętnym wynosi

Jaki element sieci SIP określamy jako telefon IP?

Zgodnie z podanym cennikiem, przeciętny koszt zakupu wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Obudowa oraz wyświetlacz drukarki fotograficznej są mocno zabrudzone. Jakie środki należy zastosować, aby je oczyścić bez ryzyka uszkodzenia?

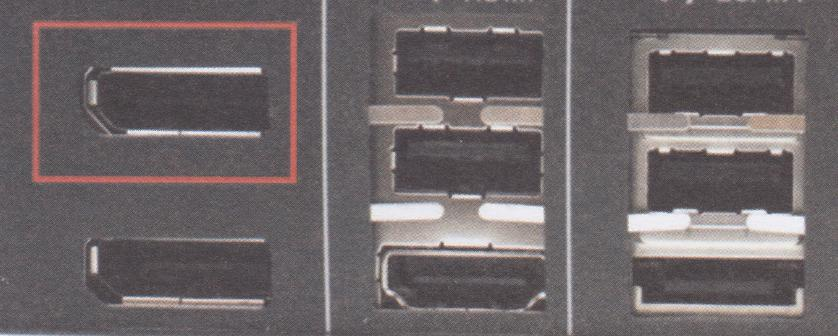

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

Przedstawiona na diagramie strategia zapisu kopii zapasowych na nośnikach nosi nazwę

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Jakie oznaczenie odnosi się do normy dotyczącej okablowania strukturalnego?

Jakie znaczenie ma parametr NVP (Nominal Velocity of Propagation) podczas pomiarów okablowania strukturalnego?

W systemie Linux plik messages zawiera

Wskaź protokół działający w warstwie aplikacji, który umożliwia odbieranie wiadomości e-mail, a w pierwszym etapie pobiera jedynie nagłówki wiadomości, podczas gdy pobranie ich treści oraz załączników następuje dopiero po otwarciu wiadomości.

Jaką konfigurację sieciową może posiadać komputer, który należy do tej samej sieci LAN co komputer z adresem 192.168.1.10/24?

Jaką bramkę logiczną reprezentuje to wyrażenie?

Która karta graficzna nie będzie kompatybilna z monitorem, który posiada złącza pokazane na zdjęciu, przy założeniu, że do podłączenia monitora nie użyjemy adaptera?

Serwer zajmuje się rozgłaszaniem drukarek w sieci, organizowaniem zadań do wydruku oraz przydzielaniem uprawnień do korzystania z drukarek

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST zgłosi błąd odczytu lub zapisu w pamięci CMOS?