Pytanie 1

Aby wymienić uszkodzony moduł pamięci RAM, najpierw trzeba

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Aby wymienić uszkodzony moduł pamięci RAM, najpierw trzeba

W jakiej topologii fizycznej sieci każde urządzenie w sieci posiada dokładnie dwa połączenia, jedno z każdym z sąsiadów, a dane są przesyłane z jednego komputera do drugiego w formie pętli?

Który z parametrów w poleceniu ipconfig w systemie Windows służy do odnawiania konfiguracji adresów IP?

Który kolor żyły znajduje się w kablu skrętkowym?

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Jaką cechę posiada przełącznik w sieci?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji elektrycznej oświetlenia powinna wynosić

W systemie Windows Server narzędzie, które pozwala na zarządzanie zasadami grupowymi, to

Aby zapewnić bezpieczną komunikację terminalową z serwerem, powinno się skorzystać z połączenia z użyciem protokołu

Jakie pasmo częstotliwości definiuje klasa okablowania D?

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

W dwóch sąsiadujących pomieszczeniach w pewnej firmie występują bardzo silne zakłócenia elektromagnetyczne. Aby osiągnąć jak największą przepustowość podczas działania istniejącej sieci LAN, jakie medium transmisyjne powinno zostać użyte?

Co symbolizuje graficzny znak przedstawiony na ilustracji?

W systemie Windows przypadkowo zlikwidowano konto użytkownika, lecz katalog domowy pozostał nietknięty. Czy możliwe jest odzyskanie nieszyfrowanych danych z katalogu domowego tego użytkownika?

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

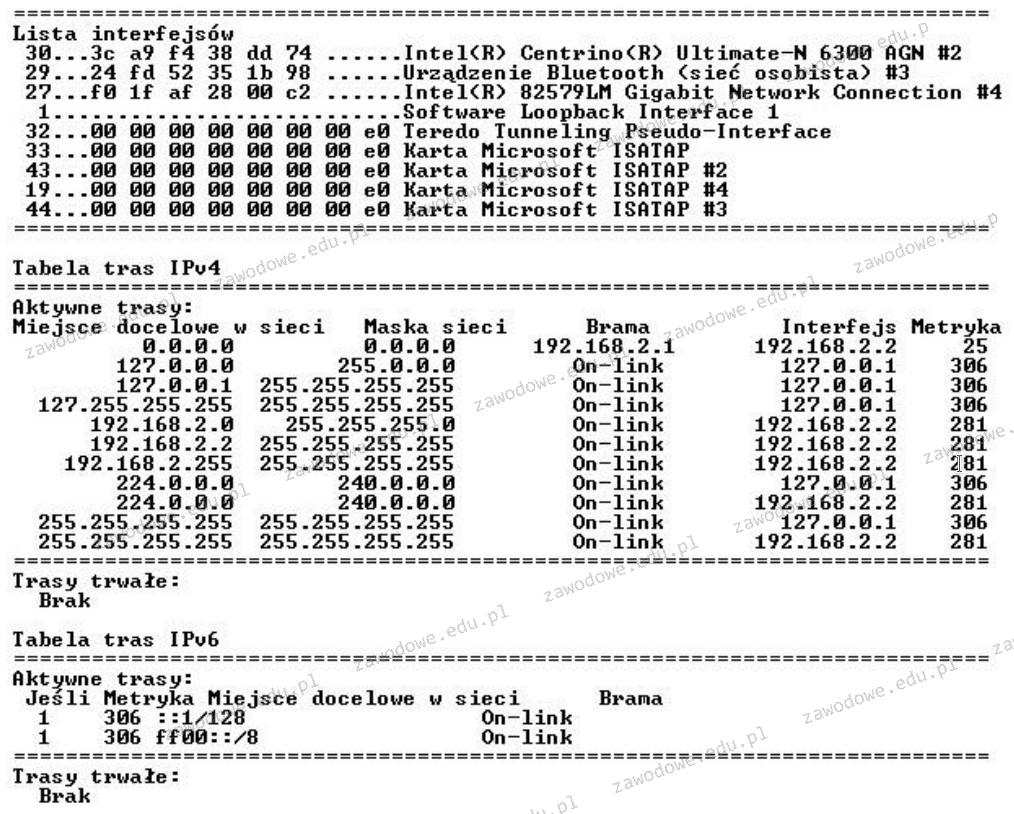

Jaki jest rezultat realizacji którego polecenia w systemie operacyjnym z rodziny Windows, przedstawiony na poniższym rysunku?

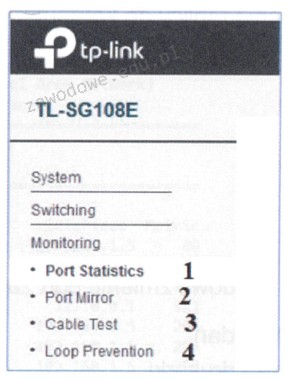

Aby sprawdzić stan podłączonego kabla oraz zdiagnozować odległość do miejsca awarii w sieci, należy użyć funkcji przełącznika oznaczonej numerem

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Menedżer usług IIS (Internet Information Services) w systemie Windows stanowi graficzny interfejs do konfiguracji serwera

Jaki standard Ethernet należy wybrać przy bezpośrednim połączeniu urządzeń sieciowych, które dzieli odległość 1 km?

Która karta graficzna nie będzie współpracowała z monitorem, wyposażonym w złącza przedstawione na zdjęciu (zakładając, że do podłączenia monitora nie można zastosować adaptera)?

Jaką normę stosuje się w przypadku okablowania strukturalnego w sieciach komputerowych?

Jak skonfigurować czas wyczekiwania na wybór systemu w programie GRUB, zanim domyślny system operacyjny zostanie uruchomiony?

Jeżeli podczas uruchamiania systemu BIOS od AWARD komputer wydał długi sygnał oraz dwa krótkie, co to oznacza?

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Podczas skanowania reprodukcji obrazu z magazynu, na skanie pojawiły się regularne wzory, zwane morą. Jaką funkcję skanera należy zastosować, aby pozbyć się mory?

Program do monitorowania, który umożliwia przechwytywanie, nagrywanie oraz dekodowanie różnych pakietów sieciowych to

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Cechą charakterystyczną pojedynczego konta użytkownika w systemie Windows Serwer jest

Główną metodą ochrony sieci komputerowej przed zewnętrznymi atakami jest wykorzystanie

Jaką fizyczną topologię sieci komputerowej przedstawiono na załączonym rysunku?

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Program iftop działający w systemie Linux ma na celu

Który z protokołów jest używany podczas rozpoczynania sesji VoIP?

Po dokonaniu eksportu klucza HKCU stworzona zostanie kopia rejestru zawierająca dane o konfiguracji

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Protokół transportowy bezpołączeniowy to