Pytanie 1

W jednostce ALU do rejestru akumulatora wprowadzono liczbę dziesiętną 600. Jak wygląda jej reprezentacja w systemie binarnym?

Wynik: 1/40 punktów (2,5%)

Wymagane minimum: 20 punktów (50%)

W jednostce ALU do rejestru akumulatora wprowadzono liczbę dziesiętną 600. Jak wygląda jej reprezentacja w systemie binarnym?

Czym jest mapowanie dysków?

Jaką maksymalną prędkość transferu danych umożliwia interfejs USB 3.0?

Brak odpowiedzi na to pytanie.

W topologii fizycznej w kształcie gwiazdy, wszystkie urządzenia działające w sieci są

Brak odpowiedzi na to pytanie.

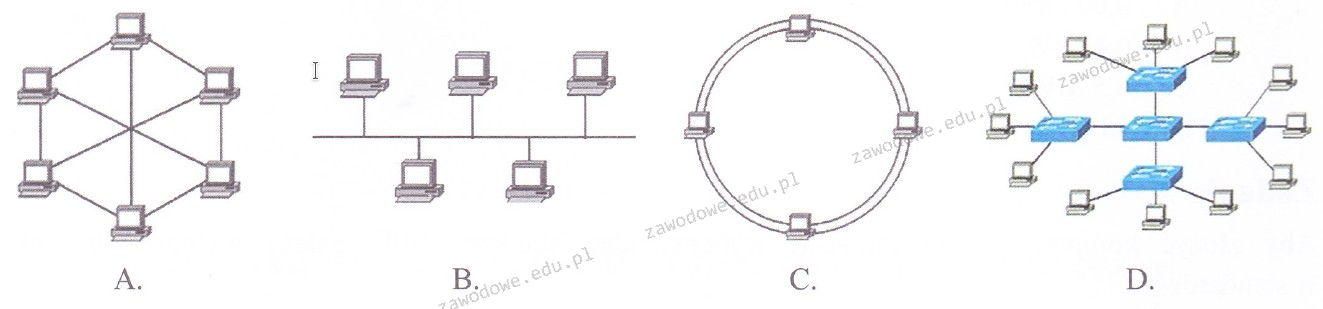

Jaką topologię sieci przedstawia rysunek?

Brak odpowiedzi na to pytanie.

Na ilustracji pokazano tylną część panelu

Brak odpowiedzi na to pytanie.

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Brak odpowiedzi na to pytanie.

Który z podanych adresów IPv4 należy do kategorii B?

Brak odpowiedzi na to pytanie.

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

Brak odpowiedzi na to pytanie.

Jakie zagrożenie nie jest eliminowane przez program firewall?

Brak odpowiedzi na to pytanie.

Licencja grupowa na oprogramowanie Microsoft należy do typu

Brak odpowiedzi na to pytanie.

Na którym z przedstawionych rysunków ukazano topologię sieci typu magistrala?

Brak odpowiedzi na to pytanie.

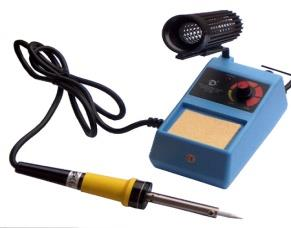

Narzędzie zaprezentowane na rysunku jest wykorzystywane do przeprowadzania testów

Brak odpowiedzi na to pytanie.

Na jakich licencjach są dystrybuowane wersje systemu Linux Ubuntu?

Brak odpowiedzi na to pytanie.

Który przyrząd należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Brak odpowiedzi na to pytanie.

Jaki rodzaj fizycznej topologii w sieciach komputerowych jest pokazany na ilustracji?

Brak odpowiedzi na to pytanie.

Który z systemów operacyjnych przeznaczonych do pracy w sieci jest dostępny na podstawie licencji GNU?

Brak odpowiedzi na to pytanie.

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

Brak odpowiedzi na to pytanie.

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Brak odpowiedzi na to pytanie.

Aby uniknąć utraty danych w aplikacji do ewidencji uczniów, po zakończonej pracy każdego dnia należy wykonać

Brak odpowiedzi na to pytanie.

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma możliwości uruchomienia systemu operacyjnego, ponieważ brakuje dysku twardego oraz napędów optycznych, a system operacyjny uruchamia się z lokalnej sieci. W celu odzyskania utraconej funkcjonalności należy zainstalować w komputerze

Brak odpowiedzi na to pytanie.

Jakie polecenie w systemie Windows pozwala na zmianę zarówno nazwy pliku, jak i jego lokalizacji?

Brak odpowiedzi na to pytanie.

Która usługa opracowana przez Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Brak odpowiedzi na to pytanie.

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz 26-bitową maską?

Brak odpowiedzi na to pytanie.

Scandisk to narzędzie, które wykorzystuje się do

Brak odpowiedzi na to pytanie.

Wskaź na błędny układ dysku z użyciem tablicy partycji MBR?

Brak odpowiedzi na to pytanie.

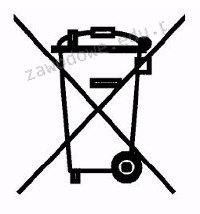

Symbol zaprezentowany powyżej, używany w dokumentacji technicznej, wskazuje na

Brak odpowiedzi na to pytanie.

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Brak odpowiedzi na to pytanie.

Jakiego protokołu używa się do ściągania wiadomości e-mail z serwera pocztowego na komputer użytkownika?

Brak odpowiedzi na to pytanie.

Jak nazywa się protokół, który umożliwia pobieranie wiadomości z serwera?

Brak odpowiedzi na to pytanie.

Jakie jest oprogramowanie serwerowe dla systemu Linux, które pozwala na współdziałanie z grupami roboczymi oraz domenami Windows?

Brak odpowiedzi na to pytanie.

Oblicz koszt brutto materiałów niezbędnych do połączenia w sieć w topologii gwiazdy 3 komputerów wyposażonych w karty sieciowe, wykorzystując przewody o długości 2m. Ceny materiałów podano w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu "skrętka" | 1 zł za 1 metr |

Brak odpowiedzi na to pytanie.

Który z poniższych protokołów służy do zarządzania urządzeniami w sieciach?

Brak odpowiedzi na to pytanie.

Jaki protokół posługuje się portami 20 oraz 21?

Brak odpowiedzi na to pytanie.

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Brak odpowiedzi na to pytanie.

Mamy do czynienia z siecią o adresie 192.168.100.0/24. Ile podsieci można utworzyć, stosując maskę 255.255.255.224?

Brak odpowiedzi na to pytanie.

Program wirusowy, którego zasadniczym zamiarem jest samoistne rozprzestrzenianie się w sieci komputerowej, to:

Brak odpowiedzi na to pytanie.

Norma opisująca standard transmisji Gigabit Ethernet to

Brak odpowiedzi na to pytanie.

Jakie aktywne urządzenie pozwoli na nawiązanie połączenia z lokalną siecią dla 15 komputerów, drukarki sieciowej oraz rutera, wykorzystując kabel UTP?

Brak odpowiedzi na to pytanie.

Na podstawie specyfikacji płyty głównej przedstawionej w tabeli, wskaż największą liczbę kart rozszerzeń, które mogą być podłączone do magistrali Peripheral Component Interconnect?

| BIOS Type | AWARD |

| BIOS Version | 1.8 |

| Memory Sockets | 3 |

| Expansion Slots | 1 AGP/5 PCI |

| AGP 8X | Yes |

| AGP Pro | No |

| NorthbridgeCooling Fan | Yes |

| Northbridge | nForce2 SPP |

| Southbridge | nForce2 MCP-T |

| FSB Speeds | 100-300 1 MHz |

| MultiplierSelection | Yes – BIOS |

| CoreVoltages | 1.1V-2.3V |

| DDR Voltages | 2.5V-2.9V |

| AGP Voltages | 1.5V-1.8V |

| Chipset Voltages | 1.4V-1.7V |

| AGP/PCI Divider in BIOS | Yes (AGP) |

Brak odpowiedzi na to pytanie.