Pytanie 1

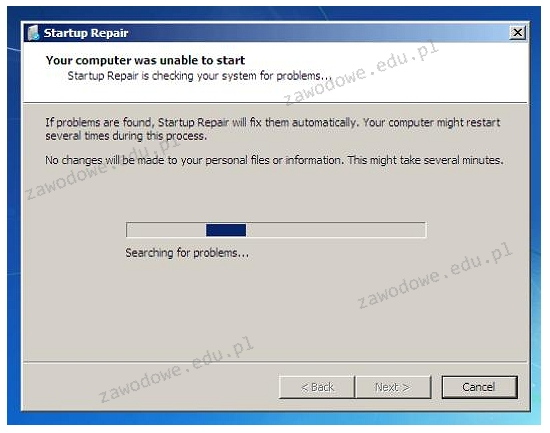

Komunikat, który pojawia się po uruchomieniu narzędzia do przywracania systemu Windows, może sugerować

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Komunikat, który pojawia się po uruchomieniu narzędzia do przywracania systemu Windows, może sugerować

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

Po wykonaniu podanego polecenia w systemie Windows:

net accounts /MINPWLEN:11liczba 11 zostanie przydzielona dla:

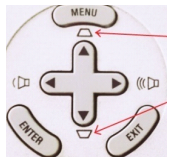

Za pomocą przedstawionego urządzenia można przeprowadzić diagnostykę działania

Domyślnie w programie Eksplorator Windows przy użyciu klawisza F5 uruchamiana jest funkcja

Plik ma rozmiar 2 KiB. Jest to

Na przedstawionej grafice wskazano strzałkami funkcje przycisków umieszczonych na obudowie projektora multimedialnego. Dzięki tym przyciskom można

Osoba korzystająca z lokalnej sieci musi mieć możliwość dostępu do dokumentów umieszczonych na serwerze. W tym celu powinna

Jakie urządzenie pracuje w warstwie łącza danych i umożliwia integrację segmentów sieci o różnych architekturach?

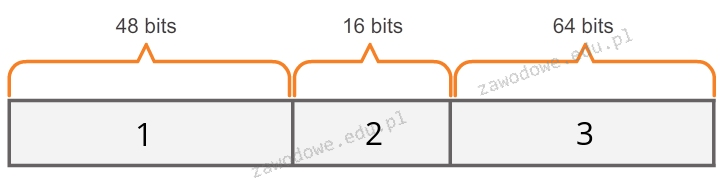

Jaką sekwencję mają elementy adresu globalnego IPv6 typu unicast ukazanym na diagramie?

Udostępnienie drukarki sieciowej codziennie o tej samej porze należy ustawić we właściwościach drukarki, w zakładce

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Laptopy zazwyczaj są wyposażone w bezprzewodowe sieci LAN. Ograniczenia ich stosowania dotyczą emisji fal radiowych, które mogą zakłócać działanie innych, istotnych dla bezpieczeństwa, urządzeń?

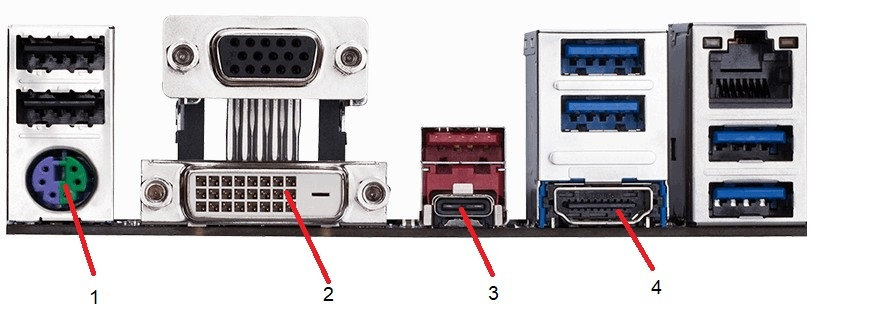

Urządzenie peryferyjne z interfejsem Mini-DIN podłącza się do gniazda oznaczonego na ilustracji

Który typ drukarki stosuje metodę przenoszenia stałego pigmentu z taśmy na papier odporny na wysoką temperaturę?

Polecenie df w systemie Linux umożliwia

Które stwierdzenie odnoszące się do ruterów jest prawdziwe?

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Do ilu sieci należą komputery o podanych w tabeli adresach IP i standardowej masce sieci?

| Komputer | Adres IP |

|---|---|

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Co należy zrobić, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Najbardziej nieinwazyjnym, a zarazem efektywnym sposobem naprawy komputera zainfekowanego wirusem typu rootkit jest

Co oznacza skrót "DNS" w kontekście sieci komputerowych?

GRUB, LILO oraz NTLDR to:

Domyślny port, na którym działa usługa "Pulpit zdalny", to

Zgodnie z normą EIA/TIA T568B, żyły pary odbiorczej w skrętce są pokryte izolatorem w kolorze

Administrator dostrzegł, że w sieci LAN występuje znaczna ilość kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Na zdjęciu widać

Do interfejsów pracujących równolegle należy interfejs

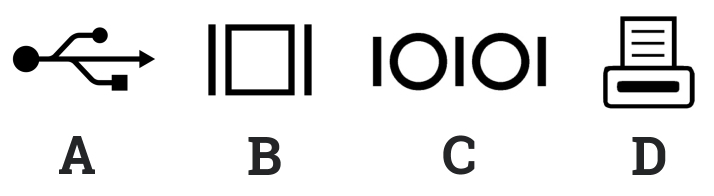

Wskaż ilustrację ilustrującą symbol stosowany do oznaczania portu równoległego LPT?

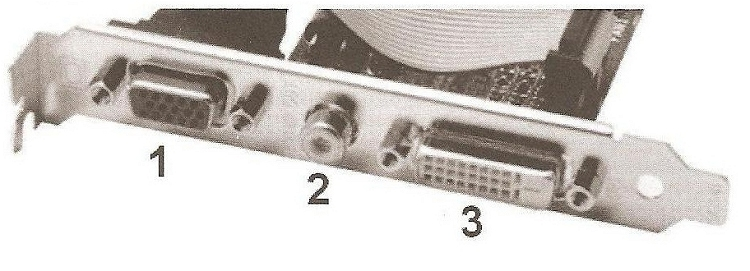

Na ilustracji pokazano porty karty graficznej. Które złącze jest cyfrowe?

Jaki protokół stosują komputery, aby informować rutera o przynależności do konkretnej grupy multicastowej?

Zużyty sprzęt elektryczny lub elektroniczny, na którym znajduje się symbol zobrazowany na ilustracji, powinien być

Narzędzie, które chroni przed nieautoryzowanym dostępem do sieci lokalnej, to

Strategia zapisywania kopii zapasowych ukazana na diagramie określana jest mianem

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

Które z kart sieciowych o podanych adresach MAC zostały wytworzone przez tego samego producenta?

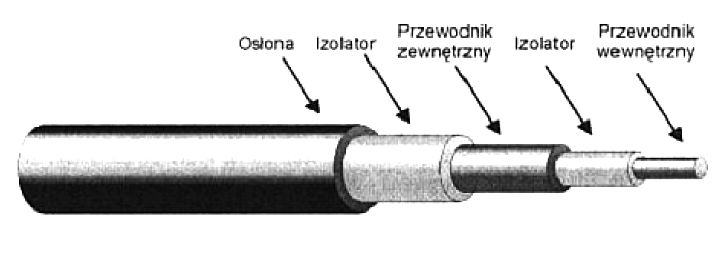

Na ilustracji pokazano przekrój kabla

Komputery K1, K2, K3, K4 są podłączone do interfejsów przełącznika, które są przypisane do VLAN-ów wymienionych w tabeli. Które z tych komputerów mają możliwość komunikacji ze sobą?

| Nazwa komputera | Adres IP | Nazwa interfejsu | VLAN |

| K1 | 10.10.10.1/24 | F1 | VLAN 10 |

| K2 | 10.10.10.2/24 | F2 | VLAN 11 |

| K3 | 10.10.10.3/24 | F3 | VLAN 10 |

| K4 | 10.10.11.4/24 | F4 | VLAN 11 |

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.