Pytanie 1

Główny sposób zabezpieczania danych w sieciach komputerowych przed dostępem nieautoryzowanym to

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Główny sposób zabezpieczania danych w sieciach komputerowych przed dostępem nieautoryzowanym to

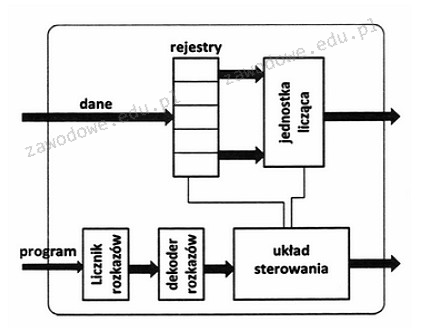

Na schemacie procesora rejestry mają za zadanie przechowywać adres do

Aby zapewnić największe bezpieczeństwo danych przy wykorzystaniu dokładnie 3 dysków, powinny one być zapisywane w macierzy dyskowej

Administrator Active Directory w domenie firma.local pragnie skonfigurować mobilny profil dla wszystkich użytkowników. Ma on być przechowywany na serwerze serwer1, w folderze pliki, który jest udostępniony w sieci jako dane$. Który z parametrów w ustawieniach profilu użytkownika spełnia opisane wymagania?

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Informacja zawarta na ilustracji może wskazywać na

Jaką maksymalną liczbę adresów można przypisać urządzeniom w sieci 10.0.0.0/22?

Jakie polecenie pozwala na przeprowadzenie aktualizacji do nowszej wersji systemu Ubuntu Linux?

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału między segmentami sieci lub jego blokowaniu?

Aby uzyskać optymalną wydajność, karta sieciowa w komputerze stosuje transmisję szeregową.

Największą pojemność spośród nośników optycznych posiada płyta

Moduł w systemie Windows, który odpowiada za usługi informacyjne w Internecie, to

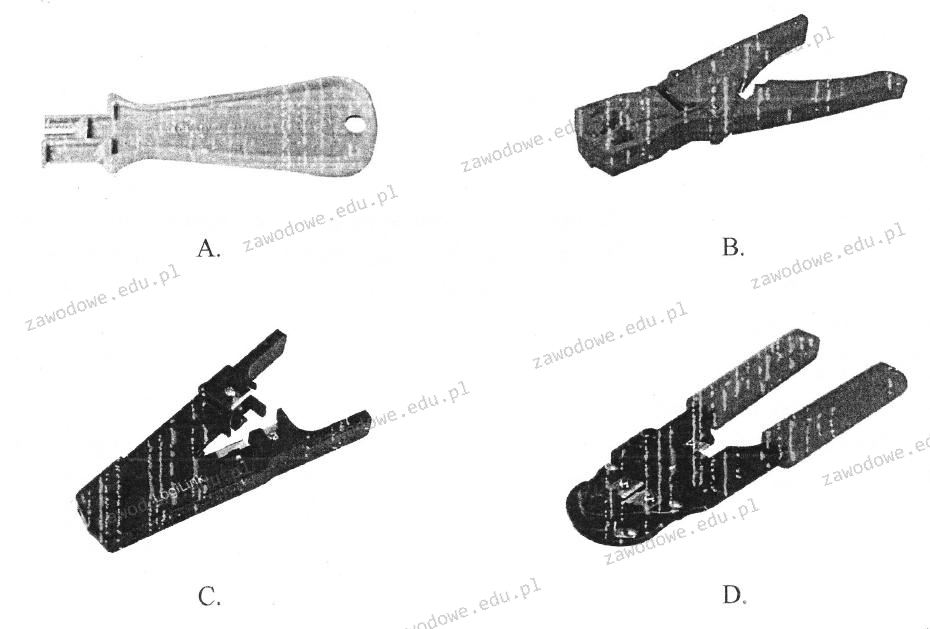

Jaki instrument jest używany do usuwania izolacji?

Na przedstawionym schemacie urządzeniem, które łączy komputery, jest

Jakie urządzenie powinno być wykorzystane do pomiaru mapy połączeń w okablowaniu strukturalnym sieci lokalnej?

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

Aby utworzyć obraz dysku twardego, można skorzystać z programu

Jak najlepiej chronić zgromadzone dane przed ich odczytem w przypadku kradzieży komputera?

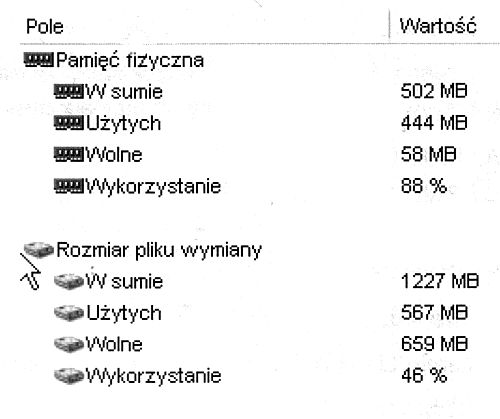

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

Jaki protokół posługuje się portami 20 oraz 21?

Jaka liczba hostów może być podłączona w sieci o adresie 192.168.1.128/29?

Jakie polecenie w systemie Windows służy do analizowania ścieżki, jaką pokonują pakiety w sieci?

Ile warstw zawiera model ISO/OSI?

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji oświetleniowej powinna wynosić

W jakim urządzeniu elektronicznym znajduje się układ RAMDAC?

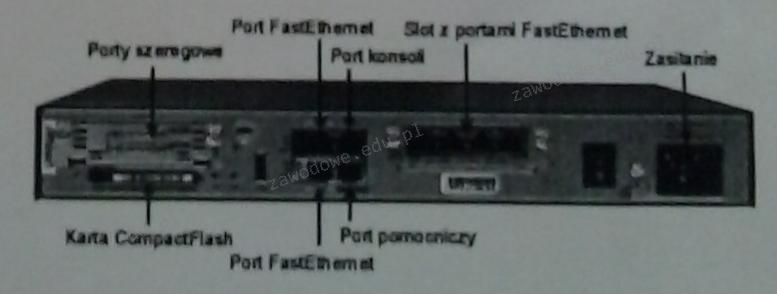

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

Jakie oprogramowanie należy zainstalować, aby serwer Windows mógł obsługiwać usługi katalogowe?

Który standard w połączeniu z odpowiednią kategorią kabla skrętki jest skonfigurowany w taki sposób, aby umożliwiać maksymalny transfer danych?

Które z poniższych poleceń służy do naprawienia głównego rekordu rozruchowego dysku twardego w systemie Windows?

Która z grup w systemie Windows Server ma najniższe uprawnienia?

Który z pakietów powinien być zainstalowany na serwerze Linux, aby komputery z systemem Windows mogły udostępniać pliki oraz drukarki z tego serwera?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaką maksymalną prędkość transferu danych pozwala osiągnąć interfejs USB 3.0?

Aby wyświetlić przedstawioną informację o systemie Linux w terminalu, należy użyć polecenia

Jakie elementy wspierają okablowanie pionowe w sieci LAN?

Nierówne wydruki lub bladości w druku podczas korzystania z drukarki laserowej mogą sugerować

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

W przypadku sieci strukturalnej rekomendowane jest zainstalowanie jednego punktu abonenckiego na obszarze wynoszącym

Adres MAC (Medium Access Control Address) stanowi fizyczny identyfikator interfejsu sieciowego Ethernet w obrębie modelu OSI