Pytanie 1

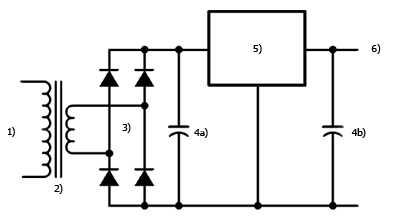

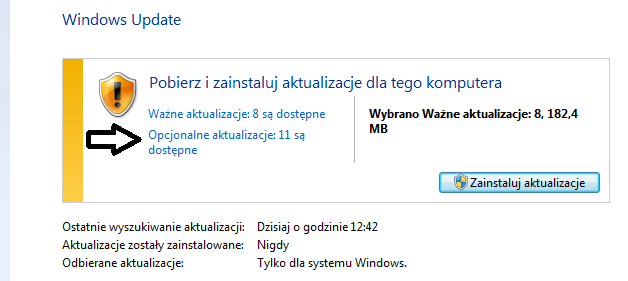

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Wynik: 32/40 punktów (80,0%)

Wymagane minimum: 20 punktów (50%)

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Zgodnie z normą TIA/EIA-568-B.1 kabel UTP 5e z przeplotem powstaje poprzez zamianę lokalizacji w wtyczce 8P8C następujących par żył (odpowiednio według kolorów):

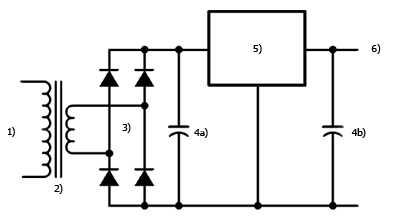

Użytkownik systemu Windows napotyka komunikaty o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Norma TIA/EIA-568-B.2 definiuje parametry specyfikacji transmisyjnej

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

Jaki protokół komunikacyjny jest używany do przesyłania plików w modelu klient-serwer oraz może funkcjonować w dwóch trybach: aktywnym i pasywnym?

Aby przeprowadzić aktualizację zainstalowanego systemu operacyjnego Linux Ubuntu, należy wykorzystać komendę

Jakie narzędzie w systemie Windows pozwala na ocenę wpływu poszczególnych procesów i usług na wydajność procesora oraz na obciążenie pamięci i dysku?

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

Na diagramie okablowania strukturalnego przy jednym z komponentów znajduje się oznaczenie MDF. Z którym punktem dystrybucji jest powiązany ten komponent?

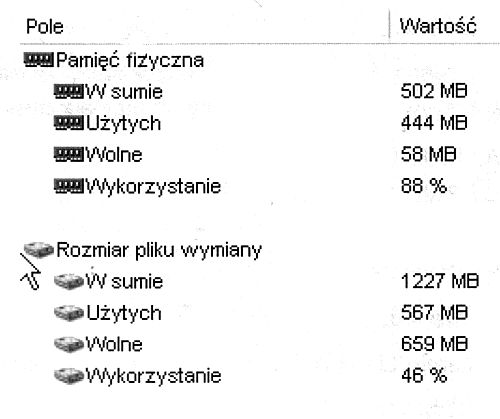

Jeśli użytkownik wybierze pozycję wskazaną strzałką, będzie mógł zainstalować aktualizacje

Po przeprowadzeniu diagnostyki komputera stwierdzono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, umieszczonej w gnieździe PCI Express stacjonarnego komputera, wynosi 87°C. W takiej sytuacji serwisant powinien

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Przerywając działalność na komputerze, możemy szybko wrócić do pracy, wybierając w systemie Windows opcję:

Na ilustracji zaprezentowano końcówkę kabla

Jakie narzędzie powinno się wykorzystać w systemie Windows, aby uzyskać informacje o problemach z systemem?

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Granice dla obszaru kolizyjnego nie są określane przez porty urządzeń takich jak

Z analizy danych przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi 184 styki 64-bitowa magistrala danych Pojemność 1024 MB Przepustowość 3200 MB/s

Administrator dostrzegł, że w sieci LAN występuje wiele kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Które z poniższych twierdzeń na temat protokołu DHCP jest poprawne?

Jaką cechę posiada przełącznik sieciowy?

Na komputerze klienckim z systemem Windows XP plik "hosts" to plik tekstowy, który wykorzystywany jest do przypisywania

Aby przekształcić zeskanowany obraz w tekst, należy użyć oprogramowania, które wykorzystuje metody

Który z wymienionych składników zalicza się do elementów pasywnych sieci?

W systemie Linux wykonanie polecenia chmod 321 start spowoduje przyznanie następujących uprawnień plikowi start:

Podczas pracy dysk twardy wydaje stukanie, a uruchamianie systemu oraz odczyt danych są znacznie spowolnione. W celu naprawienia tej awarii, po wykonaniu kopii zapasowej danych na zewnętrznym nośniku należy

Narzędzie pokazane na ilustracji służy do

Jakie działanie nie przyczynia się do personalizacji systemu operacyjnego Windows?

Aby połączyć dwa przełączniki oddalone o 200 m i zapewnić minimalną przepustowość 200 Mbit/s, powinno się użyć

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Adres projektowanej sieci należy do klasy C. Sieć została podzielona na 4 podsieci, z 62 urządzeniami w każdej z nich. Która z poniżej wymienionych masek jest adekwatna do tego zadania?

Zadania systemu operacyjnego nie obejmują

Wskaż rysunek ilustrujący kondensator stały?

W oznaczeniu procesora INTEL CORE i7-4790 liczba 4 wskazuje na

Które polecenie systemu Linux służy do wyświetlenia informacji o zainstalowanych podzespołach?

Jak nazywa się metoda dostępu do medium transmisyjnego z detekcją kolizji w sieciach LAN?

Wskaż procesor współpracujący z przedstawioną płytą główną.

Zgodnie z ustawą z 14 grudnia 2012 roku o odpadach, wymagane jest