Pytanie 1

Ile podsieci obejmują komputery z adresami: 192.168.5.12/25, 192.168.5.200/25 oraz 192.158.5.250/25?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Ile podsieci obejmują komputery z adresami: 192.168.5.12/25, 192.168.5.200/25 oraz 192.158.5.250/25?

Na rysunku ukazany jest diagram blokowy zasilacza

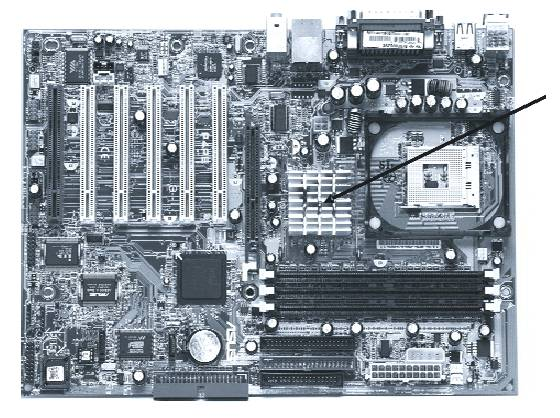

Na ilustracji pokazano płytę główną komputera. Strzałką wskazano

Która lokalizacja umożliwia utworzenie kopii zapasowej dysku systemowego Windows 11?

O ile zwiększy się liczba dostępnych adresów IP w podsieci po zmianie maski z 255.255.255.240 (/28) na 255.255.255.224 (/27)?

Okablowanie wertykalne w sieci strukturalnej łączy

Komputer, którego naprawa ma zostać przeprowadzona u klienta, nie reaguje na wciśnięcie przycisku POWER. Pierwszą czynnością harmonogramu prac związanych z lokalizacją i usunięciem tej usterki powinno być

Usługa umożliwiająca przechowywanie danych na zewnętrznym serwerze, do którego dostęp możliwy jest przez Internet to

Adware to rodzaj oprogramowania

Jakiego typu tablicę partycji trzeba wybrać, aby stworzyć partycję o pojemności 3TB na dysku twardym?

Zgodnie z KNR (katalogiem nakładów rzeczowych), montaż na skrętce 4-parowej modułu RJ45 oraz złącza krawędziowego wynosi 0,07 r-g, a montaż gniazd abonenckich natynkowych to 0,30 r-g. Jaki będzie całkowity koszt robocizny za zamontowanie 10 pojedynczych gniazd natynkowych z modułami RJ45, jeśli wynagrodzenie godzinowe montera-instalatora wynosi 20,00 zł?

Aby sprawdzić dostępną przestrzeń na dysku twardym w systemie Linux, można wykorzystać polecenie

Systemy operacyjne należące do rodziny Linux są dystrybuowane na mocy licencji

Poprzez polecenie dxdiag uruchomione w wierszu poleceń Windows można

W systemie Linux komendą, która jednocześnie podnosi uprawnienia dla procesu uruchamianego z terminala, jest

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

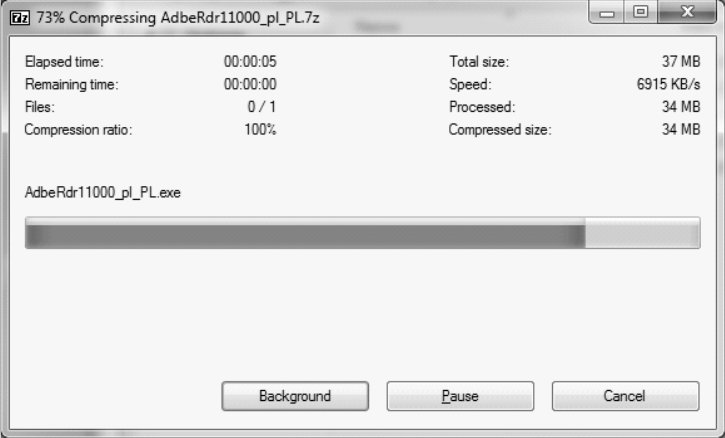

Na dołączonym obrazku ukazano proces

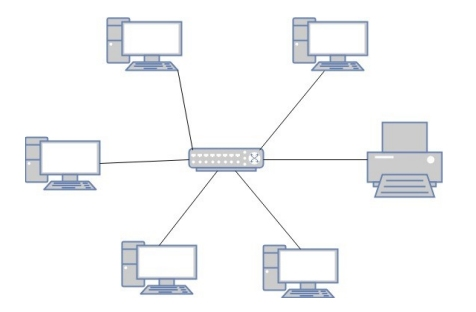

Jaką fizyczną topologię sieci komputerowej ilustruje ten rysunek?

Rodzajem pamięci RAM, charakteryzującym się minimalnym zużyciem energii, jest

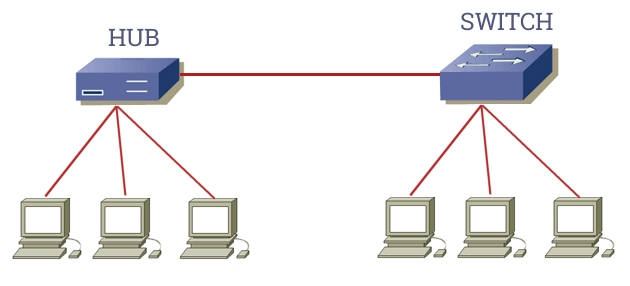

Ile kolizji domenowych występuje w sieci przedstawionej na ilustracji?

Który z protokołów umożliwia bezpieczne połączenie klienta z zachowaniem anonimowości z witryną internetową banku?

W drukarce laserowej do stabilizacji druku na papierze używane są

Możliwą przyczyną usterki drukarki igłowej może być awaria

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie

Który z protokołów w systemach operacyjnych Linux jest używany w sieciach lokalnych?

Jeżeli podczas uruchamiania systemu BIOS od AWARD komputer wydał długi sygnał oraz dwa krótkie, co to oznacza?

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Jakiego materiału używa się w drukarkach tekstylnych?

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Zgłoszona awaria ekranu laptopa może być wynikiem

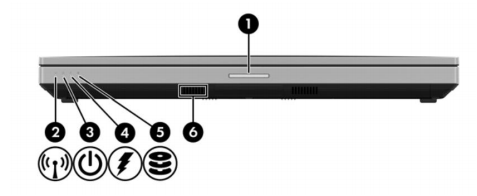

Na ilustracji widoczne jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Wskaż numer odpowiadający kontrolce, która zapala się podczas ładowania akumulatora?

Aby zwolnić adres IP przypisany do konkretnej karty sieciowej w systemie Windows, należy wykorzystać polecenie systemowe

Usługa, która odpowiada za przekształcanie nazw domenowych na adresy IP, to

Jak nazywa się protokół, który pozwala na ściąganie wiadomości e-mail z serwera?

Na ilustracji przedstawiona jest karta

Jak skrót wskazuje na rozległą sieć komputerową, która obejmuje swoim zasięgiem miasto?

Na urządzeniu znajduje się symbol, który stanowi certyfikat potwierdzający zgodność sprzętu w zakresie emisji promieniowania, ergonomii, efektywności energetycznej oraz ekologii, co przedstawiono na rysunku

Wskaż złącze, które nie jest obecne w zasilaczach ATX?