Pytanie 1

Na zdjęciu przedstawiono płytę główną komputera. Elementy oznaczone liczbą 16 to złącza typu

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Na zdjęciu przedstawiono płytę główną komputera. Elementy oznaczone liczbą 16 to złącza typu

Aby zrealizować połączenie kilku komputerów w lokalnej sieci, można zastosować

Kiedy należy odłączyć kabel zasilający, aby wymienić urządzenie w systemie komputerowym?

Podstawowym zadaniem mechanizmu Plug and Play jest

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Adres IP interfejsu sieciowego wynosi 192.0.0.17. Jak wygląda ten adres w systemie binarnym?

Program, który udostępnia dane na temat wydajności zestawu komputerowego to

Przy wymianie komponentów komputerowych system operacyjny powinien być w stanie

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Administrator systemu Linux użył polecenia ```mount /dev/sda2 /mnt/flash``` Co to spowoduje?

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Aby zgasić pożar sprzętu komputerowego, który jest pod napięciem, jaki środek gaśniczy jest niewłaściwy do użycia?

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Jakie są etapy uruchamiania systemu Windows XP na komputerze PC?

Przyczyną niekontrolowanego wypełnienia dysku może być

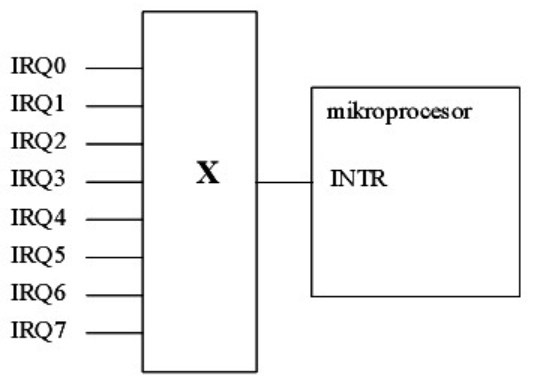

Na podstawie nazw sygnałów sterujących określ funkcję podzespołu komputera oznaczonego na rysunku symbolem X.

Gdy komputer jest uruchamiany, wyświetla się komunikat “CMOS checksum error press F1 to continue, press DEL to setup”, naciśnięcie klawisza DEL spowoduje

Jak wiele urządzeń może być połączonych z portem IEEE 1394?

Na płycie głównej wystąpiła awaria zintegrowanej karty sieciowej. Komputer nie ma zainstalowanego dysku twardego ani żadnych innych nośników, takich jak stacja dysków czy CD-ROM. Klient informuje, że w sieci firmowej komputery nie posiadają żadnych napędów, a wszystkie dane "czyta" się bezpośrednio z serwera. Aby przywrócić utraconą funkcjonalność, należy zainstalować

Jeżeli mysz ma rozdzielczość 200 dpi, a monitor w rozdzielczości Full HD, to aby przesunąć kursor wzdłuż ekranu, należy przemieścić mysz o

Ile sygnałowych linii używa Interfejs RS-232C?

Optymalne natężenie światła, które powinno być odnotowane na klawiaturze komputera, to około

Wskaż błędny podział dysku w przypadku tablicy partycji MBR 1 partycja

W tabeli zamieszczono dane katalogowe procesora AMD Athlon 1333 Model 4 Thunderbird. Z jaką częstotliwością realizowane są przesłania międzyrejestrowe?

| General information | |

|---|---|

| Type | CPU / Microprocessor |

| Market segment | Desktop |

| Family | AMD Athlon |

| CPU part number | A1333AMS3C |

| Stepping codes | AYHIA AYHJAR |

| Frequency (MHz) | 1333 |

| Bus speed (MHz) | 266 |

| Clock multiplier | 10 |

| Gniazdo | Socket A (Socket 462) |

| Notes on AMD A1333AMS3C | |

| ○ Actual bus frequency is 133 MHz. Because the processor uses Double Data Rate bus the effective bus speed is 266 MHz. | |

Używając polecenia dxdiag, które można uruchomić w oknie wiersza poleceń systemu Windows, możliwe jest

Jaką maksymalną wielkość pamięci RAM może obsługiwać system Windows Server 2003 Datacenter na komputerach z procesorem x86?

Co to jest klaster komputerowy?

Technologia umożliwiająca synchronizację działania dwóch lub trzech kart graficznych w celu przyspieszenia renderowania obrazu nosi nazwę

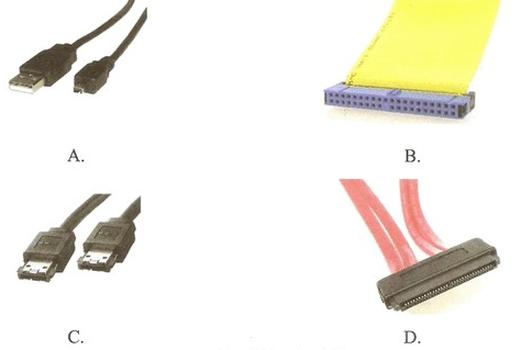

Do podłączenia dysku wyposażonego w interfejs SAS należy zastosować kabel pokazany na rysunku

Czy możliwe jest odzyskanie danych z HDD, którego sterownik silnika SM jest uszkodzony?

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Opisana w ramce technologia stosowana w systemach rodziny Windows to

| Jest to technologia obsługująca automatyczną konfigurację komputera PC i wszystkich zainstalowanych w nim urządzeń. Umożliwia ona rozpoczęcie korzystania z nowego urządzenia (na przykład karty dźwiękowej lub modemu) natychmiast po jego zainstalowaniu bez konieczności przeprowadzania ręcznej jego konfiguracji. Technologia ta jest implementowana w warstwach sprzętowej i systemu operacyjnego, a także przy użyciu sterowników urządzeń i BIOS-u. |

Urządzenie komputerowe, które koniecznie powinno być podpięte do zasilania za pomocą UPS, to

Aby zamocować nowe radiatory na modułach pamięci karty graficznej, gdy stare i uszkodzone zostały usunięte, można wykorzystać

Interfejs SATA 2 (3 Gb/s) umożliwia transfer na poziomie

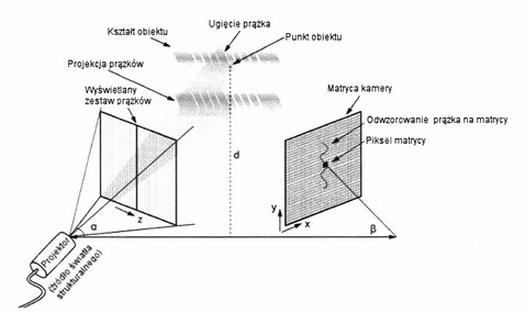

Przedstawiony obok schemat obrazuje zasadę działania skanera

Jaki typ pliku umożliwia zapis zdjęć z aparatu cyfrowego z najwyższą jakością odwzorowania oraz pozwala na szczegółową edycję na komputerze?

Jaką temperaturę powinno się utrzymywać w pomieszczeniach z komputerami w okresie zimowym?

To pytanie jest dostępne tylko dla uczniów i nauczycieli. Zaloguj się lub utwórz konto aby zobaczyć pełną treść pytania.

Odpowiedzi dostępne po zalogowaniu.

Wyjaśnienie dostępne po zalogowaniu.

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press FI to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje