Pytanie 1

Jakie polecenia należy zrealizować, aby zamontować pierwszą partycję logiczną dysku primary slave w systemie Linux?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Jakie polecenia należy zrealizować, aby zamontować pierwszą partycję logiczną dysku primary slave w systemie Linux?

Wskaż nieprawidłowy sposób podziału dysków MBR na partycje?

Zgodnie z normą PN-EN 50173, minimalna liczba punktów rozdzielczych, które należy zainstalować, wynosi

Jaką usługę serwerową wykorzystuje się do automatycznej konfiguracji interfejsów sieciowych urządzeń klienckich?

Który standard w połączeniu z odpowiednią kategorią kabla skrętki jest skonfigurowany w taki sposób, aby umożliwiać maksymalny transfer danych?

Jakie jest kluczowe zadanie protokołu ICMP?

Jak najlepiej chronić zebrane dane przed dostępem w przypadku kradzieży komputera?

Urządzenie, które łączy różne segmenty sieci i przekazuje ramki pomiędzy nimi, wybierając odpowiedni port docelowy dla przesyłanych ramek, to

Jakie polecenie w systemie Linux prawidłowo ustawia kartę sieciową, przypisując adres IP oraz maskę sieci dla interfejsu eth1?

Jakie zagrożenia eliminują programy antyspyware?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Dwie stacje robocze w tej samej sieci nie mają możliwości komunikacji. Która z poniższych okoliczności może być przyczyną tego problemu?

Na ilustracji zobrazowano

Klient dostarczył wadliwy sprzęt komputerowy do serwisu. W trakcie procedury przyjmowania sprzętu, ale przed rozpoczęciem jego naprawy, serwisant powinien

Czym jest kopia różnicowa?

Do realizacji alternatywy logicznej z negacją należy użyć funktora

Jaką maksymalną ilość rzeczywistych danych można przesłać w ciągu 1 sekundy przez łącze synchroniczne o wydajności 512 kbps, bez użycia sprzętowej i programowej kompresji?

Zgodnie z normą PN-EN 50174, poziome okablowanie w systemie strukturalnym to segment okablowania pomiędzy

Na ilustracji widać

Protokół, który konwertuje nazwy domen na adresy IP, to

Aby zamontować przedstawioną kartę graficzną, potrzebna jest płyta główna posiadająca złącze

Które z kont nie jest standardowym w Windows XP?

Jaki tryb funkcjonowania Access Pointa jest wykorzystywany do umożliwienia urządzeniom bezprzewodowym łączności z przewodową siecią LAN?

Standard magistrali komunikacyjnej PCI w wersji 2.2 (Peripheral Component Interconnect) definiuje maksymalną szerokość szyny danych na

Jaką topologię fizyczną charakteryzuje zapewnienie nadmiarowych połączeń między urządzeniami sieciowymi?

Wskaż interfejsy płyty głównej widoczne na rysunku.

Partycja, na której zainstalowany jest system operacyjny, określana jest jako partycja

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

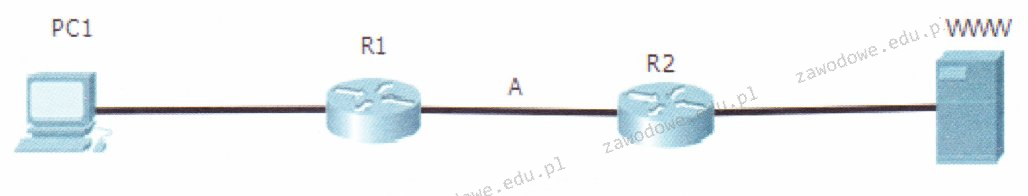

Ramka z informacjami przesyłanymi z komputera PC1 do serwera www znajduje się pomiędzy routerem R1 a routerem R2 w punkcie A). Jakie adresy są w niej zawarte?

Urządzenie sieciowe funkcjonujące w trzeciej warstwie modelu ISO/OSI, posługujące się adresami IP, to

Jakiego rodzaju plik należy stworzyć w systemie operacyjnym, aby zautomatyzować rutynowe działania, takie jak kopiowanie lub tworzenie plików oraz folderów?

Emisja przez BIOS firmy AMI jednego długiego oraz dwóch krótkich sygnałów dźwiękowych oznacza

Aby utworzyć kolejną partycję w systemie Windows, można skorzystać z narzędzia

Narzędzie służące do przechwytywania oraz ewentualnej analizy ruchu w sieci to

W sieci lokalnej, aby chronić urządzenia sieciowe przed przepięciami oraz różnicami napięć, które mogą wystąpić w trakcie burzy lub innych wyładowań atmosferycznych, należy zastosować

Na zdjęciu widoczny jest

W systemie Windows uruchomiono plik wsadowy z dwoma argumentami. Uzyskanie dostępu do wartości drugiego argumentu w pliku wsadowym jest możliwe przez

Medium transmisyjne oznaczone symbolem S/FTP wskazuje na skrętkę

Aby odzyskać dane z dysku, który został sformatowany, warto użyć programu typu

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną