Pytanie 1

Program iftop działający w systemie Linux ma na celu

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Program iftop działający w systemie Linux ma na celu

Technologia ADSL pozwala na nawiązanie połączenia DSL

Osoba korzystająca z systemu Linux, chcąc zweryfikować dysk twardy pod kątem obecności uszkodzonych sektorów, ma możliwość skorzystania z programu

PoE to norma

Jaką jednostką określa się szybkość przesyłania danych w sieciach komputerowych?

Który z adresów IPv4 jest odpowiedni do ustawienia interfejsu serwera DNS zarejestrowanego w lokalnych domenach?

Dysk znajdujący się w komputerze ma zostać podzielony na partycje. Jaką maksymalną liczbę partycji rozszerzonych można utworzyć na jednym dysku?

Standardowe napięcie zasilające dla modułów pamięci RAM DDR4 wynosi

Aby umożliwić transfer danych między dwiema odmiennymi sieciami, należy zastosować

Komputer A, który potrzebuje przesłać dane do komputera B działającego w sieci z innym adresem IP, najpierw wysyła pakiety do adresu IP

Jakie urządzenie peryferyjne komputera służy do wycinania, drukowania oraz frezowania?

Administrator sieci LAN dostrzegł przełączenie w tryb awaryjny urządzenia UPS. To oznacza, że wystąpiła awaria systemu

W celu zrealizowania instalacji sieciowej na stacjach roboczych z systemem operacyjnym Windows, należy na serwerze zainstalować usługi

W biurze rachunkowym znajduje się sześć komputerów w jednym pomieszczeniu, połączonych kablem UTP Cat 5e z koncentratorem. Pracownicy korzystający z tych komputerów muszą mieć możliwość drukowania bardzo dużej ilości dokumentów monochromatycznych (powyżej 5 tys. stron miesięcznie). Aby zminimalizować koszty zakupu i eksploatacji sprzętu, najlepszym wyborem będzie:

Jaki parametr powinien być użyty do wywołania komendy netstat, aby pokazać statystykę interfejsu sieciowego (ilość wysłanych oraz odebranych bajtów i pakietów)?

Drukarka została zainstalowana w systemie Windows. Aby ustawić między innymi domyślną orientację wydruku, liczbę stron na arkusz oraz kolorystykę, podczas jej konfiguracji należy skorzystać z opcji

Jakie jest tempo transferu danych dla napędu DVD przy prędkości x48?

Którego urządzenia z zakresu sieci komputerowych dotyczy symbol przedstawiony na ilustracji?

Nośniki informacji, takie jak dyski twarde, zapisują dane w jednostkach zwanych sektorami, które mają wielkość

Który port stosowany jest przez protokół FTP (File Transfer Protocol) do przesyłania danych?

Które stwierdzenie opisuje profil tymczasowy użytkownika?

Jakie wbudowane narzędzie w systemie Windows służy do identyfikowania problemów związanych z animacjami w grach oraz odtwarzaniem filmów?

W biurze należy zamontować 5 podwójnych gniazd abonenckich. Średnia odległość od lokalnego punktu dystrybucyjnego do gniazda abonenckiego wynosi 10m. Jaki będzie przybliżony koszt zakupu kabla UTP kategorii 5e do utworzenia sieci lokalnej, jeśli cena brutto za 1m kabla UTP kategorii 5e wynosi 1,60 zł?

Jaka licencja ma charakter zbiorowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, rządowym, charytatywnym na nabycie większej liczby programów firmy Microsoft na korzystnych warunkach?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?

Jakiego kodu numerycznego należy użyć w komendzie zmiany uprawnień do katalogu w systemie Linux, aby właściciel folderu miał prawa do zapisu i odczytu, grupa posiadała prawa do odczytu i wykonywania, a pozostali użytkownicy jedynie prawa do odczytu?

Aby przekształcić serwer w kontroler domeny w systemach Windows Server, konieczne jest użycie komendy

Licencja Windows OEM nie zezwala na wymianę

Wynikiem działania funkcji logicznej XOR na dwóch liczbach binarnych \( 1010_2 \) i \( 1001_2 \) jest czterobitowa liczba

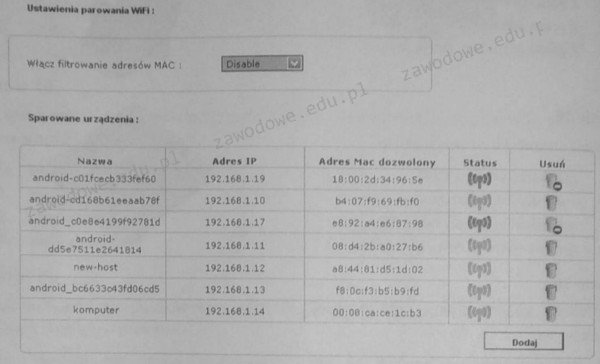

Schemat ilustruje ustawienia urządzenia WiFi. Wskaż, które z poniższych stwierdzeń na temat tej konfiguracji jest prawdziwe?

Najłatwiej zidentyfikować błędy systemu operacyjnego Windows wynikające z konfliktów sprzętowych, takich jak przydzielanie pamięci, przerwań IRQ oraz kanałów DMA, przy użyciu narzędzia

Funkcję S.M.A.R.T. w twardym dysku, która jest odpowiedzialna za nadzorowanie i wczesne ostrzeganie o możliwych awariach, można uruchomić poprzez

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?

Włączenie systemu Windows w trybie diagnostycznym umożliwia

Wyjście audio dla słuchawek lub głośników minijack na karcie dźwiękowej oznaczone jest jakim kolorem?

Jak wygląda liczba 51210) w systemie binarnym?

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Aby zapewnić największe bezpieczeństwo danych przy wykorzystaniu dokładnie 3 dysków, powinny one być zapisywane w macierzy dyskowej