Pytanie 1

Aby połączyć projektor multimedialny z komputerem, złącze, którego NIEDOZWOLONO użyć to

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Aby połączyć projektor multimedialny z komputerem, złącze, którego NIEDOZWOLONO użyć to

Transmisję danych bezprzewodowo realizuje interfejs

Przy użyciu urządzenia przedstawionego na ilustracji można sprawdzić działanie

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

W jakim miejscu są zapisane dane dotyczące kont użytkowników domenowych w systemach Windows Server?

Do jakiej warstwy modelu ISO/OSI odnosi się segmentacja danych, komunikacja w trybie połączeniowym przy użyciu protokołu TCP oraz komunikacja w trybie bezpołączeniowym z protokołem UDP?

Dysk zewnętrzny 3,5" o pojemności 5 TB, używany do archiwizacji lub wykonywania kopii zapasowych, wyposażony jest w obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów powinien być użyty do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Jaką zmianę sygnału realizuje konwerter RAMDAC?

Jaki rodzaj fizycznej topologii w sieciach komputerowych jest pokazany na ilustracji?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie narzędzie w systemie Windows służy do przeglądania informacji dotyczących problemów z systemem?

Norma EN 50167 odnosi się do systemów okablowania

Jak nazywa się jednostka przeprowadzająca obliczenia stałoprzecinkowe?

Jakie jest ciało odpowiedzialne za publikację dokumentów RFC (Request For Comments), które określają zasady rozwoju Internetu?

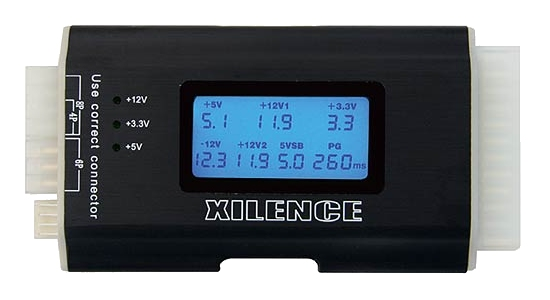

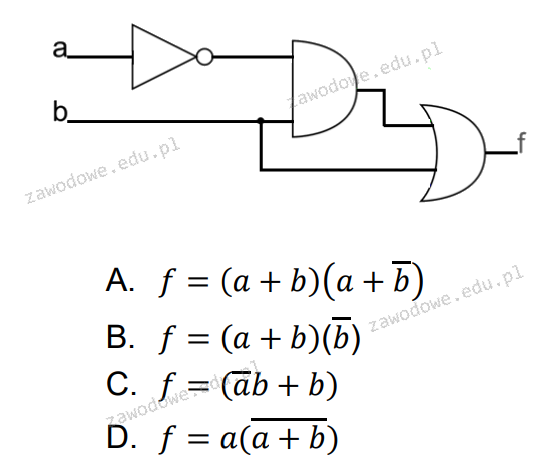

Jaką funkcję wykonuje zaprezentowany układ?

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Aby skonfigurować wolumin RAID 5 w serwerze, wymagane jest co najmniej

ARP (Adress Resolution Protocol) to protokół, który pozwala na przekształcenie adresu IP na

Który układ mikroprocesora jest odpowiedzialny między innymi za pobieranie rozkazów z pamięci oraz generowanie sygnałów sterujących?

Interfejs graficzny systemu Windows, który wyróżnia się przezroczystością przypominającą szkło oraz delikatnymi animacjami okien, nazywa się

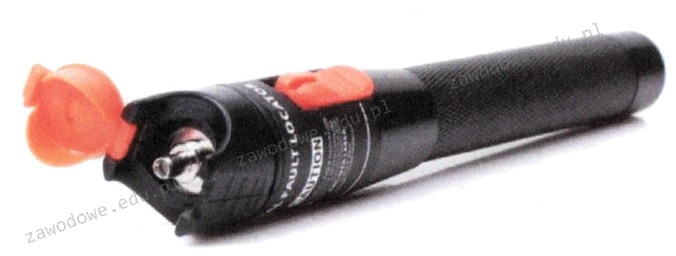

Zaprezentowane narzędzie jest wykorzystywane do

Podaj domyślny port używany do przesyłania poleceń (command) w serwerze FTP

Według normy PN-EN 50174 maksymalny rozplot kabla UTP powinien wynosić nie więcej niż

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Standard zwany IEEE 802.11, używany w lokalnych sieciach komputerowych, określa typ sieci:

Do przechowywania fragmentów dużych plików programów i danych, które nie mieszczą się w pamięci, wykorzystuje się

Jakie są skutki działania poniższego polecenia ```netsh advfirewall firewall add rule name="Open" dir=in action=deny protocol=TCP localport=53```?

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

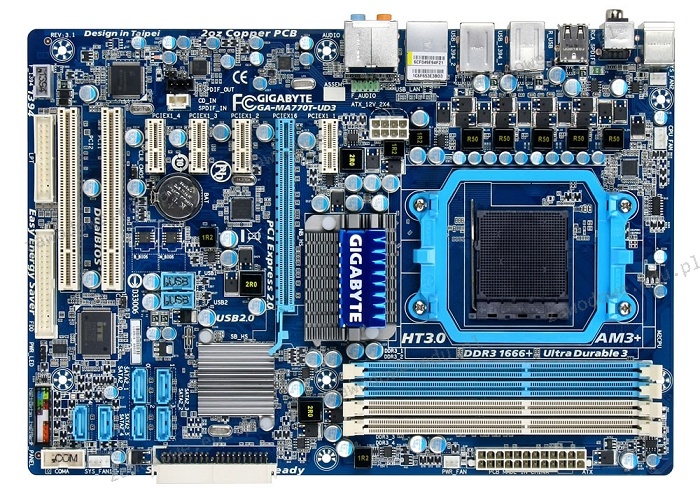

Do pokazanej na diagramie płyty głównej nie można podłączyć urządzenia, które korzysta z interfejsu

W dokumentacji płyty głównej znajduje się informacja "Wsparcie dla S/PDIF Out". Co to oznacza w kontekście tej płyty głównej?

W systemie Linux komenda ps wyświetli

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

Aby usunąć konto użytkownika student w systemie operacyjnym Ubuntu, można skorzystać z komendy

Jakie urządzenie powinno być zainstalowane w serwerze, aby umożliwić automatyczne archiwizowanie danych na taśmach magnetycznych?

Zgodnie z normą PN-EN 50174, poziome okablowanie w systemie strukturalnym to segment okablowania pomiędzy

Jakim akronimem oznacza się przenikanie bliskie skrętki teleinformatycznej?

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

Czym jest prefetching?