Pytanie 1

Podaj maksymalną liczbę hostów, które można przypisać w każdej z 8 równych podsieci, utworzonych z sieci o adresie 10.10.10.0/24.

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Podaj maksymalną liczbę hostów, które można przypisać w każdej z 8 równych podsieci, utworzonych z sieci o adresie 10.10.10.0/24.

Jeśli adres IP komputera roboczego przyjmuje formę 176.16.50.10/26, to jaki jest adres rozgłoszeniowy oraz maksymalna liczba hostów w tej sieci?

W systemie Windows odpowiednikiem macierzy RAID 1 jest wolumin o nazwie

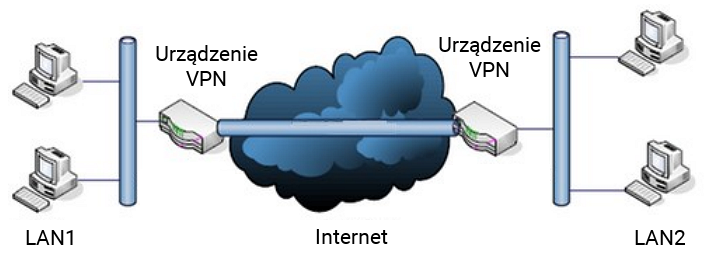

Schemat ilustruje sposób funkcjonowania sieci VPN noszącej nazwę

Na ilustracji ukazano złącze zasilające

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

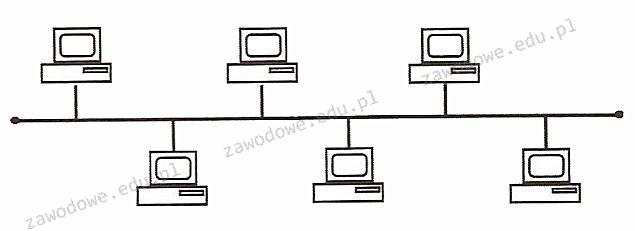

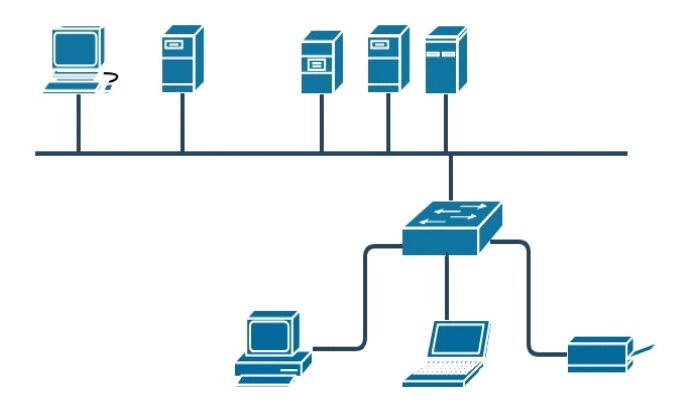

Na ilustracji ukazano sieć o układzie

Jaką operację można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, nie przechodząc do trybu uprzywilejowanego, w zakresie dostępu widocznym w ramce?

| Switch> |

Uruchomienie polecenia msconfig w systemie Windows

Oprogramowanie diagnostyczne komputera pokazało komunikat NIC ERROR. Co ten komunikat wskazuje?

Nośniki informacji, takie jak dyski twarde, zapisują dane w jednostkach zwanych sektorami, które mają wielkość

W złączu zasilania SATA uszkodzeniu uległ żółty kabel. Jakie to ma konsekwencje dla napięcia, które nie jest przesyłane?

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

Na ilustracji ukazano narzędzie systemowe w Windows 7, które jest używane do

Poprzez polecenie dxdiag uruchomione w wierszu poleceń Windows można

Na ilustracji zaprezentowano sieć komputerową w układzie

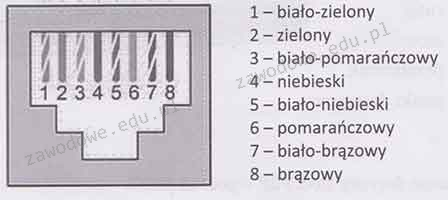

Który typ standardu zakończenia kabla w systemie okablowania strukturalnego ilustruje przedstawiony rysunek?

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

W biurze należy zamontować 5 podwójnych gniazd abonenckich. Średnia odległość od lokalnego punktu dystrybucyjnego do gniazda abonenckiego wynosi 10m. Jaki będzie przybliżony koszt zakupu kabla UTP kategorii 5e do utworzenia sieci lokalnej, jeśli cena brutto za 1m kabla UTP kategorii 5e wynosi 1,60 zł?

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

Wykonanie polecenia tar –xf dane.tar w systemie Linux spowoduje

Administrator systemu Windows zauważył znaczne spowolnienie działania komputera spowodowane niską ilością dostępnej pamięci RAM. W celu zidentyfikowania programu, który zużywa jej najwięcej, powinien skorzystać z narzędzia

W nagłówku ramki standardu IEEE 802.3 w warstwie łącza danych znajduje się

Narzędzie System Image Recovery dostępne w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

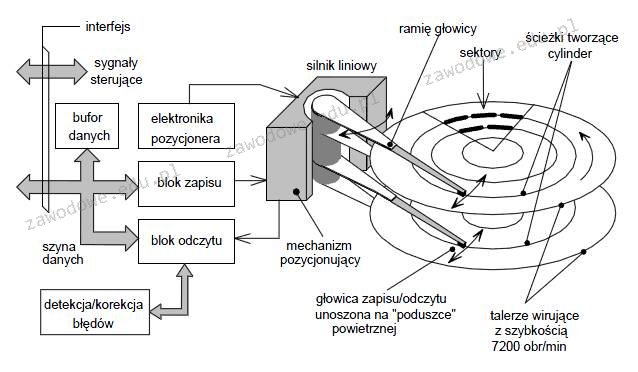

Schemat blokowy ilustruje

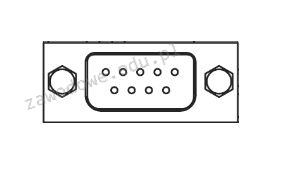

Obrazek ilustruje rodzaj złącza

Ilustracja pokazuje schemat fizycznej topologii będącej kombinacją topologii

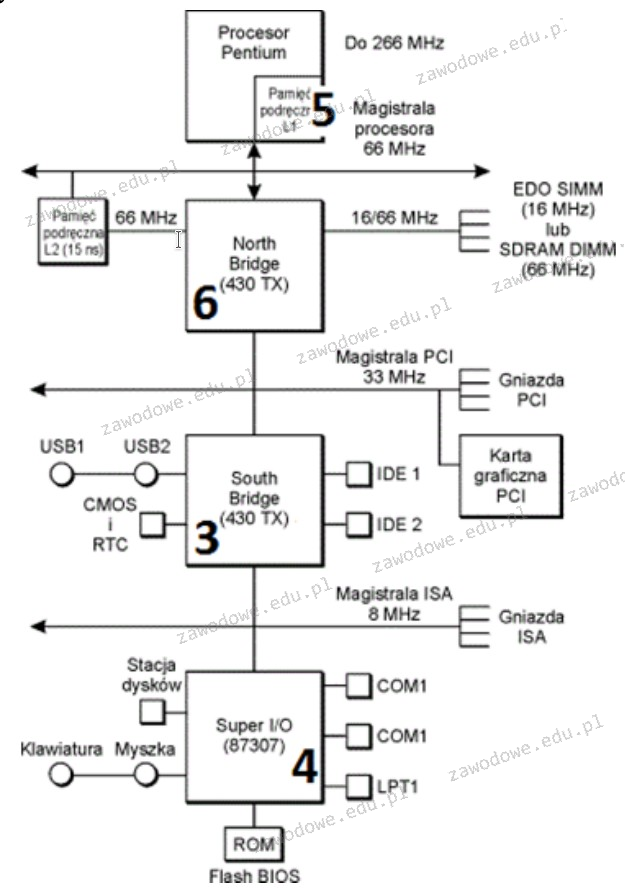

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Które z zaleceń jest nieodpowiednie dla konserwacji skanera płaskiego?

W systemie Linux przypisano uprawnienia do katalogu w formie ciągu znaków rwx--x--x. Jaką wartość liczbową te uprawnienia reprezentują?

Jakie porty powinny być odblokowane w ustawieniach firewalla na komputerze, na którym działa usługa serwera WWW?

Jaki adres IPv6 jest poprawny?

Jaką standardową wartość maksymalnej odległości można zastosować pomiędzy urządzeniami sieciowymi, które są ze sobą połączone przewodem UTP kat.5e?

W trakcie konserwacji oraz czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony osobistej

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

W komputerach obsługujących wysokowydajne zadania serwerowe, konieczne jest użycie dysku z interfejsem

Jakie polecenie w systemie Windows służy do zbadania trasy, po jakiej przesyłane są pakiety w sieci?

Aby mieć możliwość tworzenia kont użytkowników, komputerów oraz innych obiektów, a także centralnego przechowywania informacji o nich, konieczne jest zainstalowanie na serwerze Windows roli