Pytanie 1

Osoba pragnąca wydrukować dokumenty w oryginale oraz w trzech egzemplarzach na papierze samokopiującym powinna zainwestować w drukarkę

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Osoba pragnąca wydrukować dokumenty w oryginale oraz w trzech egzemplarzach na papierze samokopiującym powinna zainwestować w drukarkę

Podstawowy protokół stosowany do ustalania ścieżki oraz przesyłania pakietów danych w sieci komputerowej to

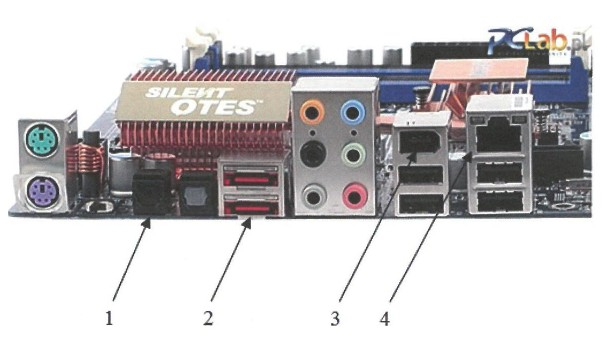

Jakie urządzenie ilustruje ten rysunek?

Komputer posiada mysz bezprzewodową, ale kursor nie porusza się gładko, tylko "skacze" na ekranie. Możliwą przyczyną problemu z urządzeniem może być

Zjawisko, w którym pliki przechowywane na dysku twardym są umieszczane w nieprzylegających do siebie klastrach, nosi nazwę

Zjawiskiem typowym, które może świadczyć o nadchodzącej awarii twardego dysku, jest wystąpienie

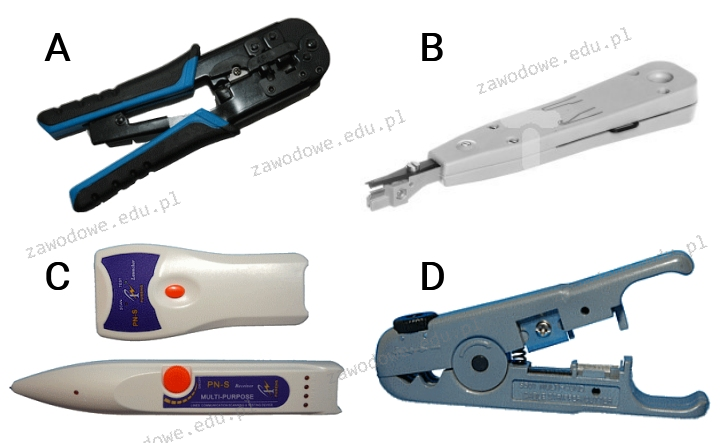

Jakie urządzenie jest używane do mocowania pojedynczych żył kabla miedzianego w złączach?

Które z wymienionych oznaczeń wskazuje, że jest to kabel typu skrętka z podwójnym ekranowaniem?

Ile punktów abonenckich (2 x RJ45) powinno być zainstalowanych w biurze o powierzchni 49 m2, zgodnie z normą PN-EN 50167?

Jakie jest wynikiem dodawania liczb binarnych 1001101 oraz 11001 w systemie dwójkowym?

Jakie czynniki nie powodują utraty danych z dysku twardego HDD?

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

Switch sieciowy w standardzie Fast Ethernet pozwala na przesył danych z maksymalną prędkością

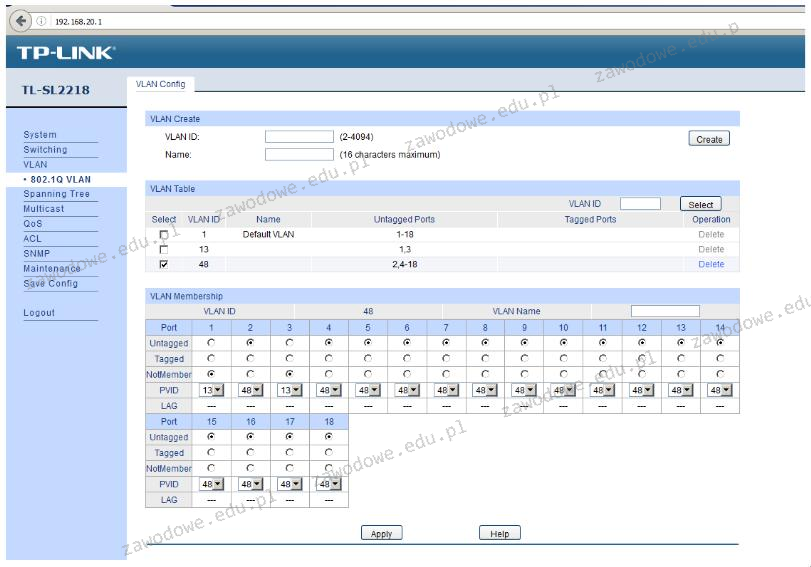

Ustawienia przedstawione na diagramie dotyczą

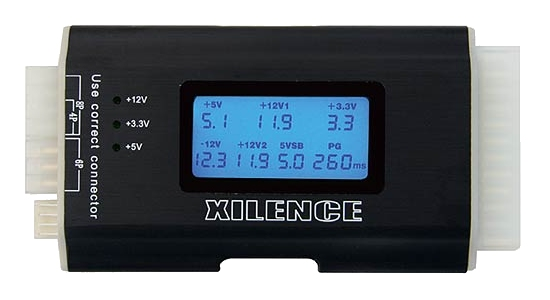

Przy użyciu urządzenia przedstawionego na ilustracji można sprawdzić działanie

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

Zużyty sprzęt elektryczny lub elektroniczny, na którym znajduje się symbol zobrazowany na ilustracji, powinien być

Największą pojemność spośród nośników optycznych posiada płyta

Jakie urządzenie sieciowe umożliwia połączenie lokalnej sieci LAN z rozległą siecią WAN?

Port AGP służy do łączenia

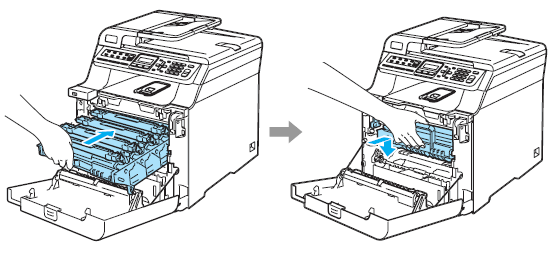

Czynność pokazana na rysunkach ilustruje mocowanie

Skaner, który został przedstawiony, należy podłączyć do komputera za pomocą złącza

W jakim typie skanera wykorzystuje się fotopowielacze?

Wskaż poprawną wersję maski podsieci?

Który z wymienionych formatów płyt głównych charakteryzuje się najmniejszymi wymiarami?

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Magistrala PCI-Express stosuje do przesyłania danych metodę komunikacji

Za pomocą przedstawionego urządzenia można przeprowadzić diagnostykę działania

Wskaż komponent, który reguluje wartość napięcia pochodzącego z sieci elektrycznej, wykorzystując transformator do przeniesienia energii między dwoma obwodami elektrycznymi z zastosowaniem zjawiska indukcji magnetycznej?

Na ilustracji zaprezentowano konfigurację urządzenia, co sugeruje, że

Który z portów znajdujących się na tylnej części komputera jest oznaczony podanym symbolem?

Który z portów na zaprezentowanej płycie głównej umożliwia podłączenie zewnętrznego dysku przez interfejs e-SATA?

Co wskazuje oznaczenie danego procesora?

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

Procesory AMD z gniazdem AM2+ będą prawidłowo funkcjonować na płycie głównej, która ma podstawkę socket

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

Ile jest klawiszy funkcyjnych na klawiaturze w układzie QWERTY?