Pytanie 1

Który z poniższych mechanizmów zagwarantuje najwyższy poziom ochrony w sieciach bezprzewodowych opartych na standardzie 802.11n?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Który z poniższych mechanizmów zagwarantuje najwyższy poziom ochrony w sieciach bezprzewodowych opartych na standardzie 802.11n?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakim akronimem oznacza się przenikanie bliskie skrętki teleinformatycznej?

Jaki wydruk w systemie rodziny Linux uzyskamy po wprowadzeniu komendy

dr-x------ 2 root root 0 lis 28 12:39 .gvfs -rw-rw-r-- 1 root root 361016 lis 8 2012 history.dat -rw-r--r-- 1 root root 97340 lis 28 12:39 .ICEauthority drwxrwxr-x 5 root root 4096 paź 7 2012 .icedtea drwx------ 3 root root 4096 cze 27 18:40 .launchpadlib drwxr-xr-x 3 root root 4096 wrz 2 2012 .local

Jakie protokoły są właściwe dla warstwy internetowej w modelu TCP/IP?

Na diagramie zaprezentowano strukturę

Jaka usługa, opracowana przez firmę Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Podstawowym warunkiem archiwizacji danych jest

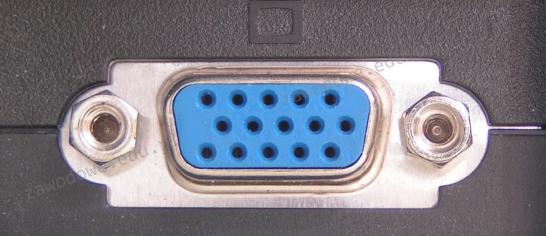

Złącze widoczne na ilustracji służy do podłączenia

Standard IEEE 802.11b dotyczy sieci

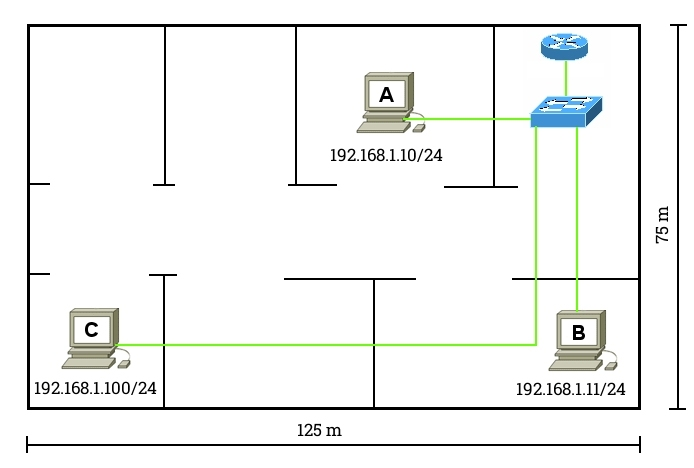

Na schemacie pokazano sieć LAN wykorzystującą okablowanie kategorii 6. Stacja robocza C nie może nawiązać połączenia z siecią. Jaki problem warstwy fizycznej może być przyczyną braku komunikacji?

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Który z wymienionych protokołów jest szyfrowanym protokołem do zdalnego dostępu?

W systemie Linux komenda ps wyświetli

Jeśli rozdzielczość myszy wynosi 200dpi, a monitor ma rozdzielczość Full HD, to aby przesunąć kursor wzdłuż ekranu, należy przesuń mysz o

Która z licencji na oprogramowanie wiąże je trwale z zakupionym komputerem i nie pozwala na przenoszenie praw użytkowania programu na inny komputer?

Jakie oprogramowanie jest wykorzystywane do kontrolowania stanu dysków twardych?

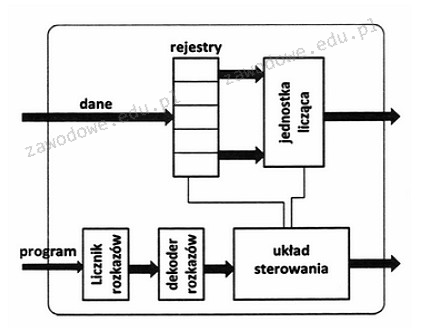

Na schemacie procesora rejestry mają za zadanie przechowywać adres do

W technologii Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP podłączone do pinów:

Do instalacji i usuwania oprogramowania w systemie Ubuntu wykorzystywany jest menedżer

Aby uzyskać informacje na temat aktualnie działających procesów w systemie Linux, można użyć polecenia

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

Jakiej klasy adresów IPv4 dotyczą adresy, które mają dwa najbardziej znaczące bity ustawione na 10?

Urządzenie warstwy dystrybucji, które umożliwia komunikację pomiędzy różnymi sieciami, to

Thunderbolt to interfejs

Jaki parametr powinien być użyty do wywołania komendy netstat, aby pokazać statystykę interfejsu sieciowego (ilość wysłanych oraz odebranych bajtów i pakietów)?

Jakie polecenie w systemie Linux rozpoczyna weryfikację dysku oraz pozwala na usunięcie jego usterek?

Jakie polecenie należy użyć w wierszu poleceń systemu Windows, aby utworzyć nowy katalog?

System S.M.A.R.T. jest wykorzystywany do nadzorowania działania oraz identyfikacji usterek

Kluczowe znaczenie przy tworzeniu stacji roboczej dla wielu wirtualnych maszyn ma

Rezultatem wykonania przedstawionego fragmentu skryptu jest:

#!/bin/sh mkdir kat1 touch kat1/plik.txt

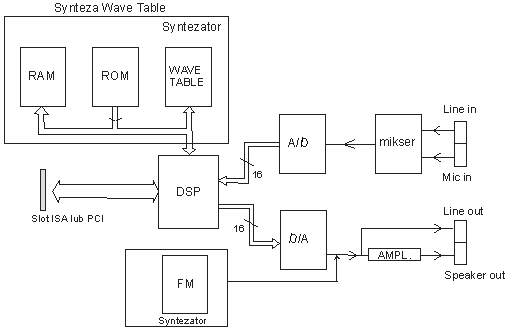

Który z elementów przedstawionych na diagramie karty dźwiękowej na rysunku jest odpowiedzialny za cyfrowe przetwarzanie sygnałów?

Standard IEEE 802.11b dotyczy typu sieci

Jakiego narzędzia należy użyć do zakończenia końcówek kabla UTP w module keystone z złączami typu 110?

W projekcie sieci komputerowej przewiduje się użycie fizycznych adresów kart sieciowych. Która warstwa modelu ISO/OSI odnosi się do tych adresów w komunikacji?

Grupa, w której członkom można nadawać uprawnienia jedynie w obrębie tej samej domeny, co domena nadrzędna lokalnej grupy domeny, nosi nazwę grupa

Jakie znaczenie ma skrót MBR w kontekście technologii komputerowej?

Na zdjęciu pokazano złącza

Który z wymienionych parametrów procesora AMD APU A10 5700 3400 nie ma bezpośredniego wpływu na jego wydajność?

| Częstotliwość | 3400 MHz |

| Proces technologiczny | 32 nm |

| Architektura | 64 bit |

| Ilość rdzeni | 4 |

| Ilość wątków | 4 |

| Pojemność pamięci L1 (instrukcje) | 2x64 kB |

| Pojemność pamięci L1 (dane) | 4x16 kB |

| Pojemność Pamięci L2 | 2x2 MB |

W systemie SI jednostką do mierzenia napięcia jest