Pytanie 1

Jakie urządzenie powinno być użyte do podłączenia komputerów, aby mogły działać w różnych domenach rozgłoszeniowych?

Wynik: 12/40 punktów (30,0%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie powinno być użyte do podłączenia komputerów, aby mogły działać w różnych domenach rozgłoszeniowych?

Urządzenie z funkcją Plug and Play, które zostało ponownie podłączone do komputera, jest identyfikowane na podstawie

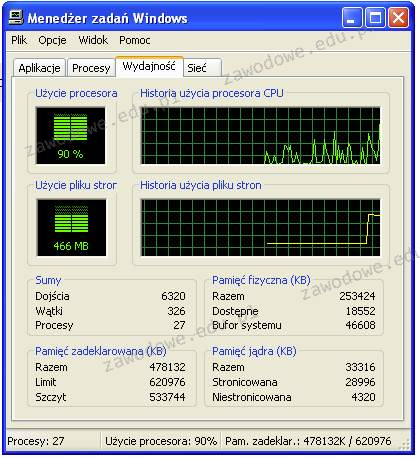

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

W schemacie logicznym struktury okablowania, zgodnie z polską terminologią zawartą w normie PN-EN 50174, cechą kondygnacyjnego punktu dystrybucyjnego jest to, że

Który z protokołów służy do synchronizacji czasu?

W biurze rachunkowym znajduje się sześć komputerów w jednym pomieszczeniu, połączonych kablem UTP Cat 5e z koncentratorem. Pracownicy korzystający z tych komputerów muszą mieć możliwość drukowania bardzo dużej ilości dokumentów monochromatycznych (powyżej 5 tys. stron miesięcznie). Aby zminimalizować koszty zakupu i eksploatacji sprzętu, najlepszym wyborem będzie:

Po przeprowadzeniu eksportu klucza HKCR zostanie utworzona kopia rejestru, zawierająca dane dotyczące konfiguracji

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

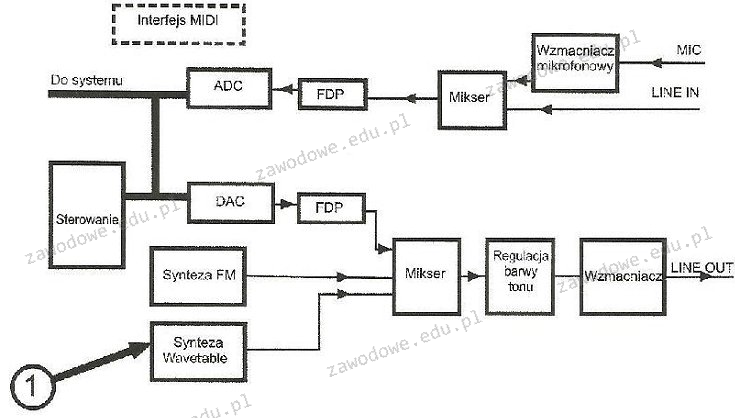

Element wskazany cyfrą 1 na diagramie karty dźwiękowej?

Na które wyjście powinniśmy podłączyć aktywne głośniki w karcie dźwiękowej, której schemat przedstawiony jest na rysunku?

W przypadku dysku twardego, w jakiej jednostce wyrażana jest wartość współczynnika MTBF (Mean Time Between Failure)?

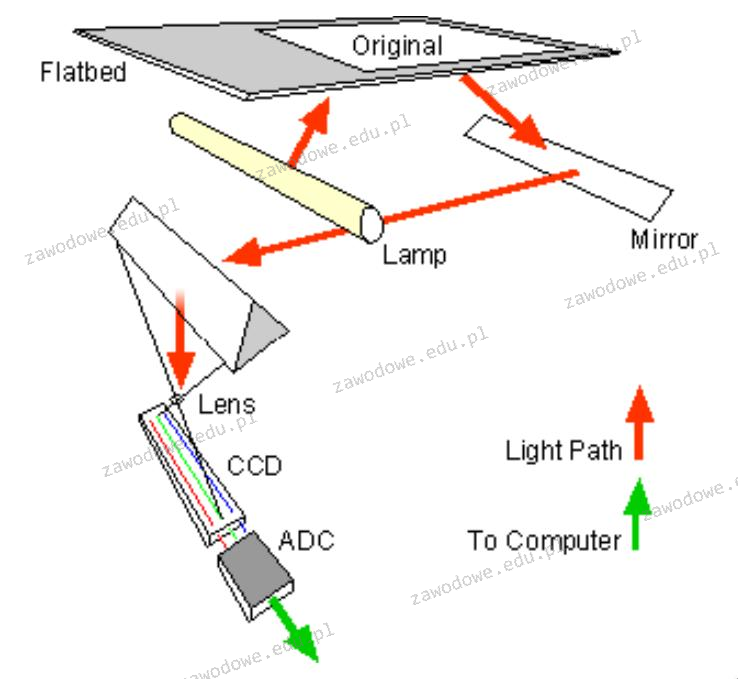

Rysunek obrazuje zasadę działania drukarki

Komputer wyposażony w BIOS firmy Award wygenerował komunikat o treści Primary/Secondary master/slave hard disk fail. Komunikat ten może oznaczać konieczność wymiany

Jaki rodzaj fizycznej topologii w sieciach komputerowych jest pokazany na ilustracji?

Aby zredukować kluczowe zagrożenia związane z bezpieczeństwem podczas pracy na komputerze podłączonym do sieci Internet, należy przede wszystkim

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W instrukcji obsługi karty dźwiękowej można znaleźć następujące dane: - częstotliwość próbkowania wynosząca 22 kHz, - rozdzielczość wynosząca 16 bitów. Jaką przybliżoną objętość będzie miało mono jednokanałowe nagranie dźwiękowe trwające 10 sekund?

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku

Jaką sumę należy zapłacić za wymianę karty graficznej w komputerze, jeżeli cena karty wynosi 250 zł, a czas wymiany przez pracownika serwisu to 80 minut, przy czym każda rozpoczęta godzina pracy kosztuje 50 zł?

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

Według KNR (katalogu nakładów rzeczowych) montaż 4-parowego modułu RJ45 oraz złącza krawędziowego to 0,07 r-g, natomiast montaż gniazd abonenckich natynkowych wynosi 0,30 r-g. Jak wysoki będzie koszt robocizny za zamontowanie 10 pojedynczych gniazd natynkowych z modułami RJ45, jeśli wynagrodzenie godzinowe montera-instalatora wynosi 20,00 zł?

W systemie Linux, aby wyszukać wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i zaczynają się na literę a lub literę b lub literę c, należy wydać polecenie

Wskaż cechę platformy wirtualizacji Hyper-V.

W systemach Linux, aby wprowadzić nowe repozytorium, należy wykorzystać komendy

Jaką liczbę warstw określa model ISO/OSI?

Który z podanych programów pozwoli na stworzenie technicznego rysunku ilustrującego plan instalacji logicznej sieci lokalnej w budynku?

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Cienki klient (thin client) to?

Ile sieci obejmują komputery z adresami IP przedstawionymi w tabeli oraz standardową maską sieci?

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Jaki rodzaj routingu jest najbardziej odpowiedni w dużych, szybko zmieniających się sieciach?

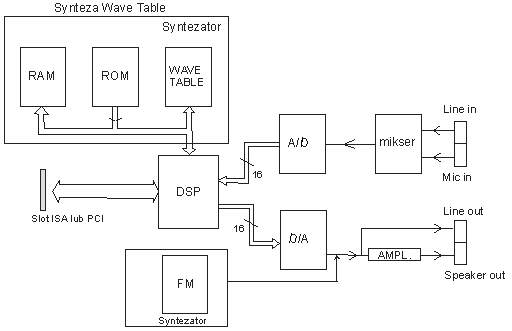

Ilustrowany schemat obrazuje zasadę funkcjonowania

Zasilacz UPS o mocy rzeczywistej 480 W nie jest przeznaczony do podłączenia

W systemie Linux, aby wyświetlić informację o nazwie bieżącego katalogu roboczego, należy zastosować polecenie

Czym jest patchcord?

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

Zanim przystąpimy do prac serwisowych dotyczących modyfikacji rejestru systemu Windows, konieczne jest wykonanie

Jak wiele domen kolizyjnych oraz rozgłoszeniowych można dostrzec na schemacie?

Który protokół odpowiada za bezpieczne przesyłanie danych w sieciach komputerowych?