Pytanie 1

Element drukujący, składający się z wielu dysz połączonych z mechanizmem drukującym, znajduje zastosowanie w drukarce

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Element drukujący, składający się z wielu dysz połączonych z mechanizmem drukującym, znajduje zastosowanie w drukarce

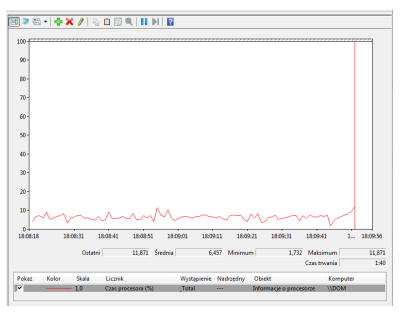

Aby zainicjować w systemie Windows oprogramowanie do monitorowania wydajności komputera przedstawione na ilustracji, należy otworzyć

Na ilustracji widoczny jest symbol graficzny

Przy zgrywaniu filmu kamera cyfrowa przesyła na dysk 220 MB na minutę. Wybierz z diagramu interfejs o najniższej prędkości transferu, który umożliwia taką transmisję

Adware to program komputerowy

Złocenie styków złącz HDMI ma na celu

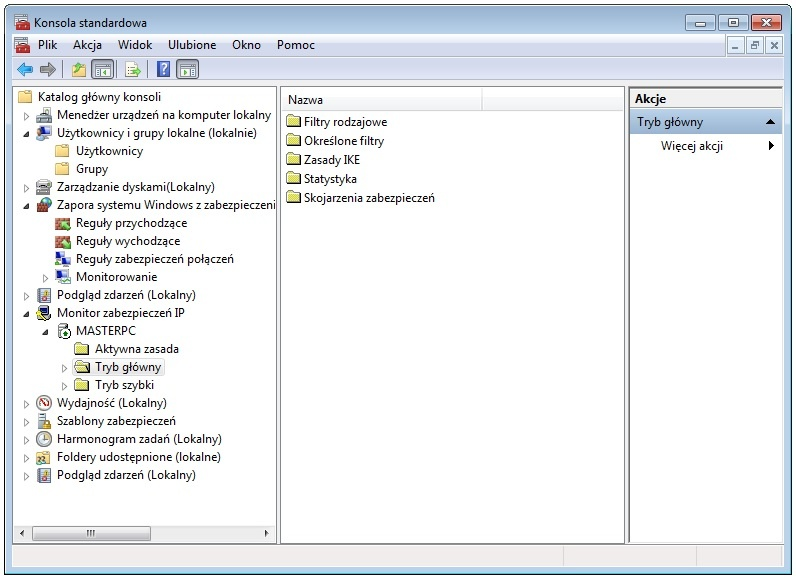

Okno narzędzia przedstawionego na ilustracji można uzyskać poprzez wykonanie polecenia

Niskopoziomowe formatowanie dysku IDE HDD polega na

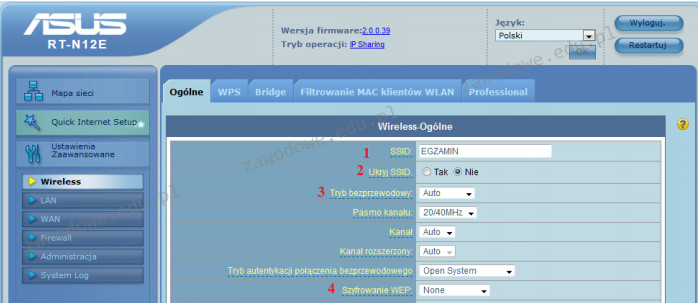

Aby zatuszować identyfikator sieci bezprzewodowej, należy zmodyfikować jego ustawienia w ruterze w polu oznaczonym numerem

Aby chronić sieć WiFi przed nieautoryzowanym dostępem, należy między innymi

Sprzętem, który umożliwia wycinanie wzorów oraz grawerowanie w różnych materiałach, takich jak drewno, szkło i metal, jest ploter

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

Jaka liczba hostów może być zaadresowana w podsieci z adresem 192.168.10.0/25?

Cena wydruku jednej strony tekstu wynosi 95 gr, a koszt wykonania jednej płyty CD to 1,54 zł. Jakie wydatki poniesie firma, tworząc płytę z prezentacjami oraz poradnik liczący 120 stron?

Jaka usługa, opracowana przez firmę Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie urządzenie służy do pomiaru wartości mocy zużywanej przez komputerowy zestaw?

W czterech różnych sklepach ten sam model komputera oferowany jest w różnych cenach. Gdzie można go kupić najtaniej?

Kluczowy sposób zabezpieczenia danych w sieci komputerowej przed nieautoryzowanym dostępem to

Jakim protokołem komunikacyjnym w warstwie transportowej, który zapewnia niezawodność przesyłania pakietów, jest protokół

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

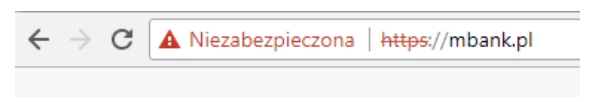

Zidentyfikuj powód pojawienia się komunikatu, który został pokazany na ilustracji

W jakiej technologii produkcji projektorów stosowany jest system mikroskopijnych luster, przy czym każde z nich odpowiada jednemu pikselowi wyświetlanego obrazu?

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Liczba 5110 w zapisie binarnym wygląda jak

W jakiej topologii fizycznej sieci każde urządzenie ma dokładnie dwa połączenia, jedno z najbliższymi sąsiadami, a dane są przesyłane z jednego komputera do kolejnego w formie pętli?

Graficzny symbol pokazany na ilustracji oznacza

Narzędziem do zarządzania usługami katalogowymi w systemach Windows Server, które umożliwia przeniesienie komputerów do jednostki organizacyjnej wskazanej przez administratora, jest polecenie

Standardowo, w systemie Linux, twardy dysk w standardzie SATA jest oznaczany jako

Notacja #102816 oznacza zapis w systemie liczbowym

Jak na diagramach sieciowych LAN oznaczane są punkty dystrybucyjne znajdujące się na różnych kondygnacjach budynku, zgodnie z normą PN-EN 50173?

W sieciach bezprzewodowych Ad-Hoc (Independent Basic Service Set) wykorzystywana jest fizyczna struktura

Protokół, który zajmuje się identyfikowaniem i usuwaniem kolizji w sieciach Ethernet, to

Narzędzie chroniące przed nieautoryzowanym dostępem do lokalnej sieci, to

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

Protokół kontrolny z rodziny TCP/IP, który odpowiada między innymi za identyfikację usterek w urządzeniach sieciowych, to

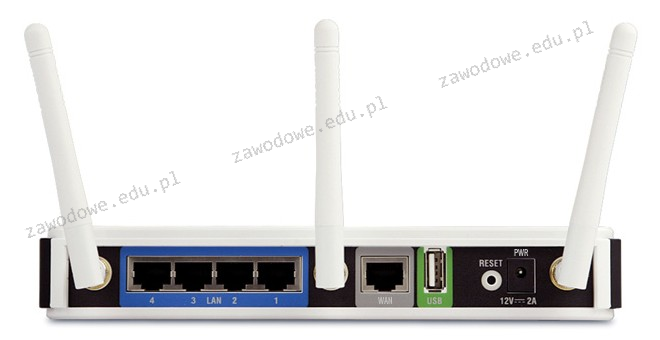

Do jakiego portu należy podłączyć kabel sieciowy zewnętrzny, aby uzyskać pośredni dostęp do sieci Internet?

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

Które dwa urządzenia sieciowe CISCO wyposażone w moduły z portami smart serial można połączyć przy użyciu kabla szeregowego?