Pytanie 1

Sekwencja 172.16.0.1, która reprezentuje adres IP komputera, jest zapisana w systemie

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Sekwencja 172.16.0.1, która reprezentuje adres IP komputera, jest zapisana w systemie

Czym są programy GRUB, LILO, NTLDR?

Co robi polecenie Gpresult?

Użytkownik systemu Windows doświadcza problemów z niewystarczającą pamięcią wirtualną. Jak można temu zaradzić?

Podczas skanowania reprodukcji obrazu z czasopisma, na skanie obrazu pojawiły się regularne wzory, tak zwana mora. Z jakiej funkcji skanera należy skorzystać, aby usunąć morę?

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Ustawienia przedstawione na diagramie dotyczą

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wynikiem działania funkcji logicznej XOR na dwóch liczbach binarnych \( 1010_2 \) i \( 1001_2 \) jest czterobitowa liczba

Kluczowy sposób zabezpieczenia danych w sieci komputerowej przed nieautoryzowanym dostępem to

Jaki protokół mailowy pozwala między innymi na przechowywanie odbieranych wiadomości e-mail na serwerze, zarządzanie wieloma katalogami, usuwanie wiadomości oraz przenoszenie ich pomiędzy katalogami?

Jaką rolę pełni usługa NAT działająca na ruterze?

W jakim systemie występuje jądro hybrydowe (kernel)?

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

Instalacja systemów Linux oraz Windows 7 przebiegła bez problemów. Oba systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, o tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Jak nazywa się topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub przełącznik?

Komputer powinien działać jako serwer w sieci lokalnej, umożliwiając innym komputerom dostęp do Internetu poprzez podłączenie do gniazda sieci rozległej za pomocą kabla UTP Cat 5e. Na chwilę obecną komputer jest jedynie połączony ze switchem sieci lokalnej również kablem UTP Cat 5e oraz nie dysponuje innymi portami 8P8C. Jakiego komponentu musi on koniecznie nabrać?

Jaką sumę należy zapłacić za wymianę karty graficznej w komputerze, jeżeli cena karty wynosi 250 zł, a czas wymiany przez pracownika serwisu to 80 minut, przy czym każda rozpoczęta godzina pracy kosztuje 50 zł?

Protokół Datagramów Użytkownika (UDP) należy do kategorii

Które z podanych poleceń w systemie Windows XP umożliwia sprawdzenie aktualnej konfiguracji adresu IP systemu Windows?

W systemie Windows, aby udostępnić folder jako ukryty, należy na końcu nazwy udostępniania umieścić znak

Jakie jest tworzywo eksploatacyjne w drukarce laserowej?

Podczas testowania kabla sieciowego zakończonego wtykami RJ45 przy użyciu diodowego testera okablowania, diody LED zapalały się w odpowiedniej kolejności, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły równocześnie na jednostce głównej testera, natomiast na jednostce zdalnej nie świeciły wcale. Jaka mogła być tego przyczyna?

Jakie urządzenie pracuje w warstwie łącza danych i umożliwia integrację segmentów sieci o różnych architekturach?

Jednym z programów stosowanych do tworzenia kopii zapasowych partycji oraz dysków jest

W przypadku dłuższego nieużytkowania drukarki atramentowej, pojemniki z tuszem powinny

Podczas wyboru zasilacza do komputera kluczowe znaczenie

Switch sieciowy w standardzie Fast Ethernet pozwala na przesył danych z maksymalną prędkością

Użytkownik systemu Windows wybrał opcję powrót do punktu przywracania. Które pliki powstałe po wybranym punkcie nie zostaną naruszone przez tę akcję?

Urządzenie z funkcją Plug and Play, które zostało ponownie podłączone do komputera, jest identyfikowane na podstawie

Partycja w systemie Linux, która tymczasowo przechowuje dane w przypadku niedoboru pamięci RAM, to

Jakie zastosowanie ma narzędzie tracert w systemach operacyjnych rodziny Windows?

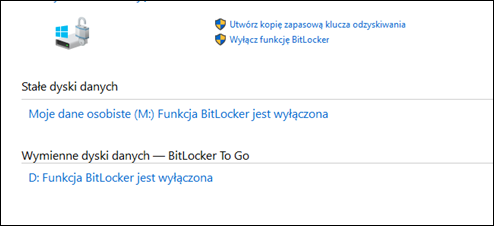

Przedstawione wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate służy do

W systemie Windows, po wydaniu komendy systeminfo, nie da się uzyskać danych o

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

Substancją używaną w drukarkach 3D jest

Na ilustracji pokazano interfejs w komputerze dedykowany do podłączenia

Programem wykorzystywanym w systemie Linux do odtwarzania muzyki jest

Jakie urządzenie sieciowe zostało pokazane na diagramie sieciowym?