Pytanie 1

Czym jest prefetching?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Czym jest prefetching?

Który z materiałów eksploatacyjnych nie jest stosowany w ploterach?

Jest to najnowsza edycja klienta wieloplatformowego, docenianego przez użytkowników na całym świecie, serwera wirtualnej sieci prywatnej, umożliwiającego nawiązanie połączenia między hostem a komputerem lokalnym, obsługującego uwierzytelnianie z wykorzystaniem kluczy, certyfikatów, nazwy użytkownika oraz hasła, a także, w wersji dla Windows, dodatkowych zakładek. Który z programów został wcześniej opisany?

Która z konfiguracji RAID opiera się na replikacji danych pomiędzy dwoma lub większą liczbą dysków fizycznych?

Co oznacza określenie średni czas dostępu w dyskach twardych?

Który z poniższych interfejsów komputerowych stosuje transmisję równoległą do przesyłania danych?

Co umożliwia zachowanie równomiernego rozkładu ciepła pomiędzy procesorem a radiatorem?

Licencja oprogramowania open source oraz wolnego, to rodzaj licencji

Lista sprzętu kompatybilnego z systemem operacyjnym Windows, publikowana przez firmę Microsoft to

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Który protokół umożliwia rozproszoną wymianę i ściąganie plików?

W systemie Windows przypadkowo zlikwidowano konto użytkownika, lecz katalog domowy pozostał nietknięty. Czy możliwe jest odzyskanie nieszyfrowanych danych z katalogu domowego tego użytkownika?

Który protokół umożliwia zarządzanie wieloma folderami pocztowymi oraz pobieranie i operowanie na listach znajdujących się na zdalnym serwerze?

W systemie Windows do wyświetlenia treści pliku tekstowego służy polecenie

W trakcie użytkowania przewodowej myszy optycznej wskaźnik nie reaguje na ruch urządzenia po podkładce, a kursor zmienia swoje położenie dopiero po właściwym ustawieniu myszy. Te symptomy sugerują uszkodzenie

Na ilustracji widoczna jest pamięć operacyjna

Aby uzyskać adres IPv4, za pomocą usługi DHCP, komputer kliencki wysyła żądania z portu

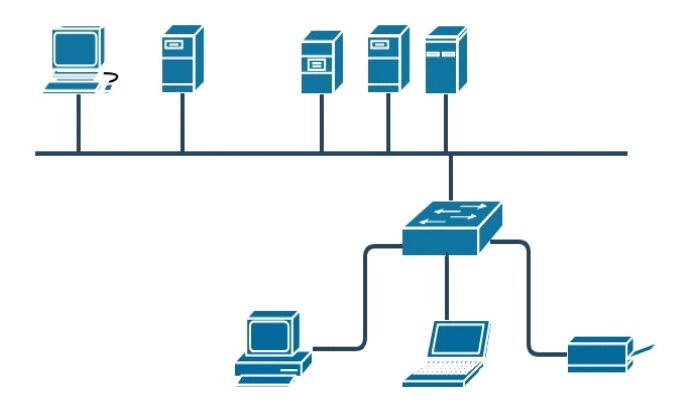

Ilustracja pokazuje schemat fizycznej topologii będącej kombinacją topologii

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

DB-25 służy jako złącze

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i centralnie gromadzić o nich informacje, należy zainstalować rolę na serwerze Windows

Jakie polecenie służy do obserwowania lokalnych połączeń?

Który standard Gigabit Ethernet pozwala na tworzenie segmentów sieci o długości 550 m lub 5000 m przy prędkości transmisji 1 Gb/s?

W jaki sposób powinno się wpisać w formułę arkusza kalkulacyjnego odwołanie do komórki B3, aby przy przenoszeniu tej formuły w inne miejsce arkusza odwołanie do komórki B3 pozostało stałe?

Adres projektowanej sieci należy do klasy C. Sieć została podzielona na 4 podsieci, z 62 urządzeniami w każdej z nich. Która z poniżej wymienionych masek jest adekwatna do tego zadania?

Jaką normę stosuje się w przypadku okablowania strukturalnego w sieciach komputerowych?

Które z poniższych twierdzeń na temat protokołu DHCP jest poprawne?

Którego z poniższych zadań nie wykonują serwery plików?

Jakim symbolem powinien być oznaczony sprzęt komputerowy, aby spełniał wymogi prawne konieczne do sprzedaży w Unii Europejskiej?

W dokumentacji jednego z komponentów komputera zamieszczono informację, że to urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

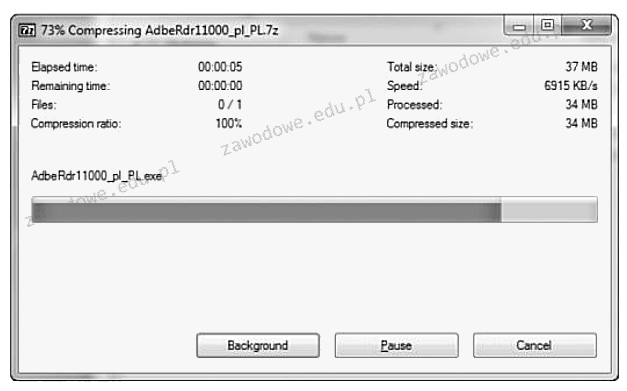

Na dołączonym obrazku pokazano działanie

Dane z HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

Jakie narzędzie jest używane do zarządzania alokacjami dyskowymi w systemach Windows 7 i Windows 8?

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma możliwości uruchomienia systemu operacyjnego, ponieważ brakuje dysku twardego oraz napędów optycznych, a system operacyjny uruchamia się z lokalnej sieci. W celu odzyskania utraconej funkcjonalności należy zainstalować w komputerze

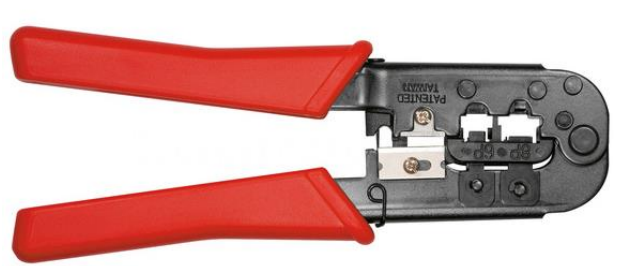

Jakie kable powinny być używane z narzędziem pokazanym na fotografii?

W systemie Linux do monitorowania użycia procesora, pamięci, procesów i obciążenia systemu służy polecenie

Jakie urządzenie umożliwia testowanie strukturalnego okablowania światłowodowego?

Po zainstalowaniu Systemu Windows 7 dokonano zmiany w BIOS-ie komputera, skonfigurowano dysk SATA z AHCI na IDE. Po ponownym uruchomieniu systemu komputer będzie

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie