Pytanie 1

Jaki jest standardowy dystans administracyjny używany w protokole OSPF (ang. Open Shortest Path First)?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Jaki jest standardowy dystans administracyjny używany w protokole OSPF (ang. Open Shortest Path First)?

W jakich jednostkach wyraża się zysk energetyczny anteny w porównaniu do dipola półfalowego?

Technologia ATM (Asynchronous Transfer Mode) realizuje komutację

W systemie GPON (Gigabit Passive Optical Networks) maksymalne wartości przepustowości są ustalone dla połączeń.

Jaką rozdzielczość ma przetwornik A/C, który konwertuje próbkę sygnału na jedną z 1024 wartości liczbowych?

Koncentrator (ang. hub) jest urządzeniem

Która technika archiwizacji polega na przechowywaniu w pamięci komputera plików, które zostały zmodyfikowane od czasu ostatniej pełnej kopii zapasowej?

Który aplet w panelu sterowania systemów Windows służy do przeglądania historii aktualizacji?

Jaką antenę należy zastosować do przesyłania fal radiowych na duże dystanse, aby osiągnąć maksymalny zasięg?

Który protokół routingu jest używany do wymiany danych dotyczących dostępności sieci pomiędzy autonomicznymi systemami?

Zakładka Advanced Chipset Features lub Chipset Features Setup w BIOS-ie umożliwia

Jakie rozwiązanie należy zastosować, aby zabezpieczyć spaw lub złącze światłowodowe w studni kablowej na ścianie lub lince nośnej przed wpływem niekorzystnych warunków atmosferycznych oraz mechanicznymi uszkodzeniami?

Który protokół rutingu wykorzystuje algorytm Dijkstry do obliczania najkrótszej ścieżki, tzw. najlepszej trasy, do sieci docelowych?

Tabela przedstawia parametry

| ITEM | DOWNSTREAM (RECEIVER) | UPSTREAM (TRANSMITTER) | |||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|

| Frequency Range | 88MHz ~ 860MHz | 5MHz ~ 42MHz | |||||||||

| Channel Bandwidth | DOCSIS: 6MHz | 200K, 400K, 800K, 1.6M, 3.2MHz | |||||||||

| Modulation | 64QAM/256QAM | QPSK/16QAM | |||||||||

| Symbol Rate | 5.057/5.361 Msymbols/sec | 160, 320, 640, 1280, 2560 Ksymbols/sec | |||||||||

| Data Rate | 30Mbits/sec (64QAM) 43Mbits/sec (256QAM) | 0.32 ~ 5.12Mbs (QPSK) 0.64 ~ 10.24Mbs (16QAM) | |||||||||

| Input Output Power | -15dBmV ~ +15dBmV | +8dBmV ~ +58dBmV (QPSK) +8dBmV ~ +55dBmV (16QAM) | |||||||||

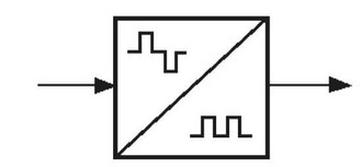

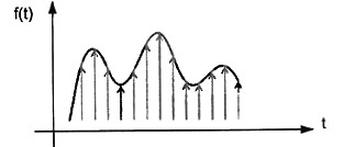

| Carrier To Noise Ratio @BER<10 -8 64QAM: 23.5dB, 256QAM: 30dB | RF Cable Interface | 75Ω F-type female connector | PC Host Interface | Ethernet or USB cable | Power Dissipation | < 6 Watts | A. centrali telefonicznej. B. przełącznika sieciowego. C. krosownicy. D. modemu kablowego. Wybór odpowiedzi związanych z krosownicą, centralą telefoniczną lub przełącznikiem sieciowym może wynikać z nieprawidłowego zrozumienia roli tych urządzeń w sieci. Krosownica to urządzenie używane do łączenia różnych kabli, umożliwiające elastyczne tworzenie połączeń między różnymi urządzeniami, jednak nie ma związku z parametrami transmisji danych w kontekście modemów kablowych. Centrala telefoniczna, z drugiej strony, obsługuje połączenia głosowe, a nie dane internetowe, co sprawia, że nie zawiera parametrów dotyczących szerokości kanału czy modulacji, które są kluczowe dla modemów kablowych. Przełącznik sieciowy jest odpowiedzialny za zarządzanie ruchem w sieci lokalnej, ale także nie zajmuje się bezpośrednio sygnałem kablowym ani jego modulacją, co czyni go niewłaściwym wyborem w kontekście zadania. Typowe błędy myślowe obejmują mylenie funkcji tych urządzeń oraz nieodpowiednie przypisanie im parametrów, które są charakterystyczne jedynie dla modemów kablowych, co sugeruje brak zrozumienia ich podstawowych ról oraz właściwych zastosowań w architekturze sieciowej. Wiedza na temat standardów, takich jak DOCSIS, jest kluczowa przy rozważaniu, jakie urządzenia są odpowiednie w danym kontekście, a także jakie parametry są istotne dla określonych zastosowań sieciowych. Pytanie 15Złącze DVI-i w komputerze używane jest do podłączenia A. joysticka B. głośników C. monitora D. drukarki Złącze DVI-I jest specyficznie zaprojektowane do przesyłania sygnału wideo, co wyklucza jego zastosowanie w przypadku głośników, joysticków czy drukarek. Głośniki wymagają złącza audio, takiego jak jack 3,5 mm lub złącze USB, a ich funkcjonalność opiera się na przesyłaniu dźwięku, a nie obrazu. Joysticki, z drugiej strony, są urządzeniami peryferyjnymi stosowanymi głównie w grach i symulacjach, które korzystają z różnych typów złączy, takich jak USB, a nie złączy wideo. Drukarki natomiast komunikują się z komputerem za pomocą interfejsów takich jak USB, Ethernet czy Wi-Fi, a nie przez złącza wideo. Prawdopodobnym błędem myślowym przy wyborze odpowiedzi może być założenie, że jakiekolwiek złącze komputerowe może być używane do różnych urządzeń peryferyjnych. Jednakże, każdy typ złącza ma swoje specjalizacje i zastosowania, co jest kluczowe dla skutecznego działania sprzętu komputerowego. Zrozumienie właściwego użycia złączy jest fundamentalne dla zapewnienia efektywności i wydajności w pracy z komputerem oraz jego akcesoriami. Pytanie 16W dzisiejszych smartfonach używa się baterii A. litowo-jonowo-polimerowe B. kwasowo-ołowiowe C. niklowo-kadmowe D. niklowo-metalowo-wodorowe Akumulatory litowo-jonowo-polimerowe (Li-Po) są obecnie najczęściej stosowanym typem akumulatorów w nowoczesnych telefonach komórkowych. Charakteryzują się one wysoką gęstością energii, co oznacza, że mogą przechowywać dużą ilość energii w stosunkowo niewielkiej objętości. Ponadto, akumulatory te są lekkie i mają elastyczną konstrukcję, co pozwala na ich dopasowanie do różnych kształtów urządzeń. Dzięki zastosowaniu technologii litowo-jonowej, akumulatory te cechują się także niskim efektem pamięci, co pozwala na ich ładowanie w dowolnym momencie bez obawy o degradację pojemności. To czyni je idealnym rozwiązaniem dla urządzeń mobilnych, które wymagają częstego ładowania. Standardy takie jak UN 38.3 dotyczące transportu akumulatorów litowych oraz IEC 62133 dotyczące ich bezpieczeństwa, zapewniają, że akumulatory te są produkowane zgodnie z najwyższymi normami bezpieczeństwa i wydajności. W praktyce, akumulatory Li-Po są wykorzystywane nie tylko w telefonach, ale również w laptopach, tabletach i dronach, co świadczy o ich wszechstronności i niezawodności. Pytanie 17Impuls wysłany do jednorodnej linii transmisyjnej powrócił po odbiciu od jej końca po czasie 100 μs. Jaka jest długość linii, jeśli prędkość propagacji sygnału w linii wynosi 2 · 108 m/s? A. 20 km B. 10 km C. 5 km D. 50 km Niepoprawne odpowiedzi na to pytanie mogą wynikać z niepełnego zrozumienia zależności między czasem, prędkością i długością drogi, co jest kluczowe w telekomunikacji. Na przykład, odpowiedzi wskazujące długość 5 km lub 20 km mogłyby sugerować, że uczestnik nie uwzględnił faktu, że czas 100 μs dotyczy zarówno drogi do końca linii, jak i powrotu. W takim przypadku, obliczenia powinny uwzględniać, że całość drogi przebywa impuls – co oznacza, że otrzymany wynik należy podzielić przez dwa. Ponadto, błędne odpowiedzi jak 50 km mogą być wynikiem użycia niewłaściwego przeliczenia czasu na długość, np. nieprawidłowego przeliczenia jednostek. Kluczowym błędem myślowym jest pominięcie faktu, że czas, w którym impuls wraca, podwaja długość linii. W inżynierii telekomunikacyjnej, zrozumienie tych podstawowych zasad jest niezbędne do prawidłowego projektowania i diagnostyki linii transmisyjnych. Zasady te mają zastosowanie w praktyce, np. w obliczeniach potrzebnych do określenia wydajności systemów komunikacyjnych oraz w testowaniu długości kabli w instalacjach sieciowych. Pytanie 18Wskaż adres IP prywatnej klasy A. A. 172.16.0.5 B. 7.15.0.5 C. 10.168.0.5 D. 192.168.0.5 Odpowiedzi 172.16.0.5, 7.15.0.5 oraz 192.168.0.5 zawierają pewne nieporozumienia dotyczące klasyfikacji adresów IP. Adres 172.16.0.5, chociaż jest adresem prywatnym, należy do klasy B, a nie klasy A. Adresy prywatne klasy B mieszczą się w zakresie 172.16.0.0 do 172.31.255.255. W związku z tym, choć jest to adres prywatny, nie spełnia on kryteriów dotyczących klasy A. Kolejna odpowiedź, 7.15.0.5, jest adresem publicznym, ponieważ nie należy do żadnego z zarezerwowanych zakresów adresów prywatnych (RFC 1918), co oznacza, że może być routowany w Internecie. Wykorzystywanie takich adresów w sieci lokalnej może prowadzić do konfliktów i problemów z dostępnością. Z kolei adres 192.168.0.5 jest adresem prywatnym klasy C, a jego zakres obejmuje 192.168.0.0 do 192.168.255.255. W praktyce, typowym błędem jest mylenie klas adresowych na podstawie ich wartości, co prowadzi do niewłaściwego doboru adresów w sieciach lokalnych. Warto pamiętać, że każda klasa adresowa ma swoje specyficzne zakresy i przeznaczenie, a ich błędne użycie może wpływać na wydajność oraz bezpieczeństwo sieci. Zrozumienie tych różnic jest kluczowe w procesie projektowania oraz zarządzania adresacją w sieciach komputerowych, co pozwala uniknąć problemów związanych z kolizjami adresów oraz nieefektywnym wykorzystaniem zasobów adresowych. Pytanie 19Aby stacje podłączone do routera mogły automatycznie otrzymać konfigurację sieciową (np. adres IP, adres bramy), należy w tym samym segmencie sieci, gdzie znajdują się stacje oraz router, zainstalować i uruchomić serwer A. FTP B. DHCP C. HTTP D. DNS Odpowiedź DHCP (Dynamic Host Configuration Protocol) jest prawidłowa, ponieważ ten protokół jest odpowiedzialny za automatyczne przydzielanie adresów IP oraz innych ustawień sieciowych stacjom podłączonym do sieci lokalnej. DHCP pozwala na centralne zarządzanie adresacją IP, co znacząco upraszcza konfigurację sieci, zwłaszcza w środowiskach z dużą liczbą urządzeń. Gdy stacja (np. komputer lub drukarka) łączy się z siecią, wysyła zapytanie DHCP, a serwer DHCP przydziela jej dostępny adres IP oraz inne parametry, takie jak adres bramy i serwera DNS. Dzięki temu nie ma potrzeby ręcznego konfigurowania każdego urządzenia, co zmniejsza ryzyko błędów konfiguracyjnych. W praktyce, serwery DHCP są powszechnie stosowane w biurach, sieciach domowych oraz dużych centrum danych, gdzie dynamiczne zarządzanie adresami IP jest kluczowe dla sprawności działania sieci. Protokół DHCP jest zgodny ze standardami IETF i stosuje się go w większości nowoczesnych systemów operacyjnych oraz urządzeń sieciowych. Pytanie 20W systemach telefonicznych funkcja LCR (Least Cost Routing) jest wykorzystywana do A. zablokowania numeru dzwoniącego B. wyboru najkorzystniejszej ścieżki połączeniowej C. włączenia naliczania sekundowego D. wyświetlania numeru dzwoniącego Funkcja LCR (Least Cost Routing) w centralach telefonicznych ma na celu optymalizację kosztów połączeń telefonicznych poprzez wybór najtańszej drogi połączeniowej dla danej rozmowy. W praktyce oznacza to, że system analizuje dostępne trasy komunikacyjne oraz ich koszty, co pozwala na automatyczny wybór najbardziej ekonomicznej opcji, zanim połączenie zostanie nawiązane. Przykładowo, jeśli użytkownik dzwoni do kraju X, LCR może wybrać z różnych operatorów ten, który oferuje najniższe stawki za połączenia międzynarodowe do tego kraju. Takie podejście nie tylko pozwala zaoszczędzić na rachunkach telefonicznych, ale także zwiększa efektywność zarządzania połączeniami w firmach. W zależności od złożoności systemu LCR, może on także uwzględniać różne czynniki, takie jak czas połączenia, rodzaj usługi (stacjonarna lub mobilna) oraz bieżące promocje operatorów. Zastosowanie LCR jest zgodne z najlepszymi praktykami branżowymi, kiedy to organizacje dążą do optymalizacji kosztów komunikacyjnych oraz poprawy jakości usług. Warto zaznaczyć, że wdrożenie LCR wymaga odpowiednich narzędzi zarządzających oraz stałego monitorowania rynku telekomunikacyjnego, aby móc reagować na zmiany w ofertach operatorów. Pytanie 21Zjawisko, które polega na modyfikacji częstotliwości analogowego sygnału nośnego w zależności od zmian amplitudy analogowego sygnału informacyjnego, nosi nazwę modulacja A. FM B. AM C. PAM D. PCM Modulacja AM, czyli modulacja amplitudy, to proces, gdzie zmienia się amplituda fali nośnej w odpowiedzi na sygnał informacyjny. Kiedyś była popularna, ale teraz nie jest najlepszym wyborem, bo jest strasznie wrażliwa na zakłócenia i szumy. Wspomniana modulacja PAM, czyli Pulse Amplitude Modulation, zmienia amplitudę impulsów, ale to nie jest to samo, co modulacja częstotliwości. PAM zazwyczaj pojawia się w systemach cyfrowych, ale nie ma związku z pytaniem o częstotliwość. PCM, czyli Pulse Code Modulation, to technika, która przekształca sygnał analogowy w cyfrowy, ale też nie dotyczy bezpośrednio tego, o co pytamy. Często popełniane błędy to mylenie modulacji amplitudy z częstotliwością lub mieszanie technik cyfrowych, które nie pasują do definicji w pytaniu. Warto pamiętać, że wybór odpowiedniej techniki modulacji jest szalenie ważny dla jakości i stabilności przesyłanych informacji, dlatego dobrze jest znać te koncepcje w telekomunikacji. Pytanie 22Który z poniższych komunikatów nie jest obecny w pierwotnej wersji protokołu zarządzania siecią SNMPv1 (Simple Network Management Protocol)? A. Trap B. Response C. Get D. Inform Zrozumienie komunikatów w protokole SNMPv1 jest kluczowe dla skutecznego zarządzania siecią. Pomimo pewnych mylnych przekonań, komunikaty takie jak 'Inform', 'Response', 'Trap' oraz 'Get' odgrywają różne role i mają różne zastosowania. 'Response' jest odpowiedzią na zapytania menedżera, a z kolei 'Trap' jest używany do przesyłania powiadomień o zdarzeniach bezpośrednio do menedżera, co pozwala na natychmiastową reakcję na problemy. Przykładowo, gdy urządzenie wykryje awarię, wysyła 'Trap' do menedżera, informując go o tym zdarzeniu. Z kolei 'Get' umożliwia menedżerowi zbieranie informacji z agentów w czasie rzeczywistym. Przy tym ważne jest, aby nie mylić tych komunikatów z 'Inform', który wprowadzony został dopiero w późniejszych wersjach SNMP, takich jak SNMPv2. Typowe błędy w myśleniu mogą wynikać z pomylenia komunikatów asynchronicznych i synchronicznych oraz ich zastosowania w różnych kontekstach zarządzania. Zrozumienie tych różnic jest kluczowe dla efektywnego korzystania z narzędzi monitorujących oraz zarządzających w sieciach. Pytanie 23Przedstawiony symbol graficzny oznacza  A. wzmacniacz. B. transkoder. C. sumator. D. rozgałęźnik. Przedstawiony symbol graficzny oznacza transkoder, co jest kluczowym elementem w procesie przetwarzania sygnałów w różnych systemach audio-wideo. Transkoder to urządzenie, które konwertuje sygnał z jednego formatu na inny, co jest niezbędne w kontekście zarządzania różnorodnością formatów stosowanych w nowoczesnych systemach multimedialnych. Na przykład, w przypadku przesyłania sygnałów wideo z kamery do systemu obróbki, transkoder może przekształcić sygnał z formatu RAW na MPEG-4, co umożliwia jego dalsze przetwarzanie i kompresję. Dzięki transkoderom możliwe jest również dostosowanie jakości obrazu oraz dźwięku do różnych warunków transmisji, co jest szczególnie istotne w transmisjach na żywo, gdzie jakość sygnału ma kluczowe znaczenie. W praktyce stosuje się transkodery w różnych aplikacjach, takich jak streaming online, archiwizacja materiałów wideo oraz w systemach telekomunikacyjnych, co podkreśla ich znaczenie w branży. Dobrą praktyką jest również dbanie o optymalizację procesów transkodowania, aby zminimalizować straty jakości oraz opóźnienia w przesyłaniu sygnału. Pytanie 24W trakcie wykonywania procedury POST na monitorze pojawił się komunikat FailingBits: nnnn. Na tej podstawie użytkownik może wnioskować, że A. płyta główna nie ma wbudowanego kontrolera dla dysków twardych SATA B. dysk twardy nie jest podłączony do portu interfejsu C. pamięć operacyjna uległa fizycznemu uszkodzeniu D. układ pamięci tylko do odczytu podstawowego systemu BIOS jest uszkodzony Rozważając inne odpowiedzi, warto zauważyć, że pierwsza z nich sugeruje, iż dysk twardy nie jest podłączony do kanału interfejsu. Taki problem mógłby prowadzić do komunikatu o błędzie podczas uruchamiania systemu, jednak <i>FailingBits: nnnn</i> bezpośrednio odnosi się do testów pamięci, a nie do stanu dysku twardego. W kontekście drugiej odpowiedzi, stwierdzenie, że płyta główna nie posiada kontrolera dysków twardych SATA, również nie ma sensu. Tego rodzaju problem zainicjowałby inne typy błędów, a nie błędy pamięci. Z kolei czwarta odpowiedź, dotycząca uszkodzenia układu pamięci tylko do odczytu (ROM), jest mylna, ponieważ ROM i RAM pełnią różne funkcje w systemie. ROM przechowuje stałe informacje, takie jak BIOS, natomiast RAM jest odpowiedzialna za tymczasowe przechowywanie danych podczas działania systemu. Problemy z RAM są często mylone z innymi komponentami, ale kluczowym wskaźnikiem, jakim jest komunikat <i>FailingBits</i>, wskazuje wprost na uszkodenia pamięci operacyjnej. Takie myślenie może prowadzić do błędnych diagnoz i niepotrzebnych kosztów związanych z wymianą komponentów, które nie są uszkodzone. Zrozumienie, jakie komponenty odpowiadają za jakie błędy, jest kluczowe dla efektywnej diagnostyki problemów sprzętowych. Pytanie 25Jak określane są oprogramowania, które nie wymagają instalacji? A. Sniffer B. Firewall C. Benchmark D. Portable Odpowiedź "Portable" odnosi się do programów, które można uruchomić bez konieczności ich instalacji na systemie operacyjnym. Tego rodzaju aplikacje są szczególnie cenne w sytuacjach, gdy użytkownicy potrzebują mobilności i elastyczności, na przykład podczas pracy na różnych komputerach lub w warunkach ograniczonego dostępu do systemu. Programy portable są często wykorzystywane w administracji systemów oraz w sytuacjach, gdy zachowanie prywatności jest kluczowe, gdyż nie pozostawiają śladów w rejestrze systemowym ani nie ingerują w konfigurację systemu operacyjnego. Przykłady programów portable to przeglądarki internetowe, edytory tekstu, a także narzędzia do zarządzania plikami. W kontekście najlepszych praktyk, używanie programów portable to również sposób na minimalizowanie ryzyka związanego z złośliwym oprogramowaniem, ponieważ można je uruchamiać z zewnętrznych nośników, które są łatwo skanowane przed użyciem. Pytanie 26W systemach operacyjnych z rodziny Windows program chkdsk jest wykorzystywany do A. przywracania danych usuniętych z dysku B. lokalizowania plików na dysku C. usuwania niepotrzebnych plików D. sprawdzenia integralności systemu plików na dysku Program chkdsk (Check Disk) jest narzędziem systemowym w systemach operacyjnych Windows, które służy do analizy i naprawy problemów ze spójnością systemu plików oraz uszkodzeniami na dyskach twardych i innych nośnikach danych. Kiedy uruchamiamy chkdsk, sprawdza on struktury systemu plików, takie jak katalogi i sektory na dysku, aby zidentyfikować błędy, które mogą prowadzić do utraty danych. Użytkownicy często korzystają z chkdsk, gdy system operacyjny zgłasza błędy przy uruchamianiu lub podczas korzystania z dysku. Program może również naprawić niektóre zidentyfikowane problemy, co jest szczególnie istotne w kontekście dobrych praktyk zarządzania danymi i systemami. Regularne używanie chkdsk jest zalecane, aby utrzymać zdrowie systemu plików oraz zapobiegać poważniejszym awariom. Warto również dodać, że narzędzie to można uruchomić w trybie awaryjnym lub z poziomu wiersza poleceń, co czyni je elastycznym rozwiązaniem w sytuacjach kryzysowych. Pytanie 27Przedstawiany na rysunku etap procesu modulacji impulsowo-kodowej nosi nazwę  A. próbkowania. B. kwantyzacji. C. filtrowania. D. kodowania. Wybór odpowiedzi innej niż próbkowanie wskazuje na nieporozumienie dotyczące podstawowych etapów procesu modulacji impulsowo-kodowej. Filtrowanie, jako samodzielny proces, ma na celu usunięcie niepożądanych komponentów sygnału, ale nie jest to pierwszy etap modulacji. W kontekście PCM, filtrowanie może być stosowane po próbkowaniu, aby zredukować aliasing, jednak nie można go zidentyfikować jako etapu, który bezpośrednio przekształca sygnał analogowy na cyfrowy. Kwantyzacja, z drugiej strony, odnosi się do przypisywania wartości dyskretnych do ciągłych wartości sygnału po etapie próbkowania, co jest niezbędne w procesie kodowania, ale nie jest to sama procedura próbkowania. Kodowanie to ostatni etap, w którym cyfrowe wartości kwantyzowane są przekształcane w ciąg bitów do transmisji lub przechowywania. Typowym błędem myślowym w tym przypadku jest mylenie tych różnych etapów przetwarzania sygnału, co może prowadzić do nieprawidłowej analizy i implementacji systemów PCM. Kluczowe jest zrozumienie, że każdy z tych procesów ma swoje unikalne miejsce w łańcuchu przetwarzania, a zrozumienie tego jest niezbędne do poprawnej pracy z sygnałami zarówno w obszarze telekomunikacji, jak i technologii audio. Pytanie 28Jak nazywa się proces, w którym zawartość i-tej szczeliny czasowej z wejściowego strumienia PCM jest umieszczana w j-tej szczelinie czasowej w strumieniu wyjściowym PCM? A. Komutacja szczelinowa B. Komutacja czasowa C. Komutacja kanałowa D. Komutacja przestrzenna Wybór odpowiedzi, która odnosi się do komutacji przestrzennej, kanałowej czy szczelinowej, może wydawać się logiczny, ale każda z tych koncepcji ma swoje specyficzne znaczenie i zastosowanie, które różnią się od komutacji czasowej. Komutacja przestrzenna, na przykład, polega na przesyłaniu danych za pomocą różnych fizycznych ścieżek w infrastrukturze telekomunikacyjnej, co pozwala na równoległe przesyłanie wielu sygnałów. W praktyce oznacza to, że różne rozmowy lub dane mogą być przesyłane jednocześnie, ale w różnych kanałach, co może prowadzić do złożonych potrzeb w zakresie zarządzania pasmem i synchronizacji. Komutacja kanałowa natomiast odnosi się do metod, w których różne źródła danych są przekazywane przez zdefiniowane kanały komunikacyjne. Chociaż może to przypominać komutację czasową, to jednak nie uwzględnia ona dynamicznego przydziału szczelin czasowych dla różnych strumieni, co jest kluczowe w komutacji czasowej. Komutacja szczelinowa, z drugiej strony, najczęściej odnosi się do metod, w których dane są przesyłane w określonych szczelinach czasowych, ale niekoniecznie oznacza to przenoszenie danych z jednego strumienia na inny, jak ma to miejsce w przypadku komutacji czasowej. Typowym błędem myślowym jest utożsamianie tych różnych rodzajów komutacji, co prowadzi do nieporozumień w kontekście ich zastosowania w rzeczywistych systemach telekomunikacyjnych. Zrozumienie tych subtelności jest kluczowe dla inżynierów i specjalistów w dziedzinie telekomunikacji, którzy muszą projektować i implementować systemy skutecznej komunikacji. Pytanie 29Algorytm rotacyjny (Round Robin) polega na przydzieleniu na każdy dzień tygodnia jednego dysku do zapisywania kopii zapasowej. Dyski mają oznaczenia: poniedziałek, wtorek, środa, czwartek, piątek, sobota, niedziela. Każdego dnia na przypisany dysk jest zapisywana pełna kopia wszystkich danych przeznaczonych do kopiowania. Jaki jest maksymalny czas, w jakim zaprezentowana metoda tworzenia kopii zapasowych pozwala na odzyskanie danych? A. Tygodnia B. Miesiąca C. Dnia D. Kwartału Wybór innych odpowiedzi może wynikać z nieporozumienia odnośnie do mechanizmu działania algorytmu karuzelowego. W przypadku 'dnia' maksymalny odstęp między kopiami wynosiłby jedynie 24 godziny, co w wielu sytuacjach może okazać się niewystarczające. Utrata danych może nastąpić w wyniku awarii systemu bądź błędów użytkownika, a 24 godziny to zbyt krótki czas na skuteczną ochronę danych. Odpowiedź 'miesiąca' sugeruje, że kopie zapasowe byłyby wykonywane raz na miesiąc, co w praktyce narażałoby dane na znaczące ryzyko utraty, zwłaszcza w przypadku intensywnego użytkowania systemu. W kontekście 'kwartału', okres ten byłby jeszcze bardziej niebezpieczny dla integralności danych, a jakiekolwiek zmiany w systemie mogłyby prowadzić do braku aktualnych informacji przez długi czas. Rekomendowane praktyki w zakresie tworzenia kopii zapasowych, zgodne z regulacjami takimi jak ISO 27001, podkreślają znaczenie regularnych i częstych kopii zapasowych, aby zminimalizować ryzyko utraty danych. Kluczowym błędem myślowym jest przekonanie, że rzadsze tworzenie kopii jest wystarczające; jednak w środowisku, gdzie dane mogą być dynamicznie zmieniane, niezbędna jest regularna ochrona, co czyni algorytm karuzelowy ze strategią tygodniową najbardziej odpowiednim rozwiązaniem. Pytanie 30W teorii linii długiej można wyróżnić impedancję falową Zf oraz impedancję obciążenia Zobc. Linia długa jest poprawnie dopasowana falowo (nie występują w niej odbicia) w sytuacji, gdy: A. Zf = 0 B. Zf < Zobc C. Zf > Zobc D. Zf = Zobc Kiedy rozważamy kwestie związane z dopasowaniem impedancji w liniach długich, odpowiedzi inne niż Zf = Zobc prowadzą do poważnych nieporozumień. Wybierając Zf = 0, zakładamy, że linia jest otwarta, co oznacza, że nie ma możliwości propagacji fal. Taki stan nie może być zrealizowany w praktyce, ponieważ wymagałoby to, aby linia była całkowicie pozbawiona impedancji, co jest sprzeczne z zasadami teorii elektromagnetyzmu. W przypadku Zf > Zobc, fala napotka na obciążeniu impedancję, która jest mniejsza od impedancji falowej, co spowoduje odbicie fali w kierunku źródła. Taki stan prowadzi do strat mocy i może spowodować niepożądane zjawiska w systemie, takie jak zniekształcenia sygnału. Z kolei Zf < Zobc prowadzi do sytuacji odwrotnej, gdzie fala napotyka na wyższą impedancję. Ponownie, odbicie fali ma miejsce, co jest niekorzystne dla efektywności systemu. W praktyce, aby uniknąć tych problemów, inżynierowie i projektanci systemów stosują różne techniki dopasowania impedancji, takie jak stosowanie transformatorów lub obwodów LC, które umożliwiają osiągnięcie Zf = Zobc. Podejścia te są zgodne z normami branżowymi, które promują efektywny transfer energii i minimalizację strat wynikających z nieodpowiedniego dopasowania. Pytanie 31Która z wymienionych czynności sprawi, że system operacyjny nie będzie odpowiednio zabezpieczony, mimo zainstalowanego oprogramowania antywirusowego? A. Aktywowanie automatycznych aktualizacji bazy wirusów B. Nadzorowanie systemu w czasie rzeczywistym C. Przeprowadzanie szybkiego skanowania nie częściej niż raz w miesiącu D. Realizowanie pełnego skanowania systemu plików co najmniej raz dziennie Wykonywanie szybkiego skanowania co najwyżej raz w miesiącu jest niewystarczające, aby zapewnić skuteczną ochronę systemu operacyjnego. Takie skanowanie zazwyczaj koncentruje się tylko na najbardziej oczywistych zagrożeniach, podczas gdy złośliwe oprogramowanie może ukrywać się w mniej oczywistych miejscach. Ponadto, wirusy i inne zagrożenia mogą zmieniać swoje zachowanie i metody działania, co sprawia, że sporadyczne skanowanie nie jest wystarczające. Praktyka sugeruje, że zaleca się przeprowadzanie pełnych skanowań systemu co najmniej raz w tygodniu oraz korzystanie z funkcji monitorowania w czasie rzeczywistym, aby błyskawicznie wykrywać i neutralizować zagrożenia. Regularne aktualizacje bazy wirusów również są kluczowe, ponieważ nowe zagrożenia pojawiają się nieustannie. Zastosowanie tych zasad w codziennej praktyce IT przyczynia się do znacznego zwiększenia poziomu bezpieczeństwa systemu. Pytanie 32Czym zajmuje się regenerator cyfrowy? A. jedynie wzmacnia i poprawia formę sygnału B. filtruje oraz wzmacnia sygnał C. tylko modyfikuje kształt oraz parametry czasowe sygnału D. wzmacnia i optymalizuje kształt oraz parametry czasowe sygnału Niektóre z zaproponowanych odpowiedzi nie oddają pełnego zakresu funkcji, jakie pełni regenerator cyfrowy. Wzmacnianie sygnału bez poprawy jego kształtu oraz parametrów czasowych jest niewystarczające, ponieważ zniekształcenia sygnału mogą prowadzić do błędów w transmisji danych. Z kolei stwierdzenie, że regenerator 'tylko' poprawia kształt oraz parametry czasowe sygnału, pomija kluczowy aspekt wzmacniania, które jest niezbędne do przywrócenia sygnału do odpowiedniego poziomu. Istnieją także koncepcje, które wskazują na filtrację sygnału jako główną rolę regeneratora, co jest mylące, ponieważ filtracja jest jedynie etapem w procesie regeneracji. Regeneratory cyfrowe nie tylko filtrują sygnał, ale również analizują jego parametry i korygują wszelkie zniekształcenia, co nie jest odzwierciedlone w tych odpowiedziach. Często mylone jest także pojęcie wzmacniania z prostym zwiększeniem sygnału, podczas gdy w praktyce wymaga to skomplikowanej analizy oraz złożonych algorytmów, które uwzględniają m.in. szumy i zakłócenia. Właściwe zrozumienie funkcji regeneratora cyfrowego jest kluczowe dla projektowania i utrzymania efektywnych systemów komunikacyjnych. Pytanie 33Aby umożliwić wymianę informacji sygnalizacyjnych między centralami różnych operatorów, konieczny jest aktualnie system sygnalizacji A. R2 B. SS7 C. R1 D. S11 System sygnalizacji SS7 to naprawdę ważny standard w telekomunikacji. Dzięki niemu różni operatorzy mogą wymieniać sobie informacje, co jest mega istotne, zwłaszcza przy zestawianiu połączeń czy wysyłaniu SMS-ów. Co ciekawe, SS7 oparty jest na architekturze pakietowej, co ułatwia przesyłanie sygnałów przez różne sieci, niezależnie od używanej technologii. W praktyce, SS7 przydaje się w różnorodnych sytuacjach, takich jak przełączanie połączeń głosowych czy oferowanie dodatkowych usług, jak identyfikacja numeru dzwoniącego. W branży telekomunikacyjnej SS7 to podstawa, co sprawia, że każdy operator powinien go znać, żeby zapewnić sprawną wymianę i niezawodność usług. Pytanie 34Jakiego działania nie realizują programowe analizatory sieciowe? A. Naprawiania spójności danych B. Analizowania wydajności sieci w celu identyfikacji wąskich gardeł C. Przekształcania binarnych pakietów na format zrozumiały dla ludzi D. Identyfikowania źródeł ataków Wybór tych odpowiedzi, które sugerują działania programowych analizatorów sieci, może być trochę mylący, bo niektóre z nich nie do końca oddają ich funkcję. Analiza wydajności sieci, żeby dostrzegać wąskie gardła, to bardzo ważny aspekt tych narzędzi. Dzięki temu admini mogą zidentyfikować problemy z przepustowością czy opóźnieniami. Współczesne systemy monitorowania, jak NetFlow czy sFlow, skupiają się głównie na detekcji i analizie ruchu, co pozwala lepiej zarządzać infrastrukturą sieciową. Oczywiście, wykrywanie źródeł ataków, jak DDoS, jest w ich zakresie działania. Używają różnych technik, żeby analizować zachowanie użytkowników i porównywać to z wcześniejszymi wzorcami. Na koniec, konwersja pakietów binarnych na formę czytelną dla ludzi to ważna cecha monitorujących, bo to pomaga lepiej zrozumieć ruch w sieci i wychwytywać problemy. W dzisiejszych czasach, kiedy bezpieczeństwo sieci jest tak ważne, warto zrozumieć te funkcje dla skutecznego zarządzania siecią. Pytanie 35Aby użytkownik mógł skorzystać z funkcji tonowej sygnalizacji, konieczne jest włączenie wsparcia dla jego konta usługi oznaczonej skrótem A. CONF B. MCID C. DTMF D. CLIR DTMF, czyli Dual-Tone Multi-Frequency, to system sygnalizacji tonowej używany w telekomunikacji, który pozwala na przesyłanie informacji przy pomocy dźwięków generowanych przez klawiaturę telefonu. Użytkownik może wysyłać sygnały przy użyciu tonów, co umożliwia interakcję z automatycznymi systemami, takimi jak IVR (Interactive Voice Response). Włączenie obsługi DTMF dla konta abonenta pozwala na korzystanie z funkcji, takich jak wybieranie opcji w menu głosowym, a także zdalne sterowanie urządzeniami. Przykładem zastosowania DTMF może być bankowość telefoniczna, gdzie abonent używa tonów, aby wprowadzać dane lub wybierać opcje, co czyni interakcję bardziej efektywną. DTMF jest standardem w większości współczesnych systemów komunikacyjnych, co świadczy o jego uniwersalności i przydatności w codziennym użytkowaniu. W praktyce, aby zapewnić prawidłowe działanie DTMF, konieczne jest odpowiednie skonfigurowanie sprzętu i oprogramowania, co powinno być zgodne z branżowymi standardami, takimi jak ITU-T Recommendation Q.23. Pytanie 36Jeśli moc sygnału na początku łącza wynosi 1 000 mW, a na końcu 100 mW, to jaka jest tłumienność tego łącza? A. 20 dB B. 10 dB C. 40 dB D. 30 dB Tłumienność łącza oblicza się na podstawie różnicy poziomów mocy sygnału na wejściu i wyjściu łącza. W tym przypadku moc sygnału na wejściu wynosi 1 000 mW, a na wyjściu 100 mW. Tłumienność (L) oblicza się ze wzoru: L = 10 * log10(Pin/Pout), gdzie Pin to moc na wejściu, a Pout to moc na wyjściu. Podstawiając wartości: L = 10 * log10(1000/100) = 10 * log10(10) = 10 * 1 = 10 dB. Tłumienność o wartości 10 dB oznacza, że sygnał został osłabiony dziesięciokrotnie w porównaniu do jego pierwotnej mocy. Tego rodzaju obliczenia są kluczowe w telekomunikacji, gdzie tłumienie sygnału wpływa na jakość transmisji. Przykłady zastosowania obejmują projektowanie systemów komunikacyjnych, w których kluczowe jest utrzymanie tłumienia na akceptowalnym poziomie, aby zapewnić odpowiednią jakość sygnału. W branży telekomunikacyjnej standardy, takie jak ITU-T G.652, określają maksymalne wartości tłumienia dla różnych typów światłowodów, aby zapewnić wydajną transmisję danych. Pytanie 37Sygnał zgłoszenia z centrali jest przesyłany do abonenta jako A. impulsy o częstotliwości 16 kHz B. sygnał tonowy przerywany, o częstotliwości 400 do 450 Hz C. sygnał tonowy ciągły, o częstotliwości 400 do 450 Hz D. impulsy o częstotliwości 15 do 25 Hz Sygnały impulsowe, takie jak te o częstotliwości 15 do 25 Hz czy 16 kHz, są stosowane w różnych kontekstach, ale nie odpowiadają na potrzeby sygnalizacji centrali telefonicznej. Sygnał o częstotliwości 15 do 25 Hz jest zbyt niski, by skutecznie przekazywać informacje w systemach telekomunikacyjnych, ponieważ jego zasięg i rozpoznawalność nie są wystarczające dla precyzyjnej detekcji w systemach telefonicznych. Taki sygnał może być użyty w innych zastosowaniach, na przykład w systemach alarmowych, ale nie w kontekście zgłoszenia centrali. Z kolei częstotliwość 16 kHz, choć jest wyższa, nie jest standardem w kontekście sygnałów zgłoszenia centrali; zastosowanie takich częstotliwości jest ograniczone i często związane z bardziej zaawansowanymi systemami cyfrowymi, które nie są standardem w tradycyjnych połączeniach telefonicznych. Wykorzystanie sygnałów tonowych przerywanych również nie jest typowe w kontekście sygnalizacji centrali. Tego typu sygnały mogą prowadzić do zamieszania i trudności w interpretacji dla urządzeń końcowych, które są przystosowane do odbioru sygnałów tonowych ciągłych. Uczestnicy mogą się mylić, myśląc, że sygnały impulsowe mogą być bardziej efektywne, ale w rzeczywistości, ciągłość sygnału zapewnia lepszą jakość połączenia oraz mniejsze ryzyko błędów. Warto podkreślić, że zgodność z normami branżowymi i praktykami ma kluczowe znaczenie dla niezawodności i efektywności systemów telekomunikacyjnych. Pytanie 38Która odmiana technologii szerokopasmowego dostępu do Internetu DSL (Digital Subscriber Line) automatycznie zmienia prędkość transmisji danych w zależności od jakości sygnału? A. RADSL (Rate Adaptive Digital Subscriber Line) B. CDSL (Consumer Digital Subscriber Line) C. ADSL (Asymetric Digital Subscriber Line) D. SDSL (Symetric Digital Subscriber Line) ADSL (Asymetric Digital Subscriber Line) to technologia, która automatycznie dostosowuje szybkość transmisji danych do jakości sygnału, co czyni ją niezwykle elastycznym rozwiązaniem w kontekście szerokopasmowego dostępu do Internetu. W przeciwieństwie do SDSL, który zapewnia symetryczne prędkości pobierania i wysyłania, ADSL oferuje wyższą prędkość pobierania w stosunku do prędkości wysyłania, co jest bardziej korzystne dla większości użytkowników domowych i małych firm, które głównie pobierają dane. Technologia ta wykorzystuje różne pasma częstotliwości do transmisji danych, co pozwala na jednoczesne korzystanie z linii telefonicznej do rozmów głosowych. W praktyce oznacza to, że użytkownicy mogą korzystać z Internetu i prowadzić rozmowy telefoniczne jednocześnie bez zakłóceń. ADSL jest standardem uznawanym w branży, wspieranym przez wiele dostawców usług internetowych, co zapewnia dużą dostępność i różnorodność ofert. Dostosowywanie prędkości w oparciu o jakość sygnału pozwala na optymalizację wydajności połączenia, co jest kluczowe w zmiennych warunkach sieciowych. Pytanie 39Proces uwierzytelniania użytkownika polega na A. przyznaniu użytkownikowi dostępu do danych. B. szyfrowaniu loginu oraz hasła użytkownika. C. potwierdzeniu zadeklarowanej tożsamości użytkownika. D. ustaleniu nowej tożsamości użytkownika. Uwierzytelnianie użytkownika jest kluczowym procesem w zarządzaniu dostępem do systemów informatycznych, mającym na celu potwierdzenie, że osoba, która próbuje uzyskać dostęp, jest rzeczywiście tym, za kogo się podaje. Proces ten polega na weryfikacji zadeklarowanej tożsamości użytkownika poprzez różne mechanizmy, takie jak hasła, kody jednorazowe, biometryka czy karty dostępu. Przykładem może być logowanie do systemu bankowego, gdzie użytkownik wprowadza login i hasło. Serwer porównuje te dane z zapisanymi w bazie, a jeśli się zgadzają, użytkownik otrzymuje dostęp do swojego konta. Dobre praktyki uwierzytelniania obejmują stosowanie wielopoziomowej weryfikacji tożsamości, co zwiększa bezpieczeństwo, oraz regularną aktualizację haseł. Standardy, takie jak NIST SP 800-63, podkreślają znaczenie silnych metod uwierzytelniania oraz ograniczeń w przechowywaniu danych osobowych, aby zminimalizować ryzyko kradzieży tożsamości. Pytanie 40Ośmiobitowy przetwornik A/C działający w trybie przetwarzania bezpośredniego ma czas przetwarzania równy 256 µs. Dwunastobitowy przetwornik A/C tego samego rodzaju, zbudowany z tych samych komponentów co przetwornik ośmiobitowy, ma czas przetwarzania wynoszący A. 4096 µs B. 384 µs C. 2972 µs D. 256 µs Odpowiedź 256 µs jest prawidłowa, ponieważ czas przetwarzania przetwornika A/C (analogowo-cyfrowego) nie zależy od liczby bitów w jego rozdzielczości, ale od zastosowanej metody przetwarzania. W przypadku przetworników A/C wykorzystujących metodę przetwarzania bezpośredniego, czas przetwarzania jest stały i wynosi 256 µs dla ośmiobitowego przetwornika, a zatem pozostaje taki sam dla przetwornika dwunastobitowego, który jest skonstruowany z podobnych elementów. W praktyce oznacza to, że niezależnie od rozdzielczości, czas przetwarzania jest determinowany przez charakterystykę architektury przetwornika, a nie przez jego zdolność do rozróżniania większej liczby poziomów sygnału. Takie podejście jest zgodne z dobrymi praktykami w inżynierii elektronicznej, gdzie przy projektowaniu systemów pomiarowych uwzględnia się czas odpowiedzi oraz wydajność, a nie wyłącznie rozdzielczość. W praktycznych zastosowaniach, takich jak pomiary w systemach automatyki przemysłowej, kluczowe jest, aby czas przetwarzania był stabilny i przewidywalny, co ułatwia synchronizację z innymi elementami systemu. | ||||